2. 南昌大学 经济管理学院, 南昌 330031

2. School of Economics & Management, Nanchang University, Nanchang Jiangxi 330031, China

近年来,随着网络技术、计算机技术的高速发展,信息表达形式从传统单一的文本表示逐渐向多元化方向发展。其中因图像具有较强的综合性和直观性,而被人们广泛地获取和利用。在这些应用中,一个典型的例子就是纹身图像。纹身作为身体的一种标记,常与伤疤、斑、痣等特征作为身体的外在特征一起用于图像检测和识别[1]。由于它提供了足以证明个人身份的标志,而被越来越多的组织和个人所重视,比如罪犯团伙、证人、黑社会团体等。在一些黑社会团体中,纹身作为其入会的考验,也普遍被采用。

根据统计数据显示,美国每年在纹身上消费高达16亿美元;18-25岁的成年人中有36%的人至少有一个纹身;在26-40岁的成年人中,40%的人至少有一个纹身,而且这一数据还在逐年增加[2]。19世纪,美国监狱管理部门在释放罪犯时,要对其进行纹身;前苏联和纳粹德国的管理部门要在西伯利亚的监狱和纳粹集中营的在押人员身上进行纹身,以便以后进行识别和发现。2014年,美国国家标准与技术研究院(National Institute of Standards and Technology, NIST)通过举办竞赛活动开始对纹身的检测、检索等相关内容进行研究。美国联邦调查局(Federal Bereau of Investigation, FBI)根据NIST对纹身的研究成果建立了一个纹身数据库,以此数据库为基础,开展下一代身份识别。FBI的这项研究将通过相同主题的纹身,建立人与人之间的联系或者根据纹身对他们进行分类以便发现或查找犯罪分子。在我国,纹身也有着悠久的发展历史。但是大部分时间中,纹身都受到一定的歧视,例如纹身者被看作与罪犯、流氓、黑社会有关。早在中国封建时代,纹身作为一种社会符号,在犯人身体的明显部位,甚至是犯人的额下刺入“流放”“充军”或其他罪名来进行犯人的标识和识别。但随着人们观念的变化、名人和体育明星的影响,纹身越来越多地被社会所认同。特别是21世纪的年轻一代,普遍认为,纹身是塑造自己身份、铭记自己生活经历的一种方式。根据统计数据显示,43%纹身人士认为纹身对其有特殊的意义[2]。总之随着时代的发展,纹身的人数也在逐渐增加。

如何对纹身图像进行快速检测,并高效查询出与之相似的纹身图案,进行语义的解读,以发现其正常或不正常的行为,并为相关部门和人员提供有力的证据,这越来越多地被安全部门所重视。2014年,NIST开始对纹身进行研究,公开了第一个纹身图像数据集。这个纹身图像数据集虽然比较小,但在一定程度上引发了各学者对这一领域的关注。

1 相关研究纹身图像的检测、分析与识别经历了长时间的研究,但一直没有受到太多人的关注。2016年12月10日,在中国期刊网上以“纹身”为关键字进行查询,通过文献查询,共查询到49条结果。从这49条记录来看,在国内现有的研究主要是集中在纹身的历史演变、医学应用等方面,至今还没有对纹身的检测、检索相关的研究。这也充分说明在国内,对纹身的分类与检测研究仍然是一个空白。但是在国外,对纹身的研究有较长的时间。不过时间虽长,但研究者及其成果并不多。从内容上来看,主要集中在纹身的检索、分割等内容,对纹身图像检测的研究较少。

在纹身的学术研究方面,最初是通过对基于文本的检索方法来进行纹身的检索研究。对于这种方式,需要相应人员对纹身图像进行手工标注。例如在美国,法官为了通过纹身图像来找到罪犯的证据,需要手工对罪犯的纹身图像进行采集和标注。但是因标注者主观因素的影响,同一个纹身图像可能会有不同的标注。随着基于内容的图像检索(Content Based Image Retrieval, CBIR)技术的发展,一些学者开始采用CBIR对纹身图像进行检索和检测研究。如Jain等[3]基于图像的底层特征利用CBIR技术研究纹身图像的检索与检测。Acton等[4]利用活动轮廓(Active contour)方法对纹身图像进行分割,提出基于全局特征的纹身图像检索算法,提高性能。Lee等[5]采用SIFT(Scale-Invariant Feature Transform)特征对纹身图像的匹配进行了相关研究。Lee等[6]认为SIFT等局部特征表现出较好的性能,便是很难直接应用到数据集较大的纹身图像检索中,针对这个问题他们提出了分级的纹身图像检索算法。CBIR在纹身图像上的另一个应用就是基于纹理框架的检索与匹配。Han等[7]通过局部不变特征进行纹身图像纹理结果的匹配验证。在纹身图案的分割和分类方面,Heflin等[8]第一次采用显著性模型(Saliency model)来查找感兴趣点并通过图像分割方法进行最后的分割。与Heflin类似,Kim等[9]先利用图像分割方法进行图像分割,然后利用SIFT特征,通过匹配感兴趣子区域进行纹身图像的检索。Lee等[10]通过对Michigan警察局获取的64 000幅纹身图像进行研究,结果表明现有的技术不能从大量的纹身图像中有效地匹配和检测出有效的图像。Wiber等[11]提出了极限编码(Exemplar codes)进行纹身图像的检测与分类。Huynh等[12]注意到监狱和警察等部门没有有效的方式采集纹身图像,他开发了一个纹身图像自动采集系统来采集和处理纹身图像和一些其他生物特征(如伤、斑、痣等)。Manger[13]根据图像检索技术,利用图像的局部相似性信息和词包模型,设计了一个纹身图像检索系统,这个系统可以在数秒内从30万的纹身图像中检索需要的图像。Jain等[14]设计了一个基于内容的纹身图像检测系统,这个系统通过自动提取SIFT特征、纹身的身体位置信息和类别,然后进行检测,在63 593幅纹身图像的数据集上进行实验,结果表明在一定程度上提高了检测的准确性。Marcetic等[15]设计了一个系统,通过SIFT、纹理等特征进行纹身位置的定位和识别。在这些研究中,都是利用自己的数据库进行研究,一方面是没有公开的纹身数据库,另一方面各学者利用自己的数据,不利于结果之间的比较。

2014年,NIST举办了一个商业和学术活动以提高纹身图像检测的技术。对于纹身图像检测,NIST的目标是解决一幅图像中是否包括纹身图案。在这个活动中有四个组织参与了纹身图像的检测研究工作,分别是French Alternative Energies and Atomic Energy Commission(CEA)、Compass Technical Consulting(Compress)、MITRE Corporation (MITRE)和Morpho/MorphoTrak (Morpho Trak),但是还没有学术机构参与到纹身图像的检测研究中。在NIST的纹身数据集中,共有2 349幅图像,包括1 349幅纹身图像和1 000幅非纹身图像。由于NIST数据集本身是在室内进行采集的,而且非纹身图像基本上是人脸,对研究算法的泛化能力验证不足。

近几年,基于卷积神经网络(Convolutional Neural Network, CNN)的研究成果,表明CNN还在快速地发展中[16]。特别是随着深度学习的发展和研究的深入,越来越多的学者逐渐投入到神经网络的研究当中,例如李彦冬等[17]重点对CNN的过拟合、网络结构、迁移学习、原理分析四个方面进行归纳与总结,并指出了未来的发展方向。随着深度学习的研究,一些学者开始把深度学习算法,特别是CNN算法应用到纹身图像的检测与识别中,Sun等[18]认为现有的纹身图像检测存在一些问题,主要表现为很难找到一个有效的、通用的纹身图像特征用于纹身图像的检测与分类。因此为了克服这些困难,本文采用了CNN算法进行训练、特征提取和纹身图像检测。Xu等[19]利用基本的CNN模型对纹身检测进行了研究,并认为NIST对纹身图像检测与分类进行了研究并公布了一些结果,但由于其数据集的采集均是在室内进行的,其结果很难应用到外部场景的数据中。Hrkac等[20]利用深度学习算法研究了纹身图像检测,并重点探讨了皮肤上纹身图案消除工作。但是这些研究没有考虑到纹身图像本身空间信息特征,是否有更好的方法可以自动提取到不同尺度下的纹身图像空间信息呢?在图像预处理阶段,是否还可以采用传统的图像大小变换方式进行预处理工作呢?显然由于纹身图像和标准的其他图像数据集(如ImageNet)不一样,需要更有效的针对纹身图像的预处理方式。

2 基于三通道的卷积神经网络改进算法CNN是一种多层前馈神经网络,一般认为由卷积层、池化层、全连接层等组成。最经典的结构是2012年Alex提出的CUDA-CONVNET结构,后来通过整理,形成第二个版本,即CUDA-CONVNET2[21]。CNN在图像分类和识别中性能较为突出,例如ImageNet、脸部识别和数字识别等。与传统的算法相比,卷积神经网通过BP算法能够提取到较好的图像特征并取得较高的准确率。但是现在的网络结构对全连接层关注较少。全连接层在不同尺度下的特征提取能力是不一样的。本文也是在对CUDA-CONVNET2的研究基础上,针对CNN全连接层在不同尺度下的特征提取能力问题,提出一种新的网络结构,称为三通道全连接层的CNN。本文的主要改进工作包括图像预处理、基于三通道网络结构的构建和算法的泛化能力验证。

2.1 图像预处理一般来讲,由于计算机内存、显示及数据库大小的原因,一般是把纹身图像变换成256×256或者更小。为了不让纹身图像在变换的过程中变形,采用长宽等比例变换。例如在Alex中,对图像的长和宽较小的一边变换成256,较长的一边进行等比变换,然后以中心进行截取227×227大小的图像块。这种方式的优点很明显,相对比较简单,而且使用方便,如CUDA-CONVNET、CAFFE等主流的深度学习框架都是采用这种方式。但是有一个比较明显的问题,如果要检测的目标在图像的中间,通过这种方式截取,仍然可以获得到全部或绝大部分特征信息。例如ImageNet数据集,一方面图像的长与宽相对一致,另一方面要检测的目标都在图像的中间位置。但是对于纹身图像来讲,长宽比例差别较大,而且位置也不确定,如图 3所示。因此在对图像进行预处理的时候,不能采用传统的Alex方法。本文的思想是在图像变换的时候,按长宽中比较大的一边进行变换到256个像素大小,另一边进行等比例变换,这样会导致另一边小于256个像素。对于较小的一边,以原有图像为中心,进行两侧翻转,直到256个像素大小。这样处理有两个优点,一是可以保证处理后的图像还是256×256的大小;二是不会导致图像中纹身内容的丢失。具体的变换算法如下。

|

图 3 NIST和Flickr数据集部分示例图 Figure 3 Samples of NIST and Flickr datasets |

算法 图像预处理算法。

输入:InImage;

输出:OutImage。

步骤1 计算图像长和宽中较大的一边,记为ma,较小的一边记为mi。

步骤2 如果ma>256,以256/ma进行等比例变换;然后进行步骤4, 否则进行步骤3。

步骤3 对ma一边进行反转,直到256。

步骤4 对mi一边进行反转,直到256。

步骤5 输出OutImage。

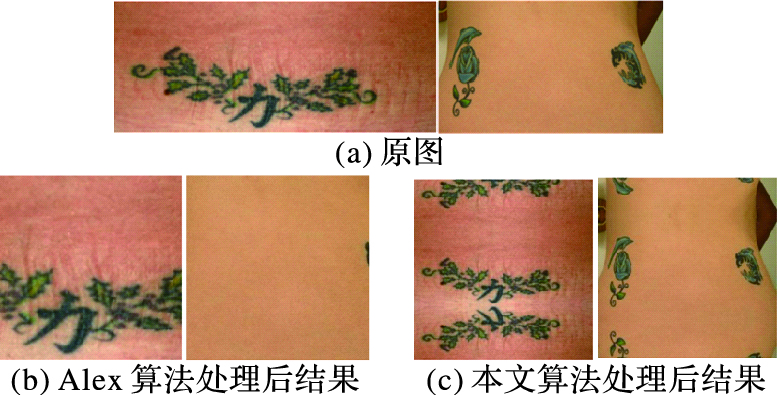

图 1显示了通过本文提出的预处理方法和Alex文章中的预处理方法的部分结果示例。虽然两种方法都是通过等比例变化成256×256大小,然后再截取227×227大小的图像,但从截取的结果来看,本文的方法能有效地保证纹身图案的完整性,而在Alex方法中,会丢失部分甚至全部纹身图案。

|

图 1 纹身图像预处理结果比较 Figure 1 Result comparision of two tattoo preprocessed algorithms |

从图 1可以看出,用Alex方法进行图像预处理,在第一幅图像中,部分纹身图案会丢失,导致信息不完整;在第二幅图像中,纹身图案几乎全部丢失,对纹身图像检测训练会产生较大影响。

本文提出的预处理方法很好地解决了Alex方法对纹身图像预处理的问题,改进了原有的Alex方法对纹身图像不适用的特点。本算法的优点主要有:

1) 对于图像大小大于256的,进行等比例缩放操作,图像不会变形;

2) 对于图像小于256的图像,通过反转进行扩大,不会使原图像失真;

3) 对于一边大、另一边小的图像,按大边进行缩放,小边进行反转,保证图像空间信息不丢失。

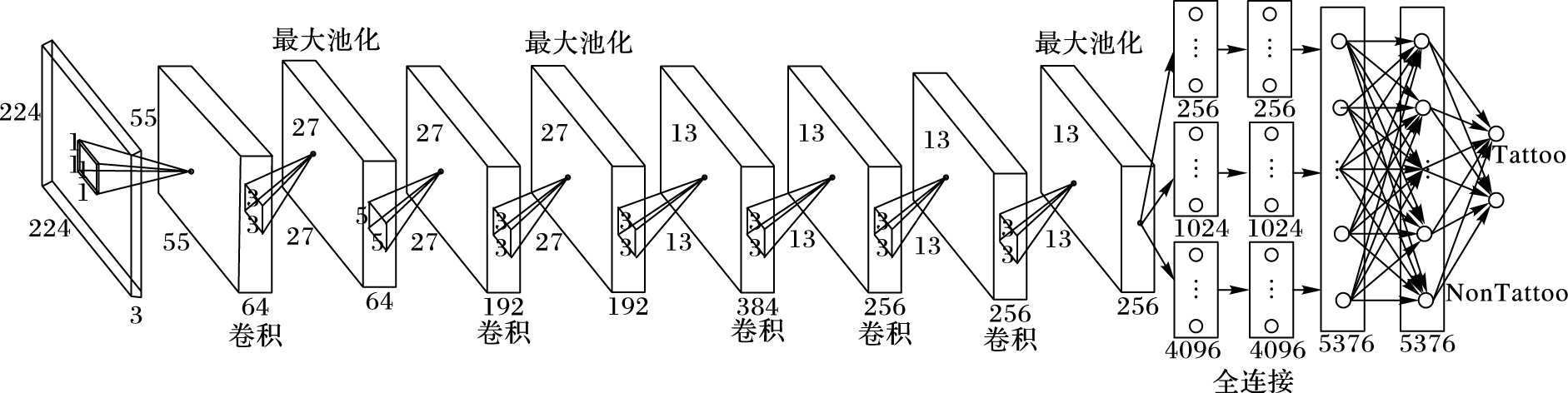

2.2 基于三通道全连接层的卷积神经网络架构设计CNN通过逐层进行图像特征的提取,不同卷积层提取的特征不一样,一般认为全连接层提取到的是高层特征。现有的CNN主要集中在单一通道的全连接层。通过单一通道的全连接层提取的特征在图像表达方面有一定的局限性,主要表现为不能有效地表示不同尺度空间的图像特征信息。为了解决这个问题,设计了一个多通道融合的全连接层卷积神经网结构,通过不同通道全连接层的神经元数量,实现不同尺度的图像表示。具体如图 2所示。

|

图 2 多通道全连接层的CNN结构示意图 Figure 2 CNN structure diagram of multi-channel fully connected layer |

该模型包括5个卷积层、3个通道的全连接层和1个全连接融合层。前5个卷积层分别有64、192、384、256、256个卷积核,对应的卷积核的大小分别是11×11×3、5×5×64, 3×3×192、3×3×384和3×3×256。每个通道包括两个全连接层,3个通道对应的全连接层神经元的个数分别是256-256、1 024-1 024和4 096-4 096。在三通道后再做一次全连接操作。为了防止过拟合,在每个通道上的全连接层均采用Dropout技术,其值是0.5。最后3个通道融合成1个输出向量,其维度是5 376。最后实现纹身图像检测。同Alex[21]的网络结构一样,在预处理阶段,本文的结构也采用logistic回归,训练图像和测试图像统一变换到256×256大小,然后分别以中心和4个顶点截取图像,截取的大小是227×227,共得到5幅子图像。对于所有输入图像,均要减去训练图像的均值,同时采用随机梯度法进行最优化训练。在参数初始化方面,学习率设置为0.01,动量(moment)设置为0.9,权重衰减设置为0.000 5。权重采用均值是0、标准差是0.01的高斯分布进行随机初始化;初始的偏置量在第一层和第三层是0,其余层是1[20]。

本文设计的CNN结构较好地解决了原有网络结构在图像空间特征提取能力不足的问题。这样设计的优点主要有:

1) 充分考虑不同全连接层神经元个数对纹身图像高层语义特征的提取能力,即在不同尺度下抽取到不同的图像特征。

2) 通过多通道分别抽取特征,使图像特征的表示能力更强。

3) 通过多通道的融合策略,进行一次全连接层操作,然后再进行纹身检测工作,可以建立各特征之间的关系,更有利于纹身图像的检测。

3 实验与分析 3.1 数据集美国国家标准与技术研究院(NIST)直属美国商务部,从事物理、生物和工程方面的基础和应用研究,以及测量技术和测试方法方面的研究,提供标准、标准参考数据及有关服务,在国际上享有很高的声誉。NIST纹身检测数据集(记为N-Dataset)是其中的一个。NIST纹身检测数据集共有2 349张图像(1 000非纹身图像和1 349张纹身图像),图像共分为5组,NIST纹身数据集的各类及各组的分布如表 1。

| 表 1 纹身图像数据集分组情况 Table 1 Tattoo images dataset group |

为了便于比较和验证算法的泛化能力,构建了Flickr数据集。Flickr数据集是本文第一作者在新加坡南洋理工大学访学期间,在Adams Kong实验室,同其学生一起收集构建的。在构建Flickr数据时,不同大小的Flickr数据集中纹身图像与非纹身图像的比例与NIST数据保持一致。第一个Flickr数据集与NIST的数据集中图像的数量及分组完全相同,记为FD。第二个Flickr数据集在第一个数据集的基础上增加一部分纹身图像和非纹身图像,使数据集大小达到5 000,记为FD5K,第三个Flickr数据集在第二个Flickr数据集的基础上增加到10 000幅图像,记为FD10K。这三个不同大小的数据集图像数量分布如表 2。

| 表 2 三种Flickr数据集图像分布 Table 2 Flickr datasets of three sizes |

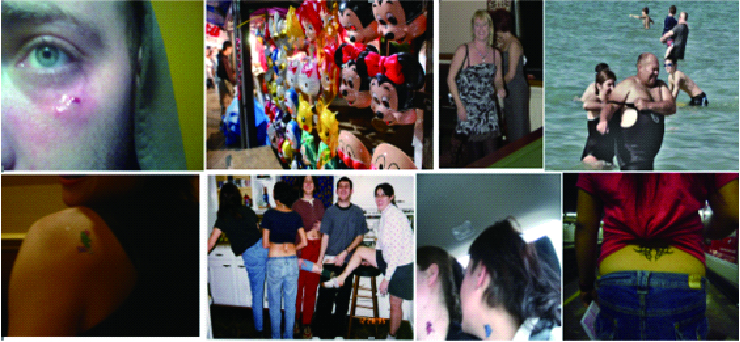

图 3展示了NIST数据集和Flickr数据集中的部分图像。从部分示例图来看,NIST数据集中的图像相对比较简单,背景比较单一;同时在NIST纹身数据集中,纹身图像来自身体的不同部位,而非纹身图像主要来自于脸部。所有的NIST数据集都是在室内采集的[22]。而Flickr数据集中的图像相对比较复杂,更接近实际环境中的图像,更有利于相关部门对纹身图像的检测。

3.2 实验与结果为了有效保证实验结果的有效性,采取5组交叉验证。进行5次实验,最终的结果作为实验结果。NIST数据已进行了分组,共分为5组。每次选其中4组作为训练集,另外1组作为测试集,得到1组结果。进行5次,从而保证每一个样本都可以作为测试集进行实验。通过5次实验,得出5组实验正确率。

纹身图像的正确率定义为:

Tattoo_accuracy=Ncorrect_tattoo/Ntotal_tattoo

非纹身图像的正确率定义为:

Non_Tattoo_accuracy=Ncorrect_non-tattoo/Ntotal_non-tattoo

最终正确率定义为:

| $Overall\_accuracy{\rm{ = }}\frac{{{N_{{\rm{correct\_tattoo}}}} + {N_{{\rm{correct\_non - tattoo}}}}}}{{{N_{{\rm{total\_tattoo}}}} + {N_{{\rm{total\_non - tattoo}}}}}}$ |

其中:Ncorrect_tattoo表示正确的纹身图像数量;Ncorrect_non-tattoo表示正确的非纹身图像数量;Ntotal_tattoo表示所有的纹身图像数量;Ntotal_non-tattoo表示所有的非纹身图像数量。

1) NIST数据集实验。

表 3列举了在采用CNN模型的基础上,本文提出的预处理算法与Alex的预处理算法的结果对比。

| 表 3 不同预处理算法在NIST上的实验结果对比 % Table 3 Result comparision with different preprocessing algorithm on NIST dataset % |

通过表 4可以看出,在纹身图像检测方法,本文预处理算比Alex的预处理算法正确率提了0.29个百分点,在非纹身图像的检测正确率方面,两者表现一样。在总检测正确率方面,本文预处理算有0.17个百分点的优势。这也说明本文预处理算法在对纹身图像检测方面具有一定的针对性,也进一步验证了本文预处理算法在处理后,无论纹身图案在图像中的位置怎么变化,都能有效的保留纹身图案信息,更有利于检测检测。

| 表 4 本文算法在NIST数据集上的实验详细结果 Table 4 Detailed result of proposed algorithm on NIST dataset |

表 4列举了提出的算法在NIST数据集上纹身检测的混淆矩阵。从表 5可以看出,新提出的算法在纹身检测的正确率达到99.4%,非纹身检测的正确率达到98.6%,总正确率达到99.1%。在检测结果中,共有8幅纹身图像误分成非纹身图像和14幅非纹身图像误分成纹身图像。

| 表 5 本文算法与其他算法比较 Table 5 Result comparison between proposed algorithm and other algorithms |

为了把本文算法与其他算法进行比较,表 5列举相关算法在NIST数据集上的结果。其中CEA_1、Compass、MITRE 1、MITRE 2和MorphoTrak是Tattoo-C公布的结果。由于Tattoo-C公布的结果没有详细说明算法,因此没有进行实验重复。Xu等[19]采用的CUDA-CONVNET2中标准的CNN模型,而且图像预处理也是Alex原有的预处理方法。与已有的结果相比,本文提出的算法由于充分考虑了在图像空间信息下对不同尺度特征的提取能力,无论是在纹身图像、非纹身图像的正确率还是整体正确率上,都取得了进一步的提高。同时在纹身图像与非纹身图像正确率之间的差异上,也进一步缩小。

2) Flickr数据集实验。

NIST数据集都是在室内进行采集的,而且非纹身图像均是以人脸为主,从某种意义上讲,不能验证算法的泛化能力。为了进一步验证本文提出的算法,采用从Flickr上采集的纹身图像数据集进行实验。为了便于同NIST数据集的结果比较,采用与NIST相同大小的数据集及分组方法。实验分别用CNN算法和本文提出的算法在NIST数据集和Flickr数据集进行训练,然后进行测试,共进行8次实验,其详细结果如表 6。

| 表 6 本文算法在Flickr和NIST上的实验结果 Table 6 Result of proposed algorithm on Flickr and NIST |

从表 6的四个实验结果来看,本文提出的算法正确率比原CNN算法的正确率均有所提高。同时用NIST训练时,用NIST数据集用测试,正确率较高,达到99.1%,但是用FD作测试时,正确率仅有65.2%,两者差异较大,这也说明NIST数据集的泛化能力不足。反过来用FD作训练集,分别对NIST和FD作测试,其正确率分别是83.0%和78.8%,两者相差较小,说明采用FD数据集训练出来的模型比采用NIST数据集训练出来的模型有更好的推广能力。

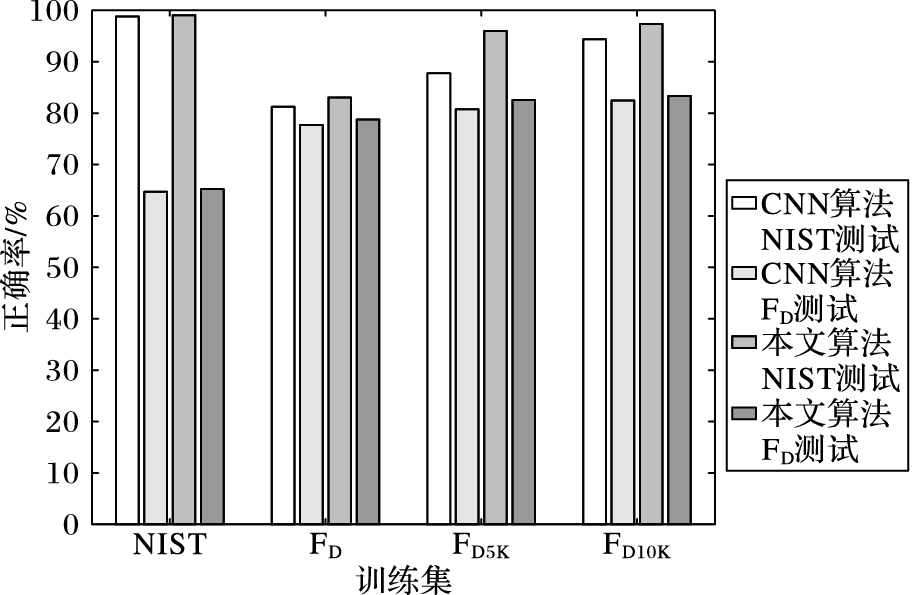

为了更好地比较,在前面实验基础上,分别用CNN算法和本文提出的算法在FD5K和FD10K纹身数据集进行训练,并在NIST和FD数据集上进行测试,共进行8次实验。结果如图 4。

|

图 4 本文算法与CNN算法不同训练集时结果比较 Figure 4 Result comparision of different algorithms by using different training data set |

从图 4可以看出,以不同的数据集进行训练时,对NIST数据集的测试正确率比在FD数据集上的正确率要高一些。从两者的图像集来看,NIST图像集更容易区分一些。对CNN算法和本文提出算法的正确率来看,本文提出算法的正确率在不同的数据集上都表现出明显的优势。通过不同的数据集实验,也进一步验证了本文提出的算法有较好的泛化能力。

图 5和图 6列举了部分误分图像。在NIST数据集上,从误分图像表来看,本文算法没有正确检测出纹身图像的原因是它们都有比较明显的脸部图案。例如在纹身图像中,纹身图案本身就是人脸,导致误分。在Flickr数据集上,误检测的纹身图像的主要原因是纹身图案的面积相对较小,不容易检测,即使通过人为进行区别,有时也不是太容易。

|

图 5 部分NIST误分图像 Figure 5 Some miclassified images of NIST |

|

图 6 部分Flick误分图像 Figure 6 Some misclassified images of Flickr |

纹身图案作为犯罪嫌疑人识别的重要证据之一,至今没有引起相关学者的重视。纹身图像检测又是其中最为关键的一个环节。NIST通过举办了相关的商业和学术活动,引起了各学者对“纹身”这一领域的关注。在这次活动中,有一个政府和三个企业组织参与并提交了研究结果,纹身检测的正确率从62.2%到96.3%不等。Xu等[19]利用CNN算法,把正确率提高到98.8%。首先利用本文提出的预处理算法和Alex的算法在NIST数据集上进行对比实验,结果显示本文的预处理算法对纹身图像的检测效果提升了0.17个百分点,然后再利用本文的改进算法,实验结果验证了正确率进一步提高,达到99.1%。当用NIST的纹身数据集训练CNN模型,并用其他另一个同大小的Flickr纹身图像数据集进行测试,正确率仅有65.2%,正确率较低。而用这个Flickr数据集进行训练,并用FD和NIST数据集进行测试,其正确率分别为78.8%和83.0%,相差不是很大。这充分说明NIST数据集存在一定的不足,而从图 3的示例图像可以看出,NIST纹身图像相对比较容易区分,并与现实的纹身图像差异较大。为了更好地说明本文算法的性能及泛化能力,逐渐增加Flickr数据集的大小,如图 4所示,发现其正确率也在提高。当数据集的规模增加到10 000时,再对NIST数据集进行测试,正确率达到97.3%,以非常接近用NIST数据集进行训练时的结果,然而用Flickr数据进行测试,正确率仅有83.4%,虽然比用NIST数据集训练时结果有较大提高,但还是不太理想,因此在接下来的工作有必要对纹身图像进一步研究。

| [1] | MCCABE R M, NEWTON E M, GUTIERREZ C M. ANSI/NIST-ITL 1-2000 Data format for the interchange of fingerprint, facial, Scar Mark & Tattoo (SMT) information[S]. New York:American National Standards Institute, 2000. |

| [2] | Statistic Brain Research Institute. Tattoo statistics[EB/OL].[2016-12-23]. http://www.statisticbrain.com/tattoo-statistics/. |

| [3] | JAIN A K, LEE J E, JIN R. Tattoo-ID:automatic tattoo image retrieval for suspect and victim identification[C]//Proceedings of the Multimedia 8th Pacific Rim Conference on Advances in Multimedia Information Processing. Berlin:Springer, 2007:256-265. |

| [4] | ACTON S T, ROSSI A. Matching and retrieval of tattoo images:active contour CBIR and glocal image features[C]//Proceedings of the 2008 IEEE Southwest Symposium on Image Analysis and Interpretation. Washington, DC:IEEE Computer Society, 2008:21-24. |

| [5] | LEE J E, JAIN A K, JIN R. Scars, Marks and Tattoos (SMT):soft biometric for suspect and victim identification[C]//Proceedings of the 2008 Biometrics Symposium. Piscataway, NJ:IEEE, 2008:1-8. |

| [6] | LEE J E, JIN R, JAIN A K. Unsupervised ensemble ranking:application to large-scale image retrieval[C]//Proceedings of the 201020th International Conference on Pattern Recognition. Washington, DC:IEEE Computer Society, 2010:3902-3906. |

| [7] | HAN H, JAIN A K. Tattoo based identification:sketch to image matching[C]//Proceedings of the 2013 International Conference on Biometrics. Piscataway, NJ:IEEE, 2013:1-8. |

| [8] | HEFLIN B, SCHEIRER W, BOULT T E. Detecting and classifying scars, marks, and tattoos found in the wild[C]//Proceedings of the 2012 IEEE 5th International Conference on Biometrics:Theory, Applications and Systems. Piscataway, NJ:IEEE, 2012:31-38. |

| [9] | KIM J, LI H, YUE J, et al. Tattoo image retrieval for region of interest[C]//Proceedings of the 2016 IEEE Symposium on Technologies for Homeland Security. Piscataway, NJ:IEEE, 2016:1-6. |

| [10] | LEE J, JIN R, JAIN K, et al. Image retrieval in forensics:tattoo image database application[J]. IEEE MultiMedia, 2012, 19(1): 40-49. DOI:10.1109/MMUL.2011.59 |

| [11] | WILBER M J, RUDD E, HEFLIN B, et al. Exemplar codes for facial attributes and tattoo recognition[C]//Proceedings of the 2014 IEEE Winter Conference on Applications of Computer Vision. Washington, DC:IEEE Computer Society, 2014:205-212. |

| [12] | HUYNH N Q, XU X, KONG A W K, et al. A preliminary report on a full-body imaging system for effectively collecting and processing biometric traits of prisoners[C]//Proceedings of the 2014 IEEE Symposium on Computational Intelligence in Biometrics and Identity Management. Piscataway, NJ:IEEE, 2014:167-174. |

| [13] | MANGER D. Large-scale tattoo image retrieval[C]//Proceedings of the 20129th Conference on Computer and Robot Vision. Washington, DC:IEEE Computer Society, 2012:454-459. |

| [14] | JAIN A K, LEE J E, JIN R, et al. Content-based image retrieval:an application to tattoo images[C]//Proceedings of the 200916th IEEE International Conference on Image Processing. Piscataway, NJ:IEEE, 2009:2709-2712. |

| [15] | MARCETIC D, RIBARIC S, STRUC V, et al. An experimental tattoo de-identification system for privacy protection in still images[C]//Proceedings of the 201437th Information and Communication Technology, Electronics and Microelectronics. Piscataway, NJ:IEEE, 2014:1288-1293. |

| [16] | COTTRELL G W. New life for neural networks[J]. Science, 2006, 313(5786): 454-455. DOI:10.1126/science.1129813 |

| [17] | 李彦冬, 郝宗波, 雷航. 卷积神经网络研究综述[J]. 计算机应用, 2016, 36(9): 2508-2515. (LI Y D, HAO Z B, LEI H. Survey of convolutional neural network[J]. Journal of Computer Applications, 2016, 36(9): 2508-2515. DOI:10.11772/j.issn.1001-9081.2016.09.2508) |

| [18] | SUN Z H, BAUMES J, TUNISON P, et al. Tattoo detection and localization using region-based deep learning[C]//Proceedings of the 201623rd International Conference on Pattern Recognition. Piscataway, NJ:IEEE, 2016:3050-3055. |

| [19] | XU Q, GHOSH S, XU X, et al. Tattoo detection based on CNN and remarks on the NIST database[C]//Proceedings of the 2016 International Conference on Biometrics. Piscataway, NJ:IEEE, 2016:1-7. |

| [20] | HRKAC T, BRKIC K, RIBARIC S, et al. Deep learning architectures for tattoo detection and de-identification[C]//Proceedings of the 20161st International Workshop on Sensing, Processing and Learning for Intelligent Machines. Piscataway, NJ:IEEE, 2016:1-5. |

| [21] | KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[C]//Proceedings of the 25th International Conference on Neural Information Processing Systems. New York:Curran Associates Inc., 2012:1097-1105. |

| [22] | KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[C]//Proceedings of the 25th International Conference on Neural Information Processing Systems. New York:Curran Associates Inc., 2012:1097-1105. |