人类能够较容易地在复杂的视觉场景中判断感兴趣目标或者区域。视觉选择性注意力机制在信息处理过程中扮演着重要的角色,能够突破信息的处理瓶颈,使有价值的信息作为短期记忆和视觉意识的信息来源,因此,优先考虑显著性目标来分配图像分析和合成所需的计算方法在计算机视觉与图像处理领域有重大意义。

视觉显著性区域提取即寻找图像中可能引起人眼视觉关注的区域。根据人类视觉系统的特点,利用人类认知过程的一般规律,通过图像的某些底层特征近似地探测和提取图像中的显著性区域是当前计算机视觉领域研究热点之一。

在Koch等[1]提出的生物启发模型的基础上,Itti等[2]提出基于“中心-周围”环绕算子的显著对象探测模型(以下简称Itti模型),是近期最具代表性探测和提取显著图的方法之一。Itti模型框架主要包括特征提取、显著图融合及显著对象提取等三个关键步骤,其中在显著图融合这一步通过综合考虑颜色、亮度及方向等多特征显著值并融合得到全局显著图。在显著对象提取这一步,通过设定(或自适应)阈值从原始图像中提取显著对象(或显著性区域)。

在计算机视觉领域,从频域的角度来分析视觉显著性也是常见方法之一。Hou等[3]提出一种模拟预注意视觉搜索行为的前端方法,不同于传统的统计学模型,该方法分析每幅图像的对数谱并提取谱残差,然后将谱残差变换到空间域以提取显著图。实验结果显示,尽管该方法计算速度快,但仅构成早期视觉处理阶段,其主要缺点是由于没有保留足够的高频信息导致显著对象(或显著性区域)边界不够清晰,所提取的显著对象显著图呈现出稀疏、灰度不均匀等现象。

尽管显著对象探测已经经历近二十年的发展,然而,它仍然是一个有待解决的难题,迄今仍然是一个十分活跃的研究领域。一些新的方法和思想被不断地提出,一些早期的方法被不断得以改进。Fu等[4]提出了一种基于颜色对比度及颜色分布驱动的显著对象探测模型,他们认为:从人类感知角度来看,一个显著对象的视觉生成基于三个基本原则,即中心分布优先、与周围环境相比较的高颜色对比以及紧的颜色分布。Jiang等[5]通过在图像图模型上的吸收马尔可夫链建立显著性探测模型,模型联合地考虑显著对象及背景外观的多样性及空间分布,在马尔可夫链中虚拟边界节点被选作吸收节点并计算由每个临时节点到边界吸收节点的被吸收时间。临时节点的被吸收时间度量其与所有吸收节点的全局相似性并由此从背景中提取显著对象。Yan等[6]针对复杂结构的显著对象,即图像中显著的前景或背景含有小尺度高对比度模式时可能反向地影响探测精度的问题,基于尺度观点提出了一种多层分析显著性线索方法,最终的显著图通过一个分层模型生成。Liang等[7]提出了一种基于区域表示的模型,在模型中,他们对输入图像进行分割、聚类、计算基于区域的中心周围特征及颜色分布特征,最后融合两个特征生成显著图。Zhu等[8]建立了一种边界优先的显著对象提取模型,在模型中,他们首先提出一种称之为边界连通性的鲁棒的背景度量机制,由此刻画图像区域对图像边界的空间布局;接着,提出一种基于规则的优化框架来集成多个低级线索以获得一致的显著图。Kim等[9]将图像的显著图表示做高维颜色空间的一个线性组合,由此显著性区域及背景区域能够被区别开来。Borji等[10-11]从数量及质量两个方面广泛地比较了40个最新模型,其中28个最新显著对象探测模型及10个注视预估模型等,超过6个用于显著对象探测及分割方法的基准评测数据集,特别是在评测指标及基准评测数据集等方面进行了规范和统一。虽然显著性探测方面的研究持续不断,新的方法和思想持续不断地被提出,然而,由于图像本身的多样性和复杂性,加之方法研究本身的针对性,在具体应用时没有一种普遍通行的方法存在,因此,在显著性探测及显著对象提取领域,迄今的研究目标仍然聚焦在模型提取精度、完整度以及算法时间复杂性等方面。

本文在广泛研究显著对象探测方法的基础上,受到Itti模型及Hou模型的启发,在仔细研究与分析倒数函数滤波的性能之后,结合这两个模型在探测显著对象过程中存在的问题:如利用前者提取的显著对象通常表现不完整及边界不光滑;而利用后者提出的显著对象区域虽然对象轮廓被粗略地提取,但对象区域表现出稀疏、不均匀的分布。寻求针对上述问题的解决方案:尽可能地利用图像自身的自然特征,即颜色、形状(方向)及空间频域谱,归一化后通过适当优化组合构成一种新的基于倒数函数-谱残差特征(Reciprocal Function and Spectral Residual,RFSR)的显著对象探测方法,以弥补单一显著特征探测模型的不足。实验结果表明,RFSR方法有效地改进了上述两个模型存在的缺点,显著地提高了显著性对象探测效果和性能。

1 相关研究在视觉上,人类很容易能够找到自己感兴趣的区域,然而,利用计算机视觉处理系统寻找和提取感兴趣区域则是一件不容易的事。近年来,研究人员已在计算机视觉及图像分析与处理领域做了大量的研究工作并取得了许多进展,他们通过模拟人的视觉注意过程,发现并总结出基于视觉注意的三个基本原则,即颜色对比度、亮度对比度和边缘方向对比度等。Itti等[2]显著图模型和Hou等[3]谱残差方法是具有代表性的视觉注意模型。

1.1 Itti模型及性能分析在Koch等[1]提出的生物启发模型的基础上,Itti等[2]提出基于“中心-周围”环绕算子的显著性对象探测模型。模型中“中心-周围”被实现作细和粗尺度的差:这里的中心是在尺度c∈{2, 3, 4}处的像素,周围是在尺度s=c+α、α∈{3, 4}处对应的像素。交叉尺度的两个映射之间的差,通过对较细尺度的插值并逐点相减获得。对c和α利用这几个尺度通过包含不同的中心和周围区域大小比率获得真正的多特征提取。

设r, g, b是输入图像的红、绿和蓝通道,灰度图像I通过计算I=(r+g+b)/3获得。I被用来创建高斯金字塔分层[12]得到I(σ),这里σ∈{0, 1, …, 8}是尺度。r, g, b通道通过I进行标准化,注意仅在I大于整幅图像1/10最大值处进行,而其他位置r, g, b值置为0。建立四个被完全调制的颜色通道:

| $ \boldsymbol{R} = \boldsymbol{r}-(\boldsymbol{g} + \boldsymbol{b})/2 $ | (1) |

| $ \boldsymbol{G} = \boldsymbol{g}-(\boldsymbol{r} + \boldsymbol{b})/2 $ | (2) |

| $ \boldsymbol{B} = \boldsymbol{b}-(\boldsymbol{r} + \boldsymbol{g})/2 $ | (3) |

| $ \boldsymbol{Y} = \boldsymbol{r} + \boldsymbol{g}-\left| {\boldsymbol{r}-\boldsymbol{g}} \right|/2-\boldsymbol{b} $ | (4) |

其中:R, G, B及Y分别表示原始图像标准化后的颜色分量矩阵(负值时置为0)。创建自这些颜色通道的四种高斯金字塔被记作R(σ)、G(σ)、B(σ)、Y(σ)。

灰度的“中心”细尺度c和“周围”粗尺度α之间的“中心-周围”差生成特征映射,共计6个映射M(c, s), c∈{2, 3, 4}, s=c+α, α∈{3, 4}计算如下:

| $ \boldsymbol{M}(c, s) = \left| {\boldsymbol{I}(c)-\boldsymbol{I}(s)} \right| $ | (5) |

对颜色通道的特征映射类似地按如式(6)、(7) 计算:

| $ \boldsymbol{RG}(c, s) = \left| {(\boldsymbol{R}(c)-\boldsymbol{G}(c))-(\boldsymbol{G}(s)-\boldsymbol{R}(s)} \right| $ | (6) |

| $ \boldsymbol{BY}(c, s) = \left| {(\boldsymbol{B}(c)-\boldsymbol{Y}(c))-(\boldsymbol{Y}(s)-\boldsymbol{B}(s)} \right| $ | (7) |

其中s=c+α, c∈{2, 3, 4}, α∈{3, 4}。

利用Gabor金字塔o(σ, θ), σ∈{0, 1, …, 8}, θ∈{0, π/4, π/2, 3π/4}获得局部方向信息,方向特征映射o(c, s, θ)被定义为中心与周围尺度之间的一组局部方向对比度:

| $ o(c, s, \theta ) = \left| {o(c, \theta )-o(s, \theta )} \right| $ | (8) |

以上总计计算42个特征映射图,其中:6个灰度特征,12个颜色特征,24个方向特征。

对以上42个特征进行适当融合以计算显著性映射。基于以上3类特征融合如下:

| $ \bar I = \mathop \oplus \limits_{c = 2}^4 \mathop \oplus \limits_{s = c + 3}^{c + 4} N\left( {\boldsymbol{M}\left( {c, s} \right)} \right) $ | (9) |

| $ \overline c = \mathop \oplus \limits_{c = 2}^4 \mathop \oplus \limits_{s = c + 3}^{c + 4} \left[{N\left( {\boldsymbol{RG}\left( {c, s} \right)} \right) + N\left( {\boldsymbol{BY}\left( {c, s} \right)} \right)} \right] $ | (10) |

| $ \overline o = \sum\limits_{\theta = \left\{ {{0°}, {{45}°}, {{90}°}, {{135}°}} \right\}} {N\left( {\mathop \oplus \limits_{c = 2}^4 \mathop \oplus \limits_{s = c + 3}^{c + 4} N\left( {o\left( {c, s, \theta } \right)} \right)} \right)} $ | (11) |

其中:⊕表示多个尺度下相应特征显著图经线性插值调整到同一大小后相加;N为分别将各个显著图的显著值标准归一化到[0,1]区间。

对式(9)~(11) 的3类特征进行算术平均,即:

| $ s = (\bar I + \bar c + \bar o)/3 $ | (12) |

其中s即为输入图像的最终显著图。

通过分析基于金字塔的Itti模型,可以看出该模型简单易行,然而该模型存在缺陷:1) 在建立9层金字塔时由于对灰度值进行了截断处理导致部分高频信息的丢失,故提取的显著图边界不清晰;2) 模型计算复杂度高;3) 基于6个基准数据集,在3个评价指标准确率(precision)、召回率(recall)及F-measure评测下该模型性能表现较差。

1.2 谱残差方法性能分析在基于频域分析的显著模型中,Hou等[3]借助频域分析来探测和提取显著性区域,该算法的优点在于计算速度快,提取的显著图与人类的感知高度一致。

基于有效编码理论, Hou等[3]认为图像信息可分为冗余部分和变化部分,人类的视觉对变化部分更敏感。视觉系统的一个基本原则就是抑制对频繁出现的特征的响应,同时对非常规的特征保持敏感,由此可将图像表示为如下两部分:

| $ \boldsymbol{H}({\rm{Image}}){\rm{ = }}\boldsymbol{H}({\rm{Innovation}}) + \boldsymbol{H}({\rm{Prior}}) $ | (13) |

其中:H(Innovation)表示突出的部分;H(Prior)则表示冗余的信息。

通过去除图像冗余信息,就可以获得图像突出的部分,即显著目标。因为自然图像特性的1/f幅度谱曲线而引起自然图像的频域统计特性具有尺度不变性(scale invariance),其特性就是冗余的信息部分。

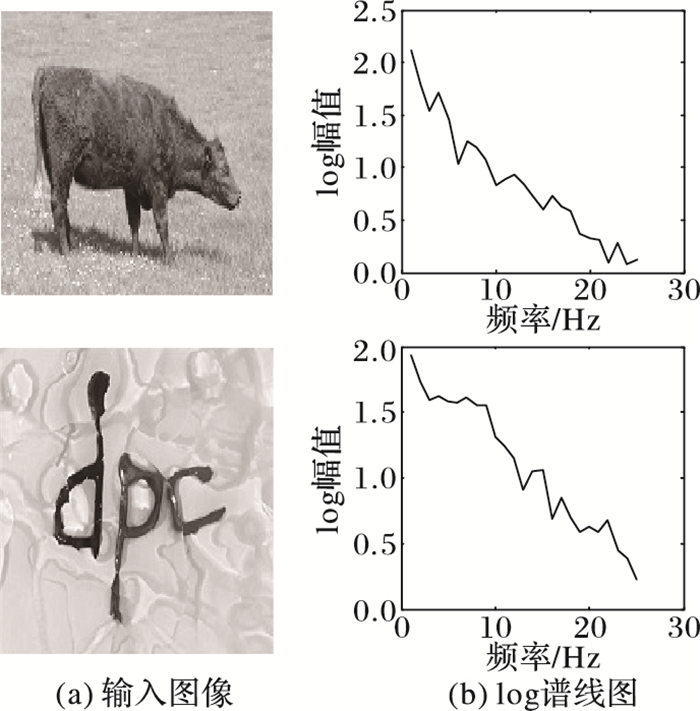

设I(x)为输入图像,将傅里叶变换后的频谱F[I(x)]分为幅度谱A(f)和相位谱P(f)。剩余谱认为自然图像的log谱线形状是相似的,如图 1所示。

|

图 1 输入图像及其log谱线图 Figure 1 Input images and its log spectrums |

假设图像的log谱线为L(f),而A(f)是log谱线统计得到的通用形状曲线,即冗余的信息部分,可以构建一个平滑滤波器hn(f)来得到A(f):

| $ \boldsymbol{A}(f) = {\boldsymbol{h}_n}(f) * \boldsymbol{L}(f) $ | (14) |

| $ {h_n}(f) = \frac{1}{{{n^2}}}\left( {\begin{array}{*{20}{c}} 1&1& \cdots &1\\ 1&1& \cdots &1\\ \vdots & \vdots &{}& \vdots \\ 1&1& \cdots &1 \end{array}} \right) $ | (15) |

其中n=3(n的大小对结果影响很小)。

谱残差算法认为在谱线中的奇异点为图像的显著区域,R(f)表示谱线中的奇异点,是输入图像的谱残差:

| $ \boldsymbol{R}(f) = L(f)-A(f) $ | (16) |

通过对谱残差和输入图像的相位谱作傅里叶逆变换得到显著图:

| $ \boldsymbol{SR}\left( x \right) = \boldsymbol{G}\left( x \right) * {\left| {{F^{- 1}}\left[{\exp \left( {\boldsymbol{R}\left( f \right) + \boldsymbol{P}\left( f \right)} \right)} \right]} \right|^2} $ | (17) |

其中G(x)为高斯平滑滤波器,F-1()为傅里叶逆变换。

虽然基于频域分析的显著性模型简单、高效,但是由于其忽略了输入图像区域间的空间关系,对输入图像颜色特征表达不足,基于6个基准数据集在3个评价指标上对该方法进行评测实验效果也不够理性。

2 基于倒数函数-谱残差(RFSR)方法为了解决Itti及Hou模型存在的问题,提出一种基于倒数函数-谱残差方法,其总体思路是综合利用图像的三个特征,即颜色、方向及谱残差,探测并融合生成图像显著图,所提出的方法由3个主要步骤构成,相应描述如下。

2.1 颜色特征提取颜色特征是显著性对象提取的重要线索之一,Kim等[9]提出的通过高维颜色变换的显著性探测方法和Zhu等[8]提出的鲁棒背景探测的显著性优化方法均是近期提出的以颜色特征为线索的显著性探测和提取模型。

在频域空间:图像显著性区域表现变化强烈,其对应于频谱中相对高频成分;而背景区域保持相对平滑,其对应于频谱中相对低频成分。所以,在频域空间通过过滤图像低频成分、突出高频成分理论上能够提取颜色显著性区域。

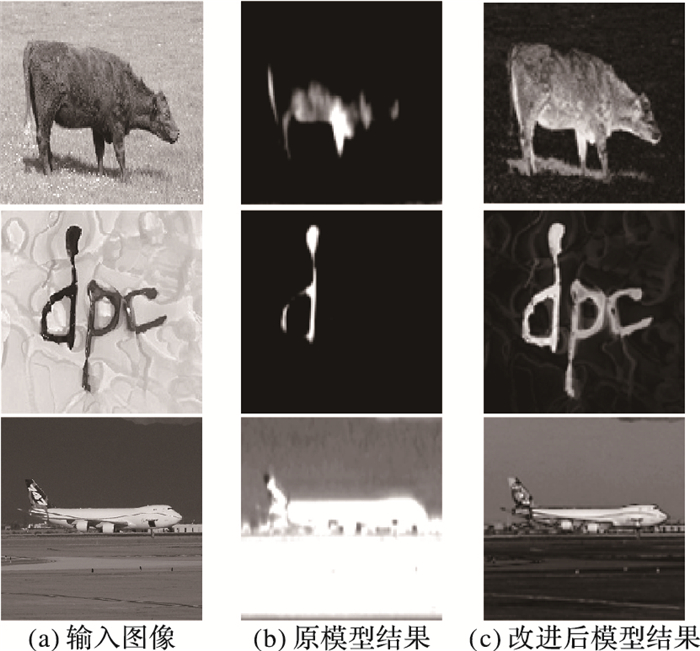

Itti模型中颜色特征提取对输入图像进行金字塔分层再利用“中心-周围”层之差提取颜色特征映射不仅计算量大,而且对灰度图像I标准化时进行了截断,滤波器不够光滑导致高频丢失严重。而利用高斯低通滤波器代替Itti模型中的直接截断,理论上能够有效地减少高频信息的丢失,实验结果也证明所提取的颜色特征显著性对象边界的平滑性明显得到改善,如图 2所示,图 2(b)是Itti模型在颜色分量上进行显著性提取的结果,图 2(c)是利用高斯低通滤波器代替Itti模型中直接截断后在颜色分量得到的结果。

|

图 2 在颜色分量上改进的Itti模型 Figure 2 Improved Itti model on color component |

对颜色特征提取的改进具体计算步骤如下:

1) 将输入图像I0通过变换(r+g+b)/3转化成灰度图像I;

2) 对灰度图像I进行高斯低通滤波Ig:

| $ \boldsymbol{I}'' = \left| {\boldsymbol{I}-{\boldsymbol{I}_{\rm{g}}}} \right| $ | (18) |

其中I″是改进的灰度特征映射,式(18) 中高斯低通滤波器

方向显著图的显著区域是图像中对比度强烈的区域的边缘信息。Itti模型中利用Gabor滤波提取显著对象的方向特征,方向特征刻画了显著对象的边界特征,但不是显著对象整体的表达。

李志强[13]构造了倒数余弦函数、指数函数及倒数函数等3种新的方向特征滤波函数,并在理论上对滤波函数满足的条件进行了分析和论证。这里,从实践上将倒数函数代替Itti模型中的方向滤波器——Gabor滤波器,从而得到一种新的局部方向特征提取方法——基于倒数函数的方向显著性提取方法。

为了构造基于倒数函数的方向显著性提取方法,首先定义该函数如下:

| $ \begin{array}{l} {G_{\theta {\rm{, }}\sigma {\rm{, }}\gamma }}\left( {x, y} \right) = 1/{\rm{[}}\sigma \times ({\left( {x{\rm{cos}}\theta + y{\rm{sin}}\theta } \right)^2} + \\ \;\;\;\;\;\;\;{\gamma ^2}{\left( {y{\rm{cos}}\theta-x{\rm{sin}}\theta } \right)^2}) + 1{\rm{]}} \end{array} $ | (19) |

其中:σ是控制参数;θ是方向角;γ是方向曲率。根据文献[9]的建议及实验结果对比,在实际应用中方向取四个方向,即θ∈{0, π/4, π/2, 3π/4},控制参数σ取2.33,方向曲率γ取0.5,在窗宽取34×34时提取的对象方向显著性效果达到最佳。

每个方向可以生成6个倒数函数金字塔,O′(σ, θ), σ∈{1, 2, …, 6}改进的金字塔图像方向特征映射为:

| $ {\boldsymbol{O}'}\left( {c, s, \theta } \right) = \left| {{\boldsymbol{O}'}\left( {c, \theta } \right) - {\boldsymbol{O}'}\left( {s, \theta } \right)} \right| $ | (20) |

其中:s=c+σ, c∈{1, 2, 3}, σ∈{2, 3},共计24个方向特征。将这24特征映射求和得到改进的整体显著对象方向特征映射:

| $ {\boldsymbol{O}{''}} = \sum\limits_{\theta = \left\{ {{0°}, {{45}°}, {{90}°}, {{135}°}} \right\}} {N\left( {\mathop \oplus \limits_{c = 1}^3 \mathop \oplus \limits_{s = c + 2}^{c{\rm{ + }}3} N\left( {{\boldsymbol{O}'}\left( {c, s, \theta } \right)} \right)} \right)} $ | (21) |

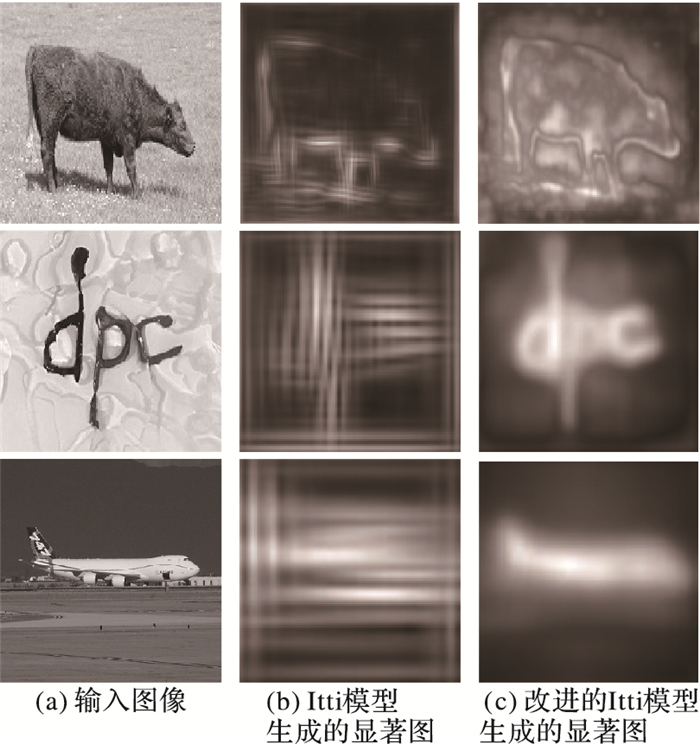

为了验证新的方向特征算法的效果,实验结果如图 3所示,图 3(b)是Itti模型在方向特征上的显著图,图 3(c)是新的方向特征算法提取的方向显著图。对比图 3(b)及(c)中的方向显著图可以看出,图 3(b)中的显著图虽然能够大致地反映显著对象的轮廓,但相关对象的轮廓主要由一些纹理组成,对象区域显得相对粗糙,对象边界也不够光滑。而与之形成对比的是,图 3(c)中相关显著对象区域均匀一致,显著对象在整体上得到了一致的提升,且对象边界保持光滑、完整。由此可见,新改进的基于倒数函数的方向特征显著性提取方法明显地优于Itti模型中的方向特征提取方法,为构建RFSR方法奠定了坚实的基础。

|

图 3 在方向分量上用倒数函数代替Gabor滤波器改进的Itti模型 Figure 3 Improved Itti model by substituting Gabor filter with reciprocal function filter for orientitation component |

从信息论的角度来看,可以将图像的信息分为有用信息和冗余信息两部分。去除图像冗余信息可以突出图像显著部分。图 1显示了两幅图像的对数幅度谱,比较它们的对数幅度谱曲线,整体上具有相似性。研究表明,任何一幅图像其对数频谱与频率曲线形状大致呈一条直线,当多幅图像叠加之后其曲线与这条直线会更加平滑,这表明平均对数幅度谱具有局部线性的特征,因此,将输入图像对数幅度谱减去平均对数幅度谱,其差表达了图像中的显著区域。平均对数幅度谱可通过对原始图像对数幅度谱应用一个n*n的均值滤波获得,n通常取3。谱残差特征映射计算如下:

| $ \boldsymbol{R} = \boldsymbol{L} - \boldsymbol{A} $ | (22) |

其中:L原始图像对数幅度谱;A原始图经过均值滤波后得到平均对数幅度谱;R为谱残差特征映射。

谱残差特征映射算法提取过程如下:

1) 读取图像,调整图像大小并转换为灰度图;

2) 进行傅里叶变换,并按1.2节中的方法求得谱残差;

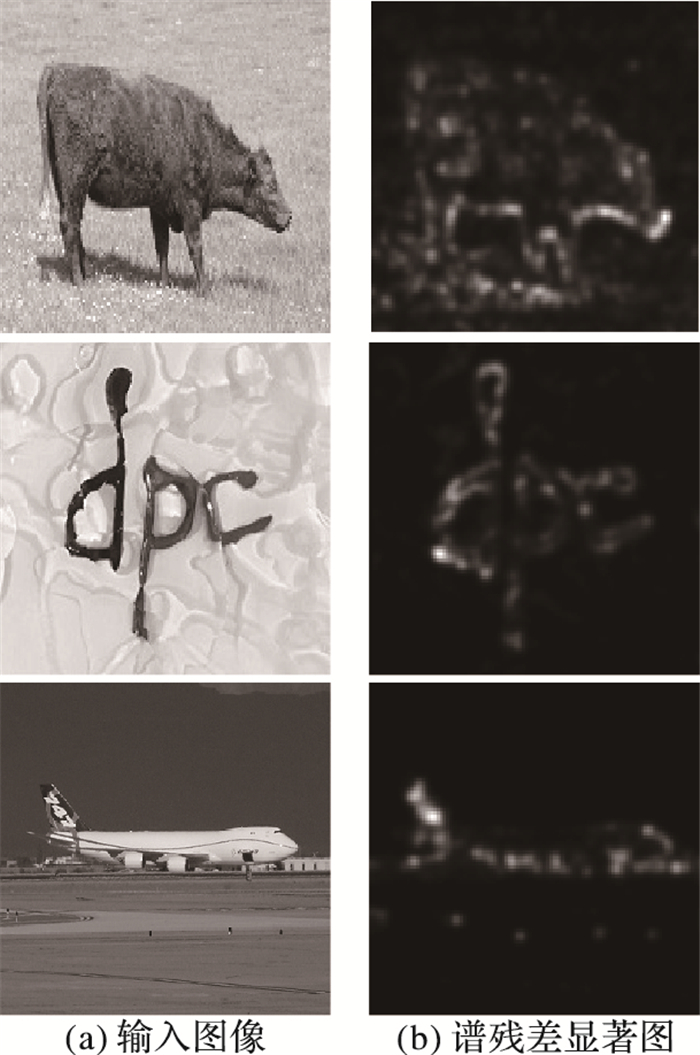

3) 进行傅里叶反变换,高斯滤波,再转换为灰度图,即得到谱残差特征映射图,如图 4(b)所示,可以看出,单一的谱残差方法提取的显著图是稀疏的,但它粗略地描述了对象的轮廓,可以作为后续被提出的显著性对象提取方法的一个补充部分。

|

图 4 谱残差方法 Figure 4 Spectral residual method |

对颜色、局部方向及谱残差等三种单一特征的显著提取方法进行了实验分析与比较,得到的一个结论是单一显著特征方法不足以表示显著对象的完整信息,如图 2(b)和(c)中的基于颜色成分的显著图,这些显著图有的仅突出了部分对象,有的突出显著对象的同时也突出了背景信息;对方向显著特征,由图 3(b)与(c)可以看出,不仅显著对象方向显著性被提升同时与背景对比较明显的区域显著性也被突出;对谱残差方法而言,如图 4(b)所示,所提取显著对象具有粗略的轮廓,但显著性区域是很稀疏的。虽然每个基于单一特征提取显著性的方法均存在自身的一些缺陷,然而从整体上来看它们却具有互补性,因此对以上的颜色特征、方向特征及谱残差特征方法进行算术平均,理论上是可行的。由此,RFSR方法被简单地定义为:

| $ S = \frac{1}{3}\left( {N\left( {{\boldsymbol{I}{''}}} \right) + N\left( {{\boldsymbol{O}{''}}} \right) + N\left( \boldsymbol{R} \right)} \right) $ | (23) |

这里,S为改进后的显著性映射图,N为分别将各个显著图的显著值在计算中均应进行归一化处理,运算符“+”为逐像素求和运算。

利用自适应的阈值方法[14]对显著性映射图进行二值化:

| $ T = \frac{2}{{w \times h}}\sum\limits_{i = 1}^w {\sum\limits_{j = 1}^h {S(i, j)} } $ | (24) |

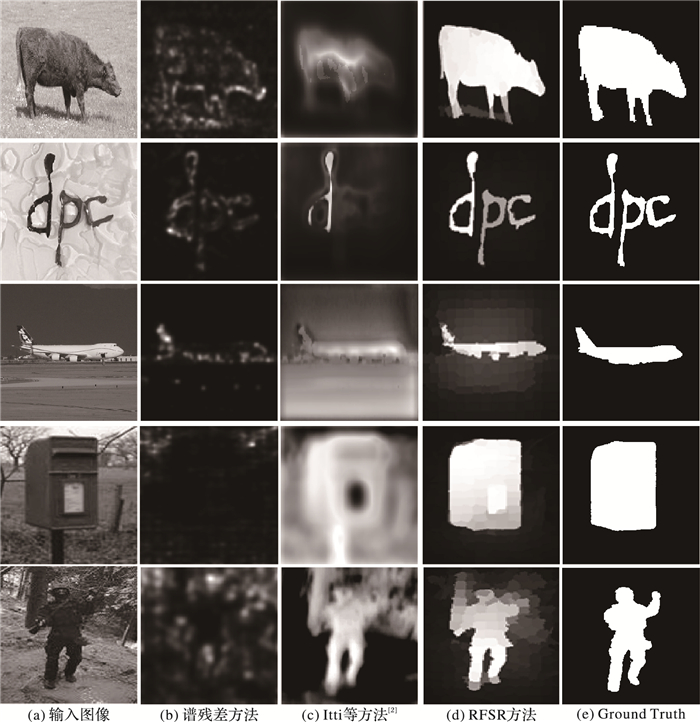

其中:w, h分别是显著性映射图水平方向及垂直方向的像素个数;T为自适应的阈值,将S>T的像素置为1,其他置为0,即生成显著性映射图的二值图。图 5显示了利用本文的RFSR方法在亚洲微软研究院基准数据集(Microsoft Research Asia, MSRA, http://mmcheng.net/gsal/)和扩展的复杂场景显著数据集[15](Extended Complex Scene Saliency Dataset, ECSSD)探测和提取显著对象的部分结果。

|

图 5 3种模型显著图对比 Figure 5 Saliency map comparison of three models |

如图 5所示,图 5(b)是谱残差方法提取的显著图,图 5(c)是Itti等方法[2]提取的显著图,图 5(d)是RFSR方法提取的显著图, 图 5(e)是人工标注的Ground Truth二值图。对比图 5前三行中(b)中的显著图可以看出,提取的显著图是稀疏的,且它只粗略地描述了对象的轮廓。图 5(c)中的显著图虽然能够大致地反映显著对象的轮廓和相对粗糙的显著对象对象区域,但显著对象的对象边界不够光滑,且有多个显著对象时,只提取了最突出的显著对象如图 5中第二行。而与之形成对比的是,图 5(d)中所提取的相关显著对象区域均匀一致,显著对象在整体上得到了一致的提升,且对象边界保持光滑、完整。对比图 5后两行中,当图像背景变复杂时,图 5(b)中谱残差方法很难提取图像的显著图。图 5(c)中Itti等方法[2]虽然能够大致地反映显著对象的轮廓和区域,但提取的显著对象包含了背景信息,整体区域变大。图 5(d)中所提取的显著对象在整体上较为完整,且边界保持光滑,且图 5(d)中所提取的显著对象与图 5(e)中人工标注的二值图大体一致。由此可见,综合倒数函数及剩余谱的对象探测和提取方法明显地优于谱残差方法与Itti等方法[2]。

3 实验结果与分析 3.1 对比模型由于Itti模型及Hou模型(谱残差方法)是显著对象探测及提取领域最具原创性的两个模型,自模型被提出以来一直得到研究人员的广泛关注,通常作为参考、改进与比较的对象,更详细的显著性探测领域的综述参见文献[10-11]。此外,由于所提出的RFSR模型基于Itti模型及Hou模型构建,为了更好地分析改进前后的效果,实验将所提出模型与这两个模型进行分析、对比。

3.2 实验数据集实验数据集选择常用的基准图像数据集MSRA10和ECSSD。其中每个数据集均由两组图像构成,一组为原始图像,另一组是对应的被称之为Ground Truth的人工标注二值图,如图 5(e)所示,白色(二值图中值为1的像素)区域为人工标注的显著对象。这两个数据集被常用作显著对象探测及提取方法的基准评测数据集。MSRA10数据集包含10000幅原图及对应的Ground Truth二值图,ECSSD数据集包含约1000幅原图及对应的Ground Truth二值图,后者图像场景及结构更复杂。

3.3 评价标准评价采用常用的三个评价指标:准确率(Precision)、召回率(Recall)及F-measure。准确率和召回率是度量显著性图与Ground Truth二值图符合度的量化指标,F-measure是对准确率(Precision)和召回率(Recall)的综合量化指标,更具可靠性。

设Ground Truth二值图为Gn, Sn为二值化的显著图,其中Gn取0或1,表示G的第n个像素。当Gn=1时,表示属于显著区域;相反地,Gn=0表示属于背景;Sn为显著图二值化的像素,其定义与Gn类似。于是,准确率、召回率计算如下:

| $ Precision = \left( {\sum\limits_{n = 1}^N {{G_n} \times {S_n}} } \right)/\left( {\sum\limits_{n = 1}^N {{S_n}} } \right) $ | (25) |

| $ Recall = \left( {\sum\limits_{n = 1}^N {{G_n} \times {S_n}} } \right)/\left( {\sum\limits_{n = 1}^N {{G_n}} } \right) $ | (26) |

综合评价指标(F-measure)是准确率和召回率的加权调和平均,其按式(27) 计算:

| $ F = \frac{{\left( {{\alpha ^2} + 1} \right)P * R}}{{{\alpha ^2}\left( {P + R} \right)}} $ | (27) |

式(27) 中,实际计算中α取值0.3[10-11],以下实验分析α均置该值。

式(25) 定义的准确率反映了探测出的并含在Ground Truth中的显著像素与探测出的显著像素之比,体现了探测的有效像素在整个显著像素中的百分比,准确率越高则算法探测的正确性越高。而式(26) 定义的召回率则反映的是探测出的包含在Ground Truth中的显著像素与总的Ground Truth像素比,体现了被探测出的有效显著像素与实际有效像素之比,召回率越高则探测出的显著性目标越完整。一般来说,三个评价指标的值越大,表明模型探测和提取的显著区域越理想。

图 6是三个模型在MSRA10和ECSSD数据集上利用区间[0,1]上以0.05为步长的每个阈值二值分割提取显著性图,并在每个阈值点上计算准确率(Precision)和召回率(Recall)画出的P-R曲线。总体来看,图 6中的带有正方形曲线(RFSR)始终处在菱形(Itti)及三角(Hou)曲线之上,当准确率一定时,RFSR的召回率比其他两种召回率要高,RFSR检测出的显著性目标越完整。当召回率一定时,RFSR的准确率比其他两种准确率要高,RFSR检测的正确性越高。由此可见,RFSR方法优于谱残差方法和Itti等方法[2]。

|

图 6 三种方法的P-R曲线对比 Figure 6 P-R curves comparison of three methods |

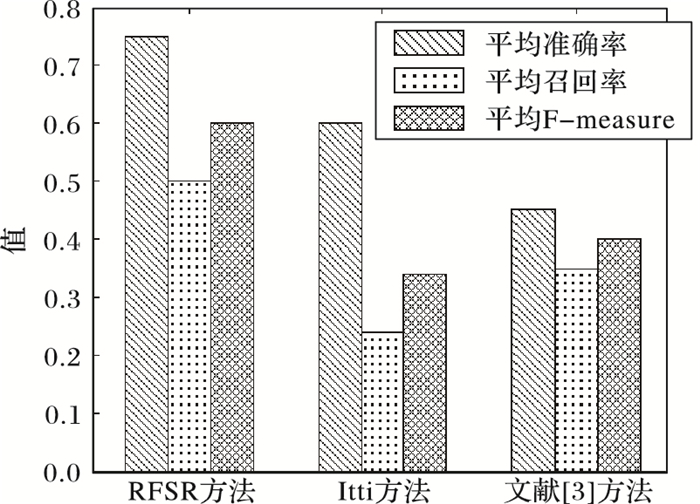

图 7是三个模型在MSRA10和ECSSD数据集上的平均准确率、平均召回率及平均F-measure,其中带斜纹的矩形区域表示平均准确率,带点状的矩形区域表示平均召回率,带点交叉状的矩形区域表示平均F-measure。沿水平坐标自左向右,分别是RFSR、Itti及Hou模型的点绘结果,RFSR模型在三个指标上均明显地优于其他两个模型的相应指标。

|

图 7 不同方法的Precision、Recall及F-measure对比 Figure 7 Precision, Recall and F-measure comparison of three methods |

除了上述量化评价之外,如图 5所示,将(b)、(c)、(d)列与(e)列的Ground Truth进行对比,显然本文提出的RFSR算法提取的显著图(d)列明显优于(b)和(c)。

总之,通过实验结果分析及量化指标评价,本文被提出的RFSR方法相对Itti及Hou模型在显著对象探测效果及性能方面均有明显提高。

4 结语本文提出了一种新的综合倒数函数及剩余谱的对象探测和提取方法,通过在MSRA10及ECSSD两个常用基准数据集基于3个常用评价指标进行评测,与Itti模型和Hou模型进行性能对比,结果表明,本文方法取得的显著图效果在准确率、召回率及F-measure 3个指标上均明显地优于Itti模型和Hou模型。本文提出的RFSR算法对包含单显著对象图像探测及提取效果较好,对包含多显著对象图像的探测和提取改进效果不明显,这将是接下来显著对象探测与提取研究的方向。

| [1] | KOCH C, ULLMAN S. Shifts in selective visual attention:towards the underlying neural circuitry[J]. Human Neurobiology, 1985, 4(4): 219-227. |

| [2] | ITTI L, KOCH C, NIEBUR E. A model of saliency-based visual attention for rapid scene analysis[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1998, 20(11): 1254-1259. DOI:10.1109/34.730558 |

| [3] | HOU X, ZHANG L. Saliency detection:a spectral residual ap-proach[C]//CVPR' 07:Proceedings of the 2007 IEEE Conference on Computer Vision and Pattern Recognition Workshops. Washington, DC:IEEE Computer Society, 2007:1-8. |

| [4] | FU K, GONG C, YANG J, et al. Superpixel based color contrast and color distribution driven salient object detection[J]. Signal Processing Image Communication, 2013, 28(10): 1448-1463. DOI:10.1016/j.image.2013.07.005 |

| [5] | JIANG B, ZHANG L, LU H, et al. Saliency detection via absorbing Markov chain[C]//Proceedings of the 2013 IEEE International Conference on Computer Vision. Piscataway, NJ:IEEE, 2013:1665-1672. |

| [6] | YAN Q, XU L, SHI J, et al. Hierarchical saliency detection[C]//Proceedings of the 2013 IEEE Conference on Computer Vision and Pattern Recognition Workshops. Washington, DC:IEEE Computer Society, 2013:1155-1162. |

| [7] | LIANG Z, WANG M, ZHOU X, et al. Salient object detection based on regions[J]. Multimedia Tools & Applications, 2014, 68(3): 517-544. |

| [8] | ZHU W, LIANG S, WEI Y, et al. Saliency optimization from robust background detection[C]//Proceedings of the 2014 IEEE Confer-ence on Computer Vision and Pattern Recognition Workshops. Washington, DC:IEEE Computer Society, 2014:2814-2821. |

| [9] | KIM J, HAN D, TAI Y W, et al. Salient region detection via high-dimensional color transform and local spatial support[J]. IEEE Transactions on Image Processing, 2014, 25(1): 9-23. |

| [10] | BORJI A, CHENG M M, JIANG H, et al. Salient object detection:a survey[J]. Eprint Arxiv, 2014, 16(7): 3118. |

| [11] | BORJI A, CHENG M M, JIANG H, et al. Salient object detection:a benchmark[J]. IEEE Transactions on Image Processing, 2015, 24(12): 5706-5722. DOI:10.1109/TIP.2015.2487833 |

| [12] | 玉振明, 高飞. 基于金字塔方法的图像融合原理及性能评价[J]. 计算机应用研究, 2004, 21(10): 128-130. (YU Z M, GAO F. Laplacian pyramid and contrast pyramid based image fusion and their performance comparison[J]. Application Research of Computers, 2004, 21(10): 128-130. DOI:10.3969/j.issn.1001-3695.2004.10.045) |

| [13] |

李志强. 视觉显著性模型研究及其在影像处理中的应用[D]. 上海: 上海交通大学, 2009: 37-89. LI Z Q. Research on visual attention models and application on imagery processing[D]. Shanghai:Shanghai Jiao Tong University, 2009:37-89. |

| [14] | CHAN F, LAM H Y, ZHU F K. Adaptive thresholding by vibrational method[J]. IEEE Transactions on Image Processing, 1998, 7(3): 468-473. DOI:10.1109/83.661196 |

| [15] | YANG C, ZHANG L, LU H, et al. Saliency detection via graph-based manifold ranking[C]//Proceedings of the 2013 IEEE International Conference on Computer Vision and Pattern Recognition Workshops. Washington, DC:IEEE Computer Society, 2013:3166-3173. |