随着微博、博客等社交网络平台的快速发展,越来越多人通过网络发表评论。这些评论信息数量巨大、形式多样,其中蕴含大量个人观点,对其进行分析,能为商家、政府部门等[1]提供决策依据,因此观点检测研究被广泛关注。观点检测通过自然语言处理及机器学习方法,运用观点提取、极性分析等技术获得分析结果。目前研究者已在该领域展开了大量工作。

从观点检测的语料看,现有研究有域独立和域相关两种。域独立指测试集与训练集可来自不同领域。Yang等[2]用影评、商品评论语料等进行跨域学习,对50个不同主题观点检测的精度高于平均值40%~60%。Seki等[3]将商品评论语料用于产品主题的观点检测,获得了良好性能,但在政治领域的性能较差。域相关指检测方法仅适用于特定领域。Owsley等[4]证明了由于人们在不同域的常用词汇不同,观点检测性能因领域不同存在很大差异。Na等[5]的研究表明,建立基于特定域的词典可以提高检测性能。总体来看,域相关方法性能更优,但牺牲了适用范围[6]。现有观点检测常被视为情感分析问题,主要方法有自然语言处理方法和机器学习的方法。自然语言方法通过分析自然语言结构进行极性判断。Hu等[7]以名词和名词词组为特征词,提取特征词周围的形容词为观点内容。Liu等[8]先提取形容词、动词等,再运用“左侧关系”提取相应特征词。基于机器学习的方法多将观点检测视为分类问题,常见模型如朴素贝叶斯、支持向量机等,均被用于观点检测。观点极性判别策略有定性和定量两种。Hu等及Kim等根据积极词和消极词的数量对极性进行定性判别,Esuli等[11]在判断主观词极性的同时进行了定量评价。

总体来看,虽然观点检测领域已展开了大量研究,但社交网络平台的用户广泛参与性使观点表达形式日趋多样,推动社交网络文本语义发生演化,使现有研究面临新的问题。例如一般认为客观句不包含观点,但客观句同样可以包含观点。如对“俄罗斯在叙利亚的反恐行动”话题的评论句“这是以反恐的名义在实行战争”,该句是客观句,其中并未出现话题,但表达了对话题的消极观点。另外有情感极性的文本未必包含观点,如话题“IphoneSE”的评论句“我只是喜欢新手机的感觉而已”,虽然具有积极情感,但不表达对“IphoneSE”的任何观点。说明用情感分析方法进行观点检测,在面对语义更为丰富的社交网络文本时还存在不足。

本文对特定话题的网络评论文本进行观点检测,观点包括支持 (FAVOR) 和反对 (AGAINST) 两类。文本存在话题缺失或情感特征缺失的问题,其评论的话题可能未出现,可能有情感特征但无观点,或有观点但不针对话题,对此,将研究重点放在如何根据非情感特征推断话题观点。本文提出构建实体情感演化置信网的方法,通过提取域相关实体和情感特征,构建贝叶斯置信网,刻画观点与实体、情感特征的依赖关系,进而对话题观点进行推断。

1 域相关实体抽取基于情感分析的检测方法常根据情感特征推断观点极性。由于社交网络公共事件频发,评论人群体多样,观点表达方式多样,许多非情感特征的名词、动词在特定语境中产生了情感极性。如话题“春节放鞭炮”,有如下FAVOR类评论:

1)“兄弟姐妹抢着贴春联、放鞭炮。”

2)“这是我国的传统民俗。”

句1) 中名词性实体“春联”表达了积极极性,间接表达了对话题的支持观点;句2) 中未出现情感词,但名词性实体“传统民俗”表达了对“春节放鞭炮”的积极极性,间接表达了对话题的支持观点。可见在特定事件背景下,一系列名词性实体、动名词短语演化产生了情感的内涵。评论者表达观点并非一定用情感词,用实体表达观点的语言形式已非常普遍。如“这又是一个官二代事件”,通过名词性实体“官二代”表达了AGAINST观点。本文对5个话题的FAVOR和AGAINST评论提取名词实体。先去除话题中的实体,再分别去除两类的前10个高频共现实体,得到按词频降序排列的部分中频实体如表 1所示。

| 表 1 实体与观点共现情况 Table 1 Co-occurrence of entities and stance |

可见实体与话题观点有显著共现关系,当话题缺失时,通过评论中的实体也能推断话题观点。即判断对事件A的观点,但评论者从未提及A,则通过评论者谈及的事件B及对B的观点,可间接推断对A的观点。其中事件B由于在事件A下产生了情感的内涵,本文将其称为从事件演化产生情感内涵的实体,对其进行抽取,可用于话题观点检测。

从事件演化产生情感内涵的实体应对事件具有强烈的相关性或指代性,除名词外,部分短语的相关性也较好。如话题“俄罗斯在叙利亚的反恐行动”中,短语“土耳其……分子”常表达对土耳其的消极观点,间接表达了对话题的积极态度。因此本文提取的实体包括三类:名词 (n)、动宾短语 (Verb-OBject structure, VOB)、定中结构短语 (ATTributive-centered structure, ATT)。ATT是中心-边缘图式结构[12],由定语修饰中心语构成。本文提取的定中结构是名词复合型定中短语,包括名词词组和动词+名词词组。对其他定语为形容词、代词等定中短语,认为其定语部分对事件的指代性不足,不予提取。用哈尔滨工业大学的语言技术平台 (Language Technology Platform, LTP) 进行句法依存分析及词性标注,本文抽取的部分实体如表 2所示。

| 表 2 实体及其词性构成 Table 2 Entities and part of speech |

表 2中定中短语“中国@对立面”,其中心词为“对立面”,定语为“中国”,是名词复合型结构。对定中短语“这@一只@土鸡”,其中心词为名词“土鸡”,而“这”“一只”是非动词性限定词,则对该定中短语不予提取,仅提取其名词中心词“土鸡”。

为保证检测准确率,本文抽取的实体是同一话题中的域相关实体。对任一文本d={t1, t2, …, tm},其中ti为d的词项。用哈尔滨工业大学LTP进行句法依存分析及词性标注。其中ti.depdence为ti所处的依存关系,ti.parent为ti的依存词的编号,tparent为ti的依存词,实体entity的抽取如算法1所示。

1) 令实体集E={∅}

2) for each ti in d

entity = ti

if ti是名词

if ti.depdence = ‘ATT’

parent = ti.parent

do

entity = entity.contact(‘@’).contact(tparent)

parent = tparent.parent

while tparent.depdence = ‘ATT’

if tparent.depdence = ‘VOB’

entity = tparent.contact(‘@’).contact(entity)

endif ‘VOB’

E=E∪{entity}

endif ‘ATT’

if ti.depdence = ‘VOB’

parent = ti.parent

entity = tparent.contact(‘@’).contact(entity)

E=E∪{entity}

endif ‘VOB’

E=E∪{entity}

endif

endfor

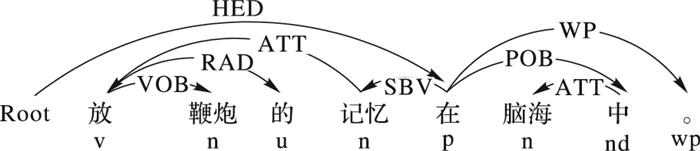

算法首先检索文本中的名词,再以名词为中心,获取其依存关系为ATT或VOB关系中的相关词,连接形成实体。如句子“放鞭炮的记忆留在脑海中。”依存关系如图 1所示。

|

图 1 文本的依存关系示例 Figure 1 Sample of text dependence relationship |

抽取的实体为:鞭炮,记忆,脑海,放@鞭炮,放@鞭炮@记忆,脑海@中。算法中所有词或短语,在实体抽取前均先判定是否为情感词,将情感词作为情感特征,不作为实体进行抽取。

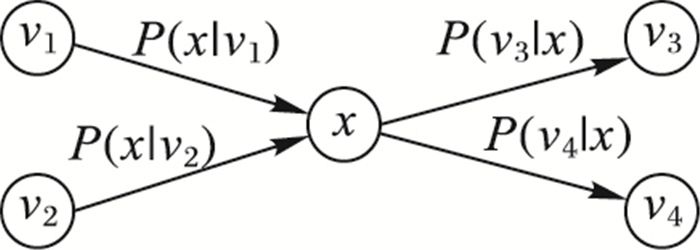

2 实体情感演化置信网贝叶斯网络 (Bayesian Network,BN) 也叫置信网 (Belief Net),它通过一些变量的信息获取其他概率信息,是对不确定性进行建模的有效工具[13]。BN的拓扑结构如图 2所示。其中节点v1、v2为x的父节点,v3、v4为x的子节点,弧表示节点间的直接依赖关系[14],弧上的权值是关联到每个节点的条件概率,描述了依赖关系的强弱。

|

图 2 贝叶斯网络拓扑结构 Figure 2 Topological structure of Bayesian network |

用v=(vp, vc) 表示非x节点的状态值,P(x|vp) 表示父节点状态为vp时x的条件概率,P(vc|x) 表示x对其子节点状态vc 的条件概率,节点x的置信度P(x|v) 是指给定v时,非x节点与x的相关概率,如式 (1)[15]所示:

| $ P\left( {x|v} \right) \propto P\left( {{v^c}|x} \right)P\left( {x|{v^p}} \right) $ | (1) |

可见节点x的置信度由其父节点及子节点的状态共同决定。用cj表示第j个子节点,vcj表示cj状态的概率,|C|表示子节点数,p(vcj|x) 表示x在某状态下子节点cj的条件概率;pi表示第i个父节点,vpi表示pi的状态,|P|表示父节点数,P(pi) 表示父节点pi的先验概率,p(x|pmn) 表示父节点pm在状态n时x的条件概率。根据朴素贝叶斯独立性假设,将式 (1) 改写为式 (2):

| $ P\left( {x|v} \right) \propto \prod\limits_{j = 1}^{\left| C \right|} {P\left( {{v_{{c_j}}}|x} \right)\left[{\sum\limits_{all{p_{mn}}} {P\left( {x|{p_{mn}}} \right)\prod\limits_{i = 1}^{\left| P \right|} {P\left( {{p_i}} \right)} } } \right]} $ | (2) |

将BN用于分类时,网络以类别为根,所有特征均为根的子节点。分类是根据子节点的状态计算根的置信度,取置信度最大的状态为分类结果。如忽略特征间的依赖,对子节点作独立性假设,则根据式 (2) 推断根的置信度,就是朴素贝叶斯分类。为了合理利用特征间的依赖信息以改善分类性能,Sahami[16]提出了k阶依赖扩展的贝叶斯分类器 (k-Dependence Bayesian network classifier,KDB),即每个特征节点除根节点外,至多还可以有k个非根父节点。

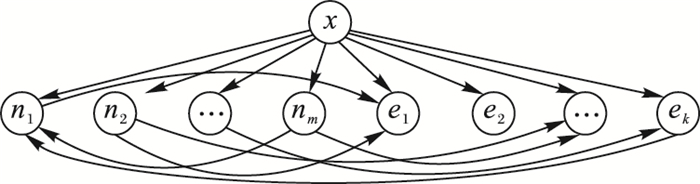

对观点检测问题,待测文本话题缺失或情感特征缺失可能影响检测性能。考虑观点、实体、情感特征间存在形如〈观点,实体〉、〈观点,情感特征〉、〈情感特征,实体〉的依赖关系,用贝叶斯网络刻画这种关系,可在部分特征缺失时仍能推断观点极性,因此本文提出构建贝叶斯置信网进行观点检测。以观点为根,作为类别节点,其余实体、情感特征为根的子节点。对子节点间的依赖关系,综合考虑分类正确率和效率[17],本文进行2阶依赖扩展,由此得到图 3所示2阶依赖扩展贝叶斯网络,将其称为实体情感演化置信网 (Entity-emotion Evolution Belief Net, EEBN)。其中根节点x为观点,EN={n1,n2,…,nm}为实体特征集,EM={e1,e2,…,ek}为情感特征集,弧表示节点间的依赖关系。EEBN可根据EN和EM节点共同推断x的状态,在情感特征缺失或话题缺失时保证观点检测的召回率。另外,对特征节点进行2阶依赖扩展,充分利用特征间的依赖信息,可在一定程度上提高分类性能。

|

图 3 实体情感演化置信网 Figure 3 Entity-emotion evolution belief net |

为适度简化网络结构,在考虑特征节点依赖关系时,对情感特征进行独立性假设。对任一特征节点f,其非根弧头节点为fp,二者具有实体-实体 (Entity by Entity, E-E),或实体-情感特征 (Entity by Emotion, E-EM) 依赖,描述如下:

1) E-E依赖:fp∈EN and f∈EN

2) E-EM依赖:(fp∈EN and f∈EM) or (fp∈EM and f∈EN)

即EEBN只存在实体间、实体和情感特征间的依赖。如图 2中实体特征n1入度为3,其非根父节点ek为情感特征,nm为实体特征;情感特征e1入度为3,其非根父节点为n1、n2均为实体特征。

对网络结构的学习,文献[18]提出了一种基于KDB的连接强度权重方法。设置连接强度weight,在计算特征对互信息时,仅考虑大小为weight的窗口内共现的特征对,但其weight的设置具有较大的启发式特征。本文运用文献[18]方法学习网络结构。由于文本中实体和情感特征多点出现,难以对连接强度设置较好的经验值,对此本文提出了可变连接强度的方法,对EEBN的两种依赖分别设置连接强度,具体如下:

1) E-E强度:由于全文的实体都基于特定话题产生,其间均存在不同强度的关联,因此将E-E依赖的连接强度置为全文长度;

2) E-EM强度:由于情感多基于实体产生,实体与情感特征距离越近,其关系越紧密,因此将E-EM依赖的连接强度置为一个句子的长度。

令观点类别为X,实体集为EN,情感特征集为EM,特征集F=EN∪EM={f1, f2, …, fs},其中fi为F的1个特征项。对特征对 (fi, fj) 的连接强度互信息MIweight(fi, fj|X),计算时只考虑全文范围内共现的实体对,及共现在同一句子内的实体、情感特征对。本文贝叶斯网络结构学习如算法2所示:

1) for each fi in F

计算fi与类别X的互信息MI(fi, X):

endfor

2) sort F order by MI(fi, X)1 < =i < =s desc

3) for each特征对 (fi, fj)1≤i, j≤s, i≠j

计算可变连接强度互信息MIweight(fi, fj |X):

endfor

其中weight根据fi和fj的特征类别,分别为E-E强度或E-EM强度,由此得到特征对互信息矩阵

4) 初始化贝叶斯网络N={X}

5) 重复以下步骤,直到N包括F中所有节点:

① 选择一个节点fm,满足如下2个条件:

c1:

c2: foreach fn∈N and n≠m

MI(fn, X) < MI(fm, X)

② N=N∪{fm},添加一条由X指向fm的弧

③ 添加最多k条不重复的由fj指向fm的弧,其中fj满足如下3个条件:

c1: fj∈N

c2: fj与fm存在E-E或E-EM依赖

c3: foreach fn∈N and n≠j and n≠m

MIweight(fn, fm|X) < MIweight(fj, fm|X)

6) 根据网络N计算全概率表

对EEBN的情感特征节点,由于本文重点讨论如何利用域相关实体提高检测性能,故对情感特征结构不作详述。本文采用的结构为否定副词+情感词。

3 实验结果及分析实验语料来自自然语言处理与中文计算2016(Natural Language Processing & Chinese Computing 2016, NLP&CC2016) 评测。训练集包含5个话题,每个话题分别有FAVOR和AGAINST两类评论各300条。以每个话题评论的75%用于训练,25%用于测试,用哈尔滨工业大学LTP进行依存关系分析,用正确率 (Precision, P)、召回率 (Recall, R)、F值为评价指标。以只包含情感特征的BN为Baseline1;包含实体及情感特征、但没有依赖扩展的BN为EEBN0;包含实体及情感特征、且有2阶依赖扩展的BN为EEBN2。为观察引入实体特征的有效性,各训练集均保留提取的全部实体及情感特征,表 3所示为5个话题上的平均测试结果。

| 表 3 不同方法观点检测结果对比% Table 3 Comparison of opinion detection results of different methods% |

从表 3可以看出, EEBN0比Baseline1的两类正确率分别提高4.1个百分点和3.1百分点,F值分别提高2.6百分点和2.8百分点,整体性能优于Baseline1,表明本文的实体特征对观点具有较好的指代性,可缓解话题或情感特征缺失时观点无法召回的问题。EEBN2的两类F值平均达0.7083,其整体测试性能最优,但EEBN2的召回率比EEBN0无显著提高。对网络结构的学习方法,分别以KDB方法的2阶网络为Baseline2、以文献[18]方法的2阶网络为Baseline3(连接强度权重设为20[18]),与EEBN2对比测试结果如表 4所示。

| 表 4 不同方法建立的网络结构有效性对比% Table 4 Comparison of network structure effectiveness of different methods% |

可见EEBN2由于只考虑实体与情感特征的依赖,从一定程度减少了计算复杂度,并保持了分类性能。虽然其召回率无显著提高,但正确率及F值均优于Baseline2、Baseline3,表明本文用可变连接强度约束特征依赖性的网络结构学习方法是有效的。总体来看,本文提出的EEBN检测可以在保持召回率的同时提高检测正确率。分析EEBN2召回率无显著提高的原因,EEBN2加入特征依赖信息,用连接强度权重约束特征的关联强度,通过改善网络结构有效性提高了检测正确率,但其更强调特征的共现性,因此制约了召回率的提高。另外,由于本文抽取的是域相关实体,因此训练集大小及训练样本质量也是制约召回率的重要因素。本文方法参加了NLP&CC2016评测,对5个话题的3000条评论文本进行观点检测,表 5为对5个话题的平均检测性能,本文方法与评测结果的比较。

| 表 5 NLP&CC2016评测结果 Table 5 Results of NLP&CC2016 evaluation |

在评测的16组测试结果中,两类平均F值为60.4%,最高为71.1%,应用本文方法的F值达62.3%,两类各自的F值也均优于评测的平均水平,从一定程度上表明了本文方法的有效性。

4 结语针对网络评论文本在主题或情感特征缺失时的观点检测问题,提出了基于实体情感演化置信网的检测方法。通过构建实体情感演化置信网,用特征与观点及特征间的依赖关系,推断观点极性,并设置可变连接强度作为网络结构学习的约束条件,在简化网络结构的同时提高其有效性。实验表明,本文提取的实体与观点极性具有较好的相关性,可从一定程度提高情感特征缺失,或有情感、无观点文本的观点检测性能,在保证召回率的同时提高检测正确率。在NLP&CC2016评测中,本文方法在5个话题上的测试性能均达到或优于评测平均水平,也从一定程度上表明了本文方法的有效性。

实际上,除本文抽取的实体外,实体特征还可能有更多的结构,有必要学习和发现更多与观点相关的语法特征。另外,网络结构方面,本文的E-E、E-EM依赖是基于人工对大量训练样本的分析提出的,具有一定的启发式特征。后续将在提高网络结构的正确性以及将单一网络扩展为多网络的组合决策模型方面,展开进一步研究。

| [1] | RAYMOND N, PATRICIA C, DENILSON B, et al. Perspectives on business intelligence[R]. Ontario:University of Waterloo, 2013. |

| [2] | YANG H, LUO S, CALLAN J. Knowledge transfer and opinion detection in the TREC2006 blog track[EB/OL].[2016-06-20].http://trec.nist.gov/pubs/trec15/papers/cmu.blog.final.pdf. |

| [3] | SEKI K, UEHARA K. Adaptive subjective triggers for opinionated document retrieval[C]//Proceedings of the 2nd ACM International Conference on Web Search and Data Mining. New York:ACM, 2009:25-33. |

| [4] | OWSLEY S, SOOD S, HAMMOND K. Domain specific affective classification of documents[C]//Proceedings of AAAI Symposium on Computational Approaches to Analysing Weblogs. Menlo Park, CA:AAAI, 2006:181-183. |

| [5] | NA S, LEE Y, NAM S, et al. Improving opinion retrieval based on query-specific sentiment Lexicon[C]//Proceedings of the 31th European Conference on IR Research on Advances in Information Retrieval. Berlin:Springer-Verlag, 2009:734-738. |

| [6] | 陈旻, 朱凡微, 吴明晖, 等. 观点挖掘综述[J]. 浙江大学学报 (工学版), 2014, 48(8): 1461-1472. ( CHEN M, ZHU F W, WU M H, et al. Survey of opinion mining[J]. Journal of Zhejiang University (Engineering Science), 2014, 48(8): 1461-1472. ) |

| [7] | HU M Q, LIU B. Mining opinion features in customer reviews[C]//Proceedings of the 19th National Conference on Artificial Intelligence. Menlo Park, CA:AAAI, 2004:755-760. |

| [8] | LIU L Z, LYU Z X. Extract produce features in Chinese Web for opinion mining[J]. Journal of Software, 2013, 8(3): 627-632. |

| [9] | HU M Q, LIU B. Mining and summarizing customer reviews[C]//Proceedings of the 10th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York:ACM, 2004:168-177. |

| [10] | KIM S, HOVY E. Determining the sentiment of opinions[C]//Proceedings of the 20th International Conference on Computational Linguistics. Stroudsburg:ACL, 2004:Article No. 1367. |

| [11] | ESULI A, SEBASTIANI F. SentiWordNet:a publicly available lexical resource for opinion mining[C]//Proceedings of the 5th International Conference on Language Resources and Evaluation. Genoa:European Language Resources Association, 2006:417-422. |

| [12] | 余淼淼, 张涛. 《荀子》中的定中结构词汇及短语分析[J]. 大众文艺, 2008(10): 66-67. ( YU M M, ZHANG T. Analysis of attributive centered structure vocabulary and phrase in "Xunzi"[J]. Art and Literature for the Masses, 2008(10): 66-67. doi: 10.3969/j.issn.1007-5828.2008.10.058 ) |

| [13] | KOLLER D, FRIEDMAN N. Probabilistic graphical models:principles and techniques[M]. Cambridge: MIT Press, 2009 : 50 -51. |

| [14] | 肖蒙, 张友鹏. 小数据集条件下的多态系统贝叶斯网络参数学习[J]. 计算机科学, 2015, 42(4): 253-257. ( XIAO M, ZHANG Y P. Parameters learning of Bayesian networks for multistate system with small sample[J]. Computer Science, 2015, 42(4): 253-257. doi: 10.11896/j.issn.1002-137X.2015.04.052 ) |

| [15] | DUDA R O, HART P E, STORK D G. Pattern Classification[M]. New York: John Wiley & Sons, 2003 : 46 -47. |

| [16] | SAHAMI M. Learning limited dependence Bayesian classifiers[C]//Proceedings of the 2nd International Conference on Knowledge Discovery and Data Mining. New York:ACM, 1996:335-338. |

| [17] | 张剑飞, 刘克会, 杜晓昕. 基于k阶依赖扩展的贝叶斯网络分类器集成学习算法[J]. 东北师大学报 (自然科学版), 2016, 48(1): 65-71. ( ZHANG J F, LIU K H, DU X X. Ensemble learning base k-dependence Bayesian network classifiers[J]. Journal of Northeast Normal University (Nature Science Edition), 2016, 48(1): 65-71. ) |

| [18] | 郭泗辉, 樊兴华. 一种改进的贝叶斯网络短文本分类算法[J]. 广西师范大学学报 (自然科学版), 2010, 28(3): 140-143. ( GUO S H, FAN X H. An improved short text classification algorithm based on Bayesian network[J]. Journal of Guangxi Normal University (Natural Science Edition), 2010, 28(3): 140-143. ) |