尽管目前人脸识别技术在现实生活当中得到了许多应用,但是人脸识别技术仍然是研究的热点。在人脸识别的实际应用过程中会受到外部许多因素的干扰而使面部识别效果降低,比如不同的光照条件、面部表情、姿势和遮挡等因素,而且面部有效的可鉴别特征存在于高维图像的子空间中。高维子空间中存在大量的冗余信息,这样不但消耗大量的数据处理时间,而且对最后的分类结果造成很大的影响。

传统的人脸识别方法是通过变换轴来进行分类的,研究人员提出了许多局部线性变换方法,这类算法的变换轴是通过训练样本来进行构造的。Harandi等[1]尝试获得面部空间局部最优的变换轴。Sugiyama等[2]提出了一种十分有效的处理样本多样化问题的变换方法,这种变换方法结合了线性鉴别分析(Linear Discriminant Analysis, LDA)和局部保持投影(Locality Preserving Projection, LPP)。Liu等[3]提出在特征提取过程中使用了局部主成分分析(Local Principal Component Analysis, LPCA)方法。

在图像重建[4]过程中使用稀疏表示(Sparse Representation-based Pattern Classification, SRC)是近期研究的热点,将稀疏表示理论运用到人脸识别中,利用训练样本来线性地表示测试样本,通过计算测试样本与训练样本的线性表示的误差来进行样本的分类。文献[5-10]都是使用训练样本的线性组合来表示测试样本。在处理高维小样本数据时,可以有效地避免维数灾难以及因降维而导致数据结构信息的缺失,这样可以提高人脸识别算法在实际应用过程中的鲁棒性。

基于SRC的方法中,训练样本的优化问题是最基本问题[10],强化了样本之间的可辨别性。Zhang等[11]经过分析SRC模型中的协作表示(Collaborative Representation, CR)特性后,并证实了在SRC模型中,协作表示机制在分类中起到了关键性作用。而训练样本的优化也是必不可少的,在样本优化过程中,首先应该使得稀疏表示的测试样本的误差最小,其次还要使得真正的类别的稀疏系数达到最大,因此研究人员引进了贪婪搜索策略来弱化稀疏性约束条件。

Bo等[12]提出的匹配追踪(Matching Pursuit, MP)和Wang等[13]提出的正交匹配追踪(Orthogonal Matching Pursuit, OMP)是贪婪搜索算法的两种方法。MP算法通过迭代的方式每次在训练样本中得到一个与测试样本最匹配的训练样本,然后计算残差,计算完成之后,再继续寻找下一个最匹配的训练样本,直到符合最初设置的允许最小误差值,跳出迭代循环。OMP算法是对MP算法的改进,OMP在分解的每一步都会对所要选择的全部训练样本进行正交化处理。贪婪搜索算法的特点是通过迭代无限逼近测试样本,通过先求局部最优解, 逐步地搜索到全局最优解,但是这种方法在人脸识别过程中取得的效果不是很理想。

因此,在实际的人脸识别过程中,系数分解时的稀疏约束条件是必要的。研究人员提出了一种新的变量选择技术最小绝对压缩方法,即 LASSO(Least Absolute Shrinkage and Selection Operator)[14]。LASSO估计是用于描述约束问题的一种压缩估计,它通过构造一个惩罚函数来得到一个简单精炼的模型,使得有些变量的系数等于或者趋近于零,因此具有变量选择的作用。LASSO估计可以进行连续的选择变量和模型参数估计。研究人员对LASSO进行了改进并提出了最小角回归(Least Angle RegreSsion, LARS)算法[15]。这种方法的提出使得 LASSO算法的计算更加简单,使得 LASSO算法在特征选择和参数估计方面得到了更广泛的应用。然而LASSO估计有自己的不足之处,对于高维小样本数据,会使得出来的模型过于稀疏,使得系数分解时得到的误差较大;而且LASSO估计对于向量间具有强相关性的数据,得到的结果也不是很理想。

鉴于上述算法的不足之处,本文提出了基于弹性网络(Elastic Network)的SRC模型,Zou等[16]提出了一种新的特征选择的算法叫作 Elastic Net。这种方法在自变量数目远远大于样本容量时,能够有效地进行向量选择,使得模型不至于过度稀疏,而且该算法能够有效地处理强相关性变量的数据,即有较好的自变量分组效应。

相对其他算法,弹性网络在模型变量选择方面表现会更加地好,在ORL、FERET和AR三个数据集的仿真实验结果进一步证明了,人脸识别率有了很大的提高。

1 稀疏表示假设存在L类共计n个训练样本,训练样本记作n个列向量x1, x2, …, xn,假定测试样本y可以近似地表示为训练样本的线性组合,即:

| $\mathit{\boldsymbol{y}} = \sum\limits_{i = 1}^n {{\alpha _i}{\mathit{\boldsymbol{x}}_i}} $ | (1) |

从式(1) 中可以得出,每一类的训练样本都可以线性地表示测试样本,而且第i个训练样本对于表示测试样本y的拟合度可记为αixi,因此所有来自第k类的训练样本的集合为xs, xs+1…, xt,则第k类训练样本的拟合总和为gk=αsxs+αs+1xs+1…+αtxt。若偏离度ek=‖y-gk‖2越小,则第k类训练样本与测试样本的拟合度越大,进而将测试样本y归为使ek最小的那一类。

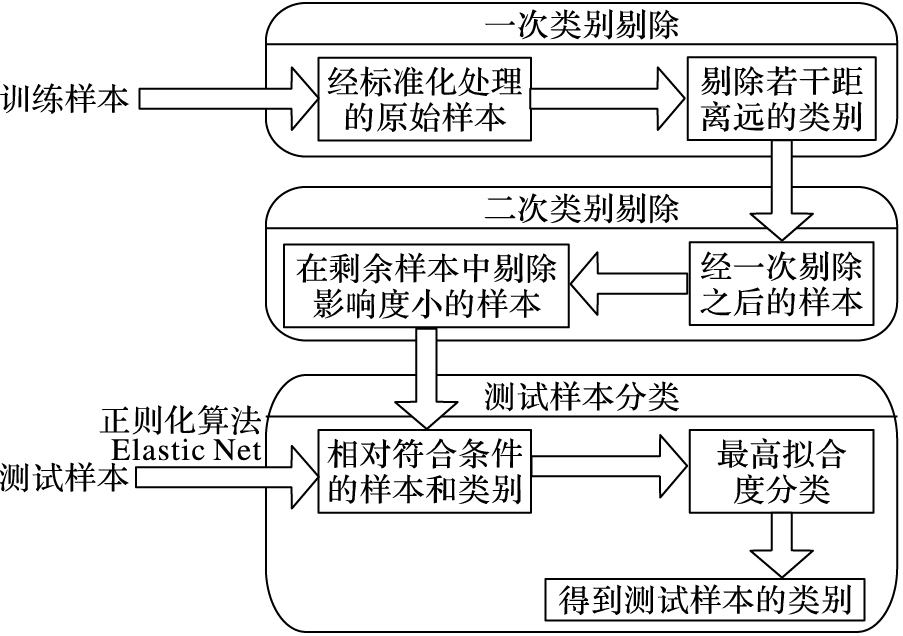

2 SRC模型与算法描述 2.1 SRC模型算法的基本思路[17]是将测试样本表示为训练样本的线性组合。其大体上分为两步:第一步就是比较样本之间的欧氏距离,剔除若干对分类影响较小或起到负作用的类别或样本,然后在剩余的类别或样本中进行最后的分类决策。第二步根据弹性网络估计得到稀疏系数,并计算误差将测试样本归为误差最小的某一类。算法描述如图 1。

|

图 1 算法框架示意图 Figure 1 Schematic diagram of algorithm framework |

假定来自L类共计n个训练样本X=(X1, X2,…, Xn), 其中Xi=(X1i, X2i…, Xpi)T, 其中t>0表示训练样本数目i=1, 2, …, n,测试样本y=(y1, y2, …, yp)T。这些样本变量需要经过标准化,单位化,

LASSO估计是一种处理共线性数据的有偏估计。LASSO估计定义如下:

| $\begin{array}{l} L({\lambda _1},{\lambda _2},\mathit{\boldsymbol{\beta }}) = {\left\| {\mathit{\boldsymbol{y}} - \mathit{\boldsymbol{X\beta }}} \right\|^2}\\ {\rm{s}}.{\rm{t}}.{\left\| \mathit{\boldsymbol{\beta }} \right\|_1} = \sum\limits_{j = 1}^p {\left| {{\beta _j}} \right|} \le t \end{array}$ | (2) |

此时t成为调整参数且满足t>0, LASSO是对分解系数的绝对值进行惩罚求值,因此LASSO估计的惩罚也叫L1惩罚,其约束条件就是一些变量的分解系数的绝对值之和小于一个常数t,这样使得一些变量的系数压缩为零,从而起到压缩变量的作用。

对于高维小样本数据(p>>n),LASSO估计最多可能选择n个变量,这样会得到过于稀疏的模型,结果对人脸的分类决策造成非常大的负面影响,进而影响分类效果。因为LASSO估计不具有组效应性质,所以该算法在处理向量间具有强相关性的数据集时,其准确率和效果很差。LASSO估计对于每个分解系数不作区别进行相同程度的压缩,这样的后果会使某些系数过度压缩,更加影响分类准确率。

弹性网络能够有效地弥补上述算法的不足,很大程度上提高了算法识别率。研究人员提出了一种高维变量选择的算法叫作弹性网络(Elastic Network),相比贪婪搜索策略和LASSO的稀疏分解方法,本文提出的稀疏分解方法增加了Elastic Net惩罚项,惩罚项的作用主要是保证最小二乘解的鲁棒性和强化解向量的稀疏性,使得模型更加简单精炼,准确率也有很大的提高。弹性网络还可以有效地处理高维小样本数据,不会使模型过于稀疏影响分类精度。Elastic Net有组效应性质,它将强相关性变量组全部剔除或者保留, 能够保证每次得到的解是最优的,因此将Elastic Net算法应用在模型中的第二步对每类图像中的样本进行变量选择。

对于固定的非负值λ1和λ2,弹性网络准则定义如下:

| $L({\lambda _1},{\lambda _2},\mathit{\boldsymbol{\beta }}) = {\left\| {\mathit{\boldsymbol{y}} - \mathit{\boldsymbol{X\beta }}} \right\|^2} + {\lambda _2}{\left| \mathit{\boldsymbol{\beta }} \right|^2} + {\lambda _1}{\left| \mathit{\boldsymbol{\beta }} \right|_1}$ | (3) |

其中,

| $\begin{array}{l} \mathit{\boldsymbol{\hat \beta }} = \arg \mathop {\min }\limits_\beta {\left\| {\mathit{\boldsymbol{y}} - \mathit{\boldsymbol{X\beta }}} \right\|^2}\\ {\rm{s}}.{\rm{t}}\left( {1 - \alpha } \right){\left| \mathit{\boldsymbol{\beta }} \right|_1} + \alpha {\left| \mathit{\boldsymbol{\beta }} \right|^2} \le t \end{array}$ | (4) |

其中:t是一个非负数,则函数(1-α)β1+α|β|2是弹性网络惩罚。上式中的参数t和α可以采用交叉验证方法来获得最优值。

算法流程如下:

1) 假定有L个人脸n张图片,先将样本的图片转换成一维列向量,每一个列向量代表一张人脸图片,则n个列向量构成一个矩阵。

2) 将矩阵中的所有的列向量标准化,并随机分成训练样本和测试样本矩阵。

3) 首先根据训练样本和测试样本的欧氏距离,剔除距离最大的若干类和样本,完成训练样本的第一次更新。

4) 在剩余的训练样本中使用弹性网络完成稀疏系数的分解,完成训练样本的第二次更新,此次更新需要满足终止条件(误差需要小于某一个值)。

5) 停止更新,根据得到的稀疏解的计算结果和测试样本进行比较,那么测试样本归为误差最小的那一类。

2.3 算法时间复杂度假设n个人脸图像为训练样本,经过m次迭代以后剩余的样本个数为n-m个,每个样本是p×1的向量。而总的样本个数为D,则算法对数据进行处理一次的时间复杂度为O(m3)+O(pm2),每次剔除贡献度小的样本的时间复杂度为O(n),所以整个动态类别剔除机制的总的时间复杂度为O(nm3)+O(npm2)+O(n2),而剩余的n-m个样本的分解过程,其时间复杂度为O(m lb p)。总的时间复杂度为O(nm3)+O(npm2)+O(n2)。

3 实验为了与上述方法进行比较,本文采用了ORL、FERET和AR三个人脸数据库进行了大量实验,这三个数据库中的照片是在特定的外部条件下采集。

|

图 2 人脸数据库中的部分标准图像 Figure 2 Part of standard image in face database |

ORL数据库共计400幅图像,分别来自40个类别,每个类别提供10幅样本图像。

FERET人脸数据库是人脸识别的一个标准数据库,本文只使用了数据库的一部分图像。共计1 400幅图像,分别来自200个类别,每个类别提供7幅样本图像。

AR人脸数据库中共计使用了3 120幅图像,分别来自120个类别,每个类别提供26幅样本图像。

首先将来自ORL数据库中的人脸图像降采样为46×56的尺寸大小,同样的FERET和AR人脸数据库图像分别降采样为40×40和40×50的尺寸大小。

特别指出的是所提出的人脸识别方法能够比较鲁棒地解决遮挡问题,因此本文分别对ORL、FERET和AR数据库进行了面部有遮挡的实验。三个数据集的实验参数如表 1所示。本文算法是采用Matlab程序来实现的。

| 表 1 3个人脸测试数据集的实验参数 Table 1 3 Face test data sets |

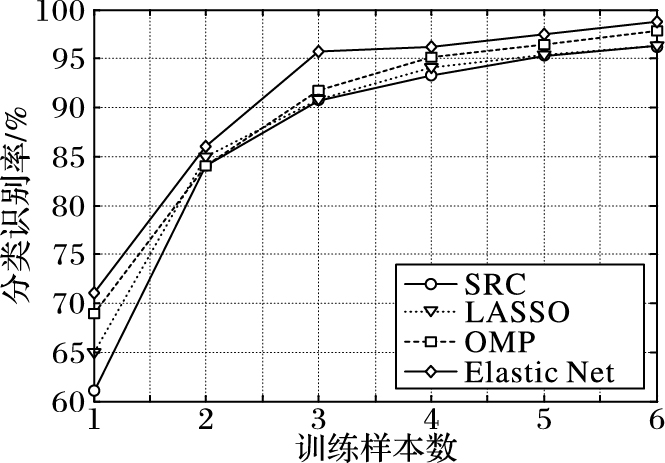

图 3所示,表示对ORL数据库不同的稀疏分解方法在不同的训练样本的情况下的分类识别率的变化。图中显示的是SRC、LASSO、OMP、Elastic Net 算法作稀疏分解时分类算法的最终识别率。从图中可以看出本文提出算法的有效性。

|

图 3 ORL库下不同的稀疏分解方法在不同的训练样本下的识别率 Figure 3 Recognition rates of different sparse decomposition methods under different training samples in ORL dataset |

表 2列出了在ORL数据库上,SRC、CRC(Collaborative Representation based Classification)、SRC-LARS、SRC-GS和本文提出的SRC-EN方法的分类准确率和部分识别率较高的算法运行时间。SRC-LARS为基于LARS的稀疏表示的人脸识别方法,SRC-GS(Greedy Search)为基于贪婪搜索的稀疏表示的人脸识别方法。SRC-EN是本文提出的基于Elastic Net的算法。

| 表 2 ORL上不同训练样本和方法下分类识别率和时间的比较 Table 2 Classification recognition rate and time of each method varies with number of traning samples in ORL dataset |

表 3列出了在FERET和AR数据库上,SRC、CRC、SRC-LARS、SRC-GS和本文提出的SRC-EN方法的分类准确率和运行时间。

| 表 3 FERET和AR上不同方法的识别率和时间比较 Table 3 Comparison of recognition rate and time complexity of different algorithms on FERET and AR database |

传统的SRC方法中,将测试样本用训练样本来线性表示,在理想状态下,只有与测试样本同类别的训练样本的系数较大,其余类别的训练样本的系数为零,但是在实际情况下,由于外部条件的影响下,如噪声、光照变化、遮挡等影响,使得分解系数不是稀疏的。因此在SRC模型中,本文引进了弹性网络约束来求解稀疏表示系数,使得测试样本的重构误差减小,并且突出了真正的类别;而且该算法能够有效地处理高维小样本和具有强相关性变量的人脸数据集,具有很高的适应性,但是由于算法比较复杂,因此算法时间复杂度相比传统的算法稍微大一些。

4 结语人脸识别算法一般是建立在子空间的特征提取的基础之上的,但是在人脸识别算法的应用过程中,子空间的提取的稳定性会受到表情、光照和姿势等的影响,影响了人脸识别的效果。本文提出了一种基于稀疏表示和弹性网络的人脸分类方法。这种方法将测试样本表示成训练样本线性组合的方式,并且通过迭代方式来剔除对分类产生负作用的若干个样本,同时能够使得对分类起到决定作用的类别的稀疏系数变大。在系数分解过程中稀疏性约束是必要的,因此不能简单地被弱化,本文采用弹性网络增加了Elastic Net 惩罚项。一方面保证了最小二乘解的鲁棒性,另一方面强化了解向量的稀疏性。对于人脸数据集来说,样本向量之间具有强相关性。相对于传统的贪婪搜索策略,Elastic Net具有组效应性质,保证每一步能够得到最优解,而且还能够有效地处理高维小样本数据,使得模型不会过于稀疏。仿真实验表明人脸分类识别率有明显的提高,适应性很高,具有较高的研究价值。相比于传统的变量选择方法该算法比较复杂,运行比较耗时,因此在保证准确率的前提下,注重效率是以后要研究的内容。

| [1] | HARANDI M T, AHMADABADI M N, ARAABI B N. Optimal local basis:a reinforcement learning approach for face recognition[J]. International Journal of Computer Vision, 2009, 81 (2) : 191-204. doi: 10.1007/s11263-008-0161-5 |

| [2] | SUGIYAMA M. Dimensionality reduction of multimodal labeled data by local Fisher discriminant analysis[J]. Journal of Machine Learning Research, 2007, 8 : 1027-1061. |

| [3] | LIU Z Y, CHIU K C, XU L. Improved system for object detection and star/galaxy classification via local subspace analysis[J]. Neural Networks, 2003, 16 (3/4) : 437-451. |

| [4] | 孙玉宝.图像稀疏表示模型及其在图像处理反问题中的应用[D].南京:南京理工大学,2010:1-10. ( SUN Y B. Image sparse representation theory and its application to image processing inverse problems[D]. Nanjing:Nanjing University of Science and Technology, 2010:1-10. ) |

| [5] | WRIGHT J, MA Y, MAIRAL J, et al. Sparse representation for computer vision and pattern recognition[J]. Proceedings of the IEEE, 2010, 98 (6) : 1031-1044. doi: 10.1109/JPROC.2010.2044470 |

| [6] | WRIGHT J, YANG A Y, GANESH A, et al. Robust face recognition via sparse representation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2009, 31 (2) : 210-227. doi: 10.1109/TPAMI.2008.79 |

| [7] | YANG M, ZHANG L, YANG J, et al. Robust sparse coding for face recognition[C]//Proceedings of the 2011 IEEE Conference on Computer Vision and Pattern Recognition. Washington, DC:IEEE Computer Society, 2011:625-632. |

| [8] | XU Y, FANG X, LI X, et al. Data uncertainty in face recognition[J]. IEEE Transactions on Cybernetics, 2014, 44 (10) : 1950-1961. doi: 10.1109/TCYB.2014.2300175 |

| [9] | XU Y, ZHU X, LI Z, et al. Using the original and ‘symmetrical face’ training samples to perform representation based two-step face recognition[J]. Pattern Recognition, 2013, 46 (4) : 1151-1158. doi: 10.1016/j.patcog.2012.11.003 |

| [10] | 朱杰, 杨万扣, 唐振民. 基于字典学习的核稀疏表示人脸识别方法[J]. 模式识别与人工智能, 2012, 25 (5) : 859-864. ( ZHU J, YANG W K, TANG Z M. A dictionary learning based kernel spam representation method for face recognition[J]. Pattern Recognition and Artificial Intelligence, 2012, 25 (5) : 859-864. ) |

| [11] | ZHANG L, YANG M, FENG X. Sparse representation or collaborative representation:Which helps face recognition?[C]//Proceedings of the 2011 International Conference on Computer Vision. Washington, DC:IEEE Computer Society, 2011:471-478. |

| [12] | BO L, REN X, FOX D. Hierarchical matching pursuit for image classification:architecture and fast algorithms[EB/OL].[2016-02-03]. http://papers.nips.cc/paper/4473-hierarchical-matching-pursuit-for-image-classification-architecture-and-fast-algorithms.pdf. |

| [13] | WANG J, KWON S, SHIM B. Generalized orthogonal matching pursuit[J]. IEEE Transactions on Signal Processing, 2012, 60 (12) : 6202-6216. doi: 10.1109/TSP.2012.2218810 |

| [14] | DAGHIR WOJTKOWIAK E, WICZLING P, BOCIAN S, et al. Least absolute shrinkage and selection operator and dimensionality reduction techniques in quantitative structure retention relationship modeling of retention in hydrophilic interaction liquid chromatography[J]. Journal of Chromatography A, 2015, 1403 : 54-62. doi: 10.1016/j.chroma.2015.05.025 |

| [15] | SHAHRIARI S, FARIA S, GONCALVES A M, et al. Outlier detection and robust variable selection for least angle regression[M]//Computational Science and Its Applications-ICCSA 2014, LNCS 8581. Berlin:Springer, 2014:512-522. |

| [16] | ZOU H, HASTIE T. Regularization and variable selection via the elastic net[J]. Journal of the Royal Statistical Society, 2005, 67 (2) : 301-320. doi: 10.1111/rssb.2005.67.issue-2 |

| [17] | MARONNA R A. Robust ridge regression for high-dimensional data[J]. Technometrics, 2011, 53 (1) : 44-53. doi: 10.1198/TECH.2010.09114 |

| [18] | 刘梓, 宋晓宁, 唐振民. 稀疏表示和贪婪搜索的人脸分类[J]. 中国图象图形学报, 2015, 20 (1) : 39-49. ( LIU Z, SONG X N, TANG Z M. Sparse representation based face recognition classification algorithm using greedy search strategy[J]. Journal of Image and Graphics, 2015, 20 (1) : 39-49. ) |

| [19] | VURAL V, FUNG G, KRISHNAPURAM B, et al. Using local dependencies within batches to improve large margin classifiers[J]. Jourhal of Machine Learning Research, 2009, 10 : 183-206. |