目前,车载广泛应用于各种车辆上,安装车载可以用于各种突发状况的取证,但是由于大众化的车载为了保证图像显示的实时性同时减少存储所占空间,导致车载图像分辨率较低,当需要确认图像的局部信息放大图像观察时往往得不到满意的结果。为了在分析取证时获得足够的图像细节,图像超分辨率图像重建成为了学者们研究的热点问题。

基于学习的单幅图像超分辨率重建方法主要分为两类:外部图像训练的图像重建[1-3]和内部图像自相似性重建[4-5]。文献[2]的ScSR(Sparse coding Super-Resolution)算法需要构建稀疏表示的字典,然而由外部训练进行图像重建训练字典所需的自然图像数量以及与原图像的相关性未知,仅凭经验来选取,同时大量的外部图像训练会增加算法的复杂度,降低算法的执行效率,因此本文采用单幅图像自身结构的相似性进行图像的重建。图像结构自相似性的超分辨率重建方法以图像的结构自相似性为附加信息[6-8]对于城市街景图像这种重复结构多的人工场景具有更好的重建效果。

近年来陆续出现了利用相同尺度相似图像块的超分辨率(Super-Resolution, SR)方法[6-7],该方法虽然为图像重建提供了互补信息,但是由于相同图像自身的相似图像块有限,制约了图像重建的效果。文献[4]的Upscaling算法采用逐级放大、分多步组合的方法实现不同尺度相似图像块的重建,该方法通过不同的放大因子得到不同尺度的图像并通过局部邻域搜索获得匹配图像块,一定程度上增加了图像自相似性的附加信息,对重建图像的质量有一定的改善。文献[9-10]在图像重建的过程中同时加入了相同尺度和不同尺度的自相似性图像块信息,一定程度上提高了重建效果,但在整幅图像搜索相似图像块导致其运算复杂度较高。为了进一步提高SR重建效果,在外部图像训练方面,深度学习的方法被广泛应用,文献[3]的SCN(Sparse Coding based Network)算法采用基于稀疏先验的深度学习算法获得训练字典,达到了较好的重建效果;在自相似性重建方面,一些学者通过增加相似图像块的搜索空间来获得高分辨图像,在不同尺度图像的基础上通过图像的仿射变换(缩放、旋转、剪切)[11-13]增加额外的相似图像块的搜索空间获得重建图像质量的提升,然而这些算法利用给定图像的不同尺度的相似信息,并不能充分地重建图像表面变化的纹理细节。

因此,本文通过在多尺度图像的仿射变换的基础上增加透视变换扩展内部图像块的搜索过程,采用组合模型来处理这两种变换。通过定位平面、检测图像的透视几何特征引导图像块的搜索过程,同时在图像重建的过程中进行高频补偿弥补图像金字塔中损失的高频细节。最后以迭代反投影进一步验证图像的重建效果。

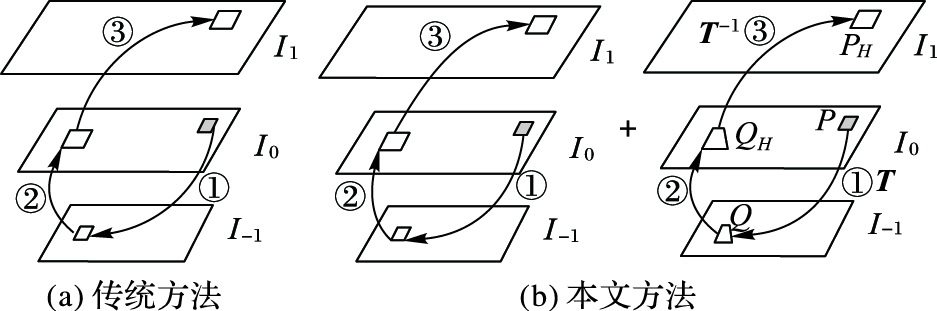

1 算法的总体概述传统的基于自相似性的单幅图像超分辨率重建的框架如图 1(a)所示。对于每一个给定的低分辨率图像I0中的图像块在下采样的图像I-1中能找到相应的匹配图像块,这个相应的图像块在低分辨率图像I0的相应位置对应的图像块作为高分辨率图像的预测,即这个相应的图像块将被粘贴于高分辨率图像I1中。本文在传统自相似算法的基础上通过增加图像块搜索时的仿射变换与透视变换,扩大图像块的搜索空间,提高图像块匹配的精度,重建更加清晰的图像。

|

图 1 单幅图像超分辨率重建框架 Figure 1 Super-resolution reconstruction of a single image |

给定低分辨率的城市街景图像I0,通过模糊下采样获得I-1,由I0和I-1可以重建高分辨率图像I

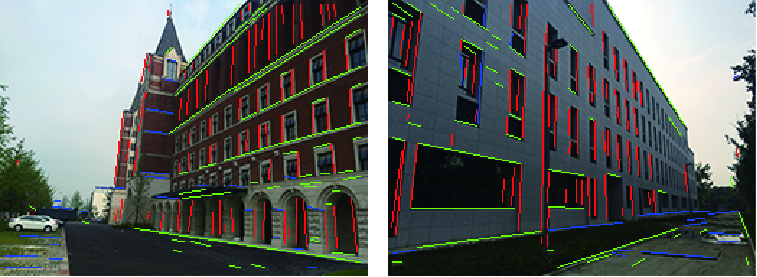

为了获得透视变换矩阵,首先需要对待处理的低分辨率城市街景图像内部的三维结构进行检测定位。Chum等[15]、Zhang等[16]将平面的透视变换转变为平行平面进行平面的识别和校正,而本文使用直线段提取、消失点估计[17]以及基于消失点分组的方法进行平面的识别与校正。首先检测图像的边缘与直线,然后用基于随机抽样一致(RANdom SAmple Consensus, RANSAC)投票的方法确定3个消失点,结果如图 2所示。

|

图 2 定位平面 Figure 2 Location plane |

由检测到的三个消失点可以确定与三个消失点相对应的平面,平面m的参数由消失线l∞m来表示,l∞m=[l1m, l2m, l3m]T是有两个自由度的齐次向量,式(1) 为校正透视图像的透视矩阵。

| ${{\mathit{\boldsymbol{H}}}_{m}}=\left[ \begin{matrix} 1 & 0 & 0 \\ 0 & 1 & 0 \\ l_{1}^{m} & l_{2}^{m} & l_{3}^{m} \\ \end{matrix} \right]$ | (1) |

在三维空间里两组平行线确定一个平面,确定消失点以及对应的线段分组后,通过与两个消失点相对应的线段来确定平面的支持。由高斯核扩散对应的线段估计每个消失点的空间支持,平面的空间支持由该平面对应的消失点支持线密度图的点乘计算。通常情况下,平行平面的参数为l∞0=[0,0,1]T, 对密度图进行归一化处理使每个平面的概率和为1。

2.2 平面参数的计算对待处理的低分辨率城市街景图像进行平面的检测定位后,需要通过计算获得图像内部的三维平面参数。以Ω表示输入低分辨率的城市街景图像I0像素索引值的集合,对于每一个中心位置为ti=(tix, tiy)T的目标图像块P(ti),目的是要估计变换矩阵Ti,通过这个变换矩阵Ti将目标图像块P(ti)映射到I0的下采样图像ID的最近邻域中去,其中Q(ti, θi)表示使用参数为θi的变换矩阵Ti对图像ID采样的源图像块,其中θi为输入的图像I0中第i个像素的变换域参数。通常情况下,图像块的几何变换有八个自由度,估计图像块的一种方法为在变换以外的图像块空间进行图像块搜索,但是透视变换只能用缩放、旋转、剪切变换来近似,因此仅仅用仿射变换对人为的结构化的场景进行重建不能恢复足够的图像表面的纹理细节。本文在传统方法的基础上结合图像块搜索方法[11-12]和透视变换的方法[18]进行相似图像块的搜索与匹配。

使用消失点检测方法检测并定位平面,计算平面参数。如图 2所示,定位了3个平面,mi表示不同平面的索引,变换矩阵Ti的参数为θi=(si, mi),其中si=(six, siy, sis, siθ, isα, siβ)为六维的仿射运动参数。定义变换矩阵为:

| ${{\mathit{\boldsymbol{T}}}_{i}}({{\theta }_{i}})=\mathit{\boldsymbol{H}}({{\mathit{\boldsymbol{t}}}_{i}},s_{i}^{x},s_{i}^{y},{{m}_{i}})\mathit{\boldsymbol{S}}(s_{i}^{s},s_{i}^{y})\mathit{\boldsymbol{A}}(s_{i}^{\alpha },s_{i}^{\beta })$ | (2) |

其中:H表示获得的目标图像块与源图像块位置的透视变换以及平面参数。

| $\mathit{\boldsymbol{S}}(s_{i}^{s},s_{i}^{\theta })=\left[ \begin{matrix} s_{i}^{s}\mathit{\boldsymbol{R}}(s_{i}^{\theta }) & 0 \\ {{0}^{\rm{T}}} & 1 \\ \end{matrix} \right]$ | (3) |

| $\mathit{\boldsymbol{A}}(s_{i}^{\alpha },s_{i}^{\beta })=\left[ \begin{matrix} 1 & s_{i}^{\alpha } & 0 \\ s_{i}^{\beta } & 1 & 0 \\ 0 & 0 & 1 \\ \end{matrix} \right]$ | (4) |

矩阵S表示由缩放参数sis和旋转矩阵R(siθ)得到的相似性变换矩阵,矩阵A表示仿射变换中的剪切映射。组合变换模型Ti(θi)用来采样得到源图像块,由仿射形变参数(sis, siθ, siα, siβ)得到对应于目标图像块ti的源图像块位置(six, siy)同时用来估计透视变换矩阵H(ti, six, siy, mi),由仿射形变参数(sis, siθ, siα, siβ)得到矩阵S、A。

3 最近邻域估计通过计算平面参数可以获得透视变换矩阵,本文的算法在仿射变换的基础上增加了透视变换进行图像块的最近邻域搜索,形成最近邻域估计,进行最近邻域估计是为了得到变换矩阵Ti(θi)的最优解。相比传统的二维变化域,本文增加透视变换使图像块的搜索扩展到了三维空间,并对图像的每一个平面空间进行最近邻域估计,定义每个平面空间的最近邻域估计的目标函数为:

| $\underset{\left\{ {{\theta }_{i}} \right\}}{\mathop{\min }}\,\sum\limits_{i\in \Omega }{{{\mathit{\boldsymbol{E}}}_{app}}({{\mathit{\boldsymbol{t}}}_{i}},{{\theta }_{i}})}+{{\mathit{\boldsymbol{E}}}_{plane}}({{\mathit{\boldsymbol{t}}}_{i}},{{\theta }_{i}})+{{\mathit{\boldsymbol{E}}}_{scale}}{{(}_{i}},{{\theta }_{i}})$ | (5) |

其中:θi为构建变换矩阵Ti(θi)的未知参数。由式(5) 可知,目标函数包含三部分:表面纹理代价函数、平面代价函数、缩放代价函数。相比于文献[18]本文将透视变换应用于图像三维平面的图像块搜索与匹配,并在图像金字塔中进行尺度约束与选择,以便得到最优的变换矩阵,重建更加清晰的图像。

3.1 表面纹理代价函数表面纹理代价函数表示了采样的目标图像块与源图像块的相似性,使用RGB空间的高斯加权平方距离来度量。

| ${{\mathit{\boldsymbol{E}}}_{app}}({{\mathit{\boldsymbol{t}}}_{i}},{{\theta }_{i}})=\left\| {{W}_{i}}(P({{\mathit{\boldsymbol{t}}}_{i}})-Q({{\mathit{\boldsymbol{t}}}_{i}},{{\theta }_{i}})) \right\|_{2}^{2}$ | (6) |

其中:Wi是方差为3的高斯权值矩阵。

3.2 平面兼容的代价函数对于低分辨率的城市街景图像这种人为的场景使用消失点检测算法可以有效地定位平面。通过定位得到的3维平面可以用于引导图像块的搜索空间。

| ${{\mathit{\boldsymbol{E}}}_{plane}}=-{{\lambda }_{plane}}\log (\Pr [{{m}_{i}}|(s_{i}^{x},s_{i}^{y})]\times \Pr [{{m}_{i}}|(t_{i}^{x},t_{i}^{y})])$ | (7) |

其中:Pr[mi|(x, y)]为像素位置(x, y)的平面mi的后验概率。

3.3 缩放的代价函数因为允许连续的几何变换,最近邻域估计在目标图像块与该目标图像块对应的源图像块匹配时经常收敛到零解。为了避免零解引入缩放的代价函数:

| ${{\mathit{\boldsymbol{E}}}_{scale}}={{\lambda }_{scale}}\min (0,SRF-Scale({{\mathit{\boldsymbol{T}}}_{i}}))$ | (8) |

其中:SRF表示超分辨率重建因子,如2×、3×、4×等,Scale(·)表示投影变换矩阵的尺度估计。使用Ti的一阶泰勒展式近似的估计源图像块采样的缩放尺度。

| $Scale({{\mathit{\boldsymbol{T}}}_{i}})=\sqrt{\det \left[ \begin{matrix} {{\mathit{\boldsymbol{T}}}_{1,1}}-{{\mathit{\boldsymbol{T}}}_{1,3}}{{\mathit{\boldsymbol{T}}}_{3,1}} & {{\mathit{\boldsymbol{T}}}_{1,2}}-{{\mathit{\boldsymbol{T}}}_{1,3}}{{\mathit{\boldsymbol{T}}}_{3,2}} \\ {{\mathit{\boldsymbol{T}}}_{2,1}}-{{\mathit{\boldsymbol{T}}}_{2,3}}{{\mathit{\boldsymbol{T}}}_{3,1}} & {{\mathit{\boldsymbol{T}}}_{3,1}}-{{\mathit{\boldsymbol{T}}}_{2,3}}{{\mathit{\boldsymbol{T}}}_{3,2}} \\ \end{matrix} \right]}$ | (9) |

其中:Tu, v表示变换矩阵Ti第u行、第v列的值,通过T3, 3对变换矩阵Ti归一化处理。

通过最小化最近邻域的代价函数求得参数θi的值,进而求得变换矩阵Ti(θi),由图像块匹配得到最匹配的图像块。

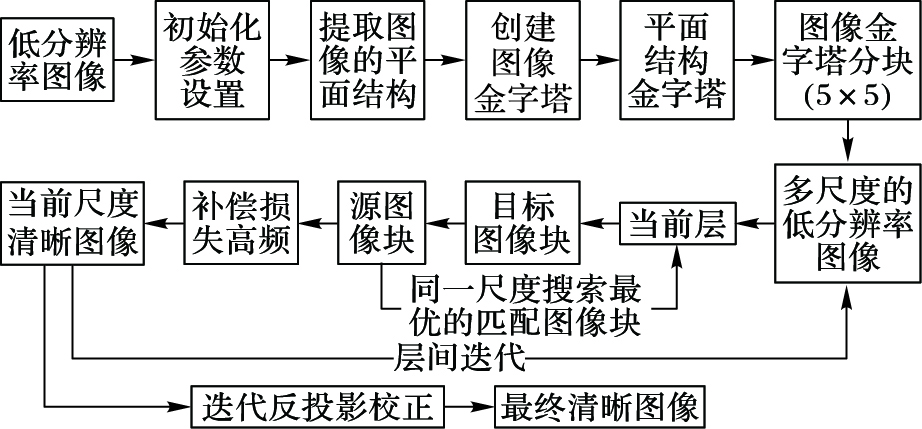

4 图像块的高频补偿本文在最近邻域估计中增加了三维空间透视变换的最近邻域搜索,由最近邻域估计的目标函数可以得到变换矩阵Ti(θi)。通过对I0搜索得到变换(透视变换、仿射变换)后的匹配图像块,以变换矩阵对该图像块进行相应的逆变换,得到相应的初步重建的图像块,并对该图像块进行相应的高频补偿粘贴于I1中与I-1中源图像块的相应位置。对所有的源图像块重复此操作可以得到最终的重建图像。本文中对于图像块的高频补偿采用由粗到细的方式进行低分辨率的城市街景图像的自相似性重建。首先由成比例的尺度因子分别建立高频图像与低频图像金字塔。对输入图像利用不同的尺度因子进行下采样获得高频带的图像金字塔,再对高频带的图像金字塔的每层分别进行上采样获得低频带的图像金字塔。本文所要获得的目标图像是分辨率提高了的图像,每次迭代分别以分辨率最高的图像为基础进行上采样,获得不同放大尺度、不同分辨率的目标图像。以低频带的图像金字塔为依据,通过源图像块缩放比例的估计,选择相对于输入图像相同缩放比例的低频图像金字塔的对应层作为源图像。采用最近邻域估计的方法对目标图像块和源图像块进行最近邻域搜索,得到最匹配的图像块并记录该图像块的位置。分别以D、U表示对图像的下采样以及上采样,则I1=U(D(I0)), I1是I0的平滑形式, I-1=D(I0)。目标图像L0=U(I-1),源图像为I1形成的图像金字塔。定义p表示上采样图像I=U(I0)中的图像块,其在I1中最相似的图像块表示为q(p)。由最近邻域估计得到的匹配图像块对当前层初步重建的图像I′进行高频补偿,H0(q)=I0(q)-L0(q),I(p)=I′(p)+H0(q(p)),最终得到清晰的重建城市街景图像。其算法的总体框图如图 3所示。

|

图 3 算法的总体框图 Figure 3 General block diagram of the algorithm |

本文利用透视变换和高频补偿对图像进行自相似性重建,通过Matlab R2014a处理平台对该算法进行了仿真。

本文的算法通过与理想的超分辨率重建因子在相同的尺度以及零位移的情况下初始化最近邻域,这样的初始化使算法的收敛速度更快。为了保证仿射形变对于源图像块位置的不变性,通过θi=(si, mi)进行参数扩展,而不直接对变换矩阵Ti进行操作。在每一次迭代扩展之后,通过随机搜索优化当前的解,同时以后验概率分布绘制平面索引的随机采样,由金字塔模型通过由粗到细的方式搜索对于源图像块最优的几何变换减少匹配误差。

通过对图像进行5×5的分块处理,实现多尺度的超分辨率重建。超分辨率的重建因子分别为2×、3×、4×,分别在第3、5、6次上采样步骤中实现。再对每一层不同分辨率图像重建之后进行20次的迭代反投影[14],设置其高斯滤波器的掩膜为5×5,σ=1.2。在金字塔模型中对于粗层(尺度较小的层)的最近邻域估计上采样作为下一层的初始化。通过反复实验,选择参数λplane=10-3、λscale=10-3。将本文的算法与当前较好的超分辨率重建算法进行对比实验,验证本文算法对于低分辨率的城市街景图像的重建效果。选取6张车载中的低分辨率的城市街景图像进行实验对比与验证,分辨率均为192×256像素,在不同放大因子中分别选取两幅不同场景的车载图像验证算法的重建效果,为了更直观地观察图像的细节信息,实验结果展示了每幅图像不同细节的特征区域(图像中白色方框所示)放大图。从图 4的放大图可见,本文算法对于低分辨率的城市街景图像在放大2、3、4倍时的重建效果最好,细节部分较其他算法更清晰。

|

图 4 不同方法重建效果对比 Figure 4 Reconstruction effect contrast of different methods |

由图 4可见,算法ScSR有一定的晕影效应,算法SCN也有些许晕影,其重建的图像质量从视觉效果上来看,相比车载中的低分辨率城市街景图像有较大的改善;算法Upscaling重建的图像锐化比较严重,仔细观察其放大的特征区域,图像的纹理细节锐化效果明显;本文算法对比度明显,几乎没有晕影效应和细节锐化,重建图像的纹理细腻,轮廓清晰。

5.2 图像质量盲评估通过本文算法的处理,从人的主观视觉上来看,重建效果更清晰,对比度更明显,但是由于人的视觉极限,也需要由客观的评价指标对重建图像的质量进行定量评价。由于车载捕获的图像无法获得其原始的高分辨率的参考图像,本文采用盲评估的方法[19-20](无参考图像的质量评价方法)比较不同算法的重建图像质量。表 1为图像信息熵(entropy)、图像对比度(contrast)以及算法复杂度(执行时间)评价结果,表 2为图像边缘强度(ESL)、盲图像质量评价指标(BIQI)的质量评价结果。

| 表 1 信息熵、对比度、算法复杂度(s)评价结果 Table 1 Evaluation results of information entropy, contrast and algorithm complexity (s) |

| 表 2 ESL、BIQI质量评价结果 Table 2 ESL and BIQI results |

图像的信息熵越大表明其携带的信息量越多,图像质量越好;图像对比度越大反映其灰度反差越大;图像的边缘强度越大反映重建的图像纹理更清晰;盲图像质量评价指标的值域为[0,100],该值越大表明重建的图像质量越好。由表 1、2的实验数据可见,从总体上来讲本文的算法优于其他算法。对于同一幅低分辨率城市街景图像(如图像1) ,在不同放大倍数的条件下(如×2) ,ScSR算法所得到的图像对比度最高,但信息熵最低,意味着在对比度增强的同时该算法获得的图像却丢失了部分信息,算法Upscaling、SCN重建的图像在这两个指标上表现较平均,没有过分偏重,本文的算法在这两项指标上较其他算法表现更好,表明其重建图像的信息量、图像质量得到了提升。而对于重建的不同低分辨率城市街景图像由于其本身纹理边缘不同其评价指标存在差异。对于同一幅低分辨率城市街景图像(如图像5) ,在不同放大倍数的条件下(如×4) ,本文算法得到的边缘强度更高,说明其边缘保持能力更强,同时由BIQI的比较也可见本文的算法重建的图像在视觉体验上较其他算法更有效。通过各图像在不同放大倍数时各评价指标的值可见,当重建的图像放大倍数越大时,需要搜索匹配更多的图像块,以获得更多的图像细节信息,而单幅图像自相似性重建时能够获得的图像自相似信息是有限的,因而放大倍数增大时,各评价指标值出现了一定程度的下降。由表 1算法复杂度(执行时间)来看,本文算法在增加了图像搜索空间的情况下较同类利用图像自相似重建(Upscaling)算法执行效率有所提高,而算法SCN采用稀疏先验进行图像重建,其数据量大幅降低因而执行效率最高。本文采用自相似性重建在没有外部图像训练字典的情况下,为保证不丢失更多的图像信息未采用稀疏表示的方法,执行效率不及SCN。综合各算法以及各评价指标的行列对比可见,本文的算法在图像分辨率提升和执行效率上较好。

6 结语为了在突发状况时利用车载图像进行分析取证能够获得更多的图像细节,本文针对车载捕获图像中的低分辨率城市街景图像进行图像超分辨率重建,利用仿射变换与透视变换增加图像自相似性匹配的搜索空间,同时结合金字塔模型提供的多尺度图像自相似性,由粗到精地对低分辨率图像进行重建,并对初步重建的图像进行高频补偿,丰富图像的细节信息。对低分辨率的城市街景图像进行超分辨率重建,得到的图像在主观视觉以及大部分定量评价指标上优于其他算法,几乎没有晕影效应,图像也没有过度锐化,图像的分辨率得到了一定的提升,但在算法的执行效率上有待进一步的提升。

| [1] | 莫建文, 曾儿孟, 张彤, 等. 基于多字典学习和图像块映射的超分辨率重建[J]. 计算机应用, 2016, 36 (5) : 1394-1398. ( MO J W, ZENG E M, ZHANG T, et al. Super-resolution reconstruction based on multi-dictionary learning and image patches mapping[J]. Journal of Computer Applications, 2016, 36 (5) : 1394-1398. ) |

| [2] | YANG J, WRIGHT J, HUANG T S, et al. Image super-resolution via sparse representation[J]. IEEE Transactions on Image Processing, 2010, 19 (11) : 2861-2873. doi: 10.1109/TIP.2010.2050625 |

| [3] | WANG Z, LIU D, YANG J, et al. Deep networks for image super-resolution with sparse prior[C]//Proceedings of the 2015 IEEE International Conference on Computer Vision. Washington, DC:IEEE Computer Society, 2015:370-378. |

| [4] | FREEDMAN G, FATTAL R. Image and video upscaling from local self-examples[J]. ACM Transactions on Graphics, 2011, 30 (2) : 474-484. |

| [5] | DONG W, ZHANG L, SHI G, et al. Nonlocal back-projection for adaptive image enlargement[C]//Proceedings of the 16th IEEE International Conference on Image Processing. Piscataway, NJ:IEEE, 2009:349-352. |

| [6] | PROTTER M, ELAD M, TAKEDA H, et al. Generalizing the nonlocal-means to super-resolution reconstruction[J]. IEEE Transactions on Image Processing, 2009, 18 (1) : 36-51. doi: 10.1109/TIP.2008.2008067 |

| [7] | MAIRAL J, BACH F, PONCE J, et al. Nonlocal sparse models for image restoration[C]//Proceedings of the 2009 IEEE 12th International Conference on Computer Vision. Piscataway, NJ:IEEE, 2009:2272-2279. |

| [8] | SUETAKE N, SAKANO M, UCHINO E. Image super-resolution based on local self-similarity[J]. Optical Review, 2008, 15 (1) : 26-30. doi: 10.1007/s10043-008-0005-0 |

| [9] | GLASNER D, BAGON S, IRANI M. Super-resolution from a single image[C]//Proceedings of the 2009 IEEE 12th International Conference on Computer Vision. Piscataway, NJ:IEEE, 2009:349-356. |

| [10] | 潘宗序, 禹晶, 胡少兴, 等. 基于多尺度结构自相似性的单幅图像超分辨率算法[J]. 自动化学报, 2014, 40 (4) : 594-603. ( PAN Z X, YU J, HU S X, et al. Single image super resolution based on multi-scale structural self-similarity[J]. Acta Automatica Sinica, 2014, 40 (4) : 594-603. ) |

| [11] | BARNES C, SHECHTMAN E, GOLDMAN D B, et al. The generalized patchmatch correspondence algorithm[C]//Computer Vision-ECCV 2010, LNCS 6313. Berlin:Springer, 2010:29-43. |

| [12] | HACOHEN Y, SHECHTMAN E, GOLDMAN D B, et al. Non-rigid dense correspondence with applications for image enhancement[J]. ACM Transactions on Graphics, 2011, 30 (4) : Article No. 70. |

| [13] | DARABI S, SHECHTMAN E, BARNES C, et al. Image melding:combining inconsistent images using patch-based synthesis[J]. ACM Transactions on Graphics, 2012, 31 (4) : Article No. 82. |

| [14] | IRANI M, PELEG S. Improving resolution by image registration[J]. CVGIP:Graphical Models and Image Processing, 1991, 53 (3) : 231-239. doi: 10.1016/1049-9652(91)90045-L |

| [15] | CHUM O, MATAS J. Planar affine rectification from change of scale[M]//Computer Vision-ACCV 2010, LNCS 6495. Berlin:Springer, 2011:347-360. |

| [16] | ZHANG Z, GANESH A, LIANG X, et al. TILT:transform invariant low-rank textures[J]. International Journal of Computer Vision, 2012, 99 (1) : 1-24. doi: 10.1007/s11263-012-0515-x |

| [17] | HARTLEY R, ZISSERMAN A. Multiple view geometry in computer vision[EB/OL].[2016-01-06]. http://www.newbooks-services.de/MediaFiles/Texts/3/9780521540513_Intro_001.pdf. |

| [18] | HUANG J B, KANG S B, AHUJA N, et al. Image completion using planar structure guidance[J]. ACM Transactions on Graphics, 2014, 33 (4) : Article No. 129. |

| [19] | 谭海鹏, 曾炫杰, 牛四杰, 等. 基于正则化约束的遥感图像多尺度去模糊[J]. 中国图象图形学报, 2015, 20 (3) : 386-394. ( TAN H P, ZENG X J, NIU S J, et al. Remote sensing image multi-scale deblurring based on regularization constraint[J]. Journal of Image and Graphics, 2015, 20 (3) : 386-394. ) |

| [20] | MOORTHY A K, BOVIK A C. A two-step framework for constructing blind image quality indices[J]. IEEE Signal Processing Letters, 2010, 17 (5) : 513-516. doi: 10.1109/LSP.2010.2043888 |