目前国内图像融合领域研究的方法较多,如基于神经网络[1]、基于多尺度分解[2]、基于统计[3]的融合算法等。其中神经网络具有较强的生物学背景,能够考虑到图像的全局特性。一种特殊类型的神经网络来自猫的视觉皮层,称为脉冲耦合神经网络(Pulse Coupled Neural Network, PCNN)[4]已经成功地被应用于图像融合,取得了不错的成果[5]。尽管如此,PCNN模型本身存在一些弊端,由于其复杂的结构与实际生物脑神经网络的运行机制类似,所以如何使大量参数、迭代次数得到准确的设置以及降低计算复杂度仍然是迫切需要解决的问题[6]。目前基于PCNN融合方法的改进主要包括两个方面:一种是改进PCNN模型自身,例如参数设置的改进。Qu等[7]在非下采样轮廓波变换(NonSubsampled Contourlet Transform, NSCT)域内采用空间频率激励PCNN模型来融合图像,但该算法需要对图像进行NSCT,提高了算法的计算复杂度。王佺等[8]采用粒子群算法优化PCNN中的参数,在很大程度上解决了参数设置问题,但粒子群算法的加入也增加了算法的复杂度。薛寺中等[9]将小波变换与PCNN相结合融合图像得到了更好的视觉效果,但迭代次数设置为200次,浪费了大量时间,而迭代次数过小又不能使PCNN得到充分的执行。另一种改进是在PCNN理论的基础上提出新模型,如相交皮质模型(Intersecting Cortical Model, ICM)[10]、脉冲发放皮层模型(Spiking Cortical Model, SCM)[11],这些模型也已经应用于图像融合中[12-14]。这两种模型均简化了PCNN,减少了参数的数目,但文献[10-11]都没有解决迭代次数的问题。

基于以上分析,为了降低传统算法的计算复杂度,减少待定参数的数目,解决网络迭代次数难确定的问题,本文提出了一种用连接突触计算网络(Linking Synaptic Computation Network, LSCN)[15]的连接项进行图像融合的算法。该算法具有更简洁的模型结构,相比传统算法减少了待定参数的数目,降低了计算复杂度,并通过多通工作方式解决了迭代次数难以确定的问题。通过三组计算机断层扫描(Computed Tomography, CT)与磁共振成像(Magnetic Resonance Imaging, MRI)图像进行实验,结果表明无论从是主观还是客观上本文算法均有更优良的图像融合效果。

1 LSCN基本结构Zhan等[15]于2017年1月提出了LSCN模型。在设计该模型时,受Ecknorn等[16]思想的启发,为了更恰当地描述生物电传输的指数衰减和视觉皮层受到一定刺激时相邻神经元同步发放脉冲等现象,用反馈输入作为外部激励,并且用内部活动项本身表示神经元状态的衰减项。

不同于前几代神经网络,LSCN与PCNN模型同属第三代神经网络的范畴,该代神经网络主要利用脉冲同步发放现象实现对相邻神经元的激发和抑制。

LSCN模型和PCNN有两个主要的不同点:第一个不同点是在该模型中膜电位由漏电积分器表示; 第二个不同点是反馈输入仅仅由激励表示。

基本的PCNN模型涉及到馈送输入、连接输入、内部活动项、点火阈值以及脉冲输出5个方面的内容,需要设定的参数数目高达10个。所以,众多参数设置的准确性将对融合结果产生严重的影响,同时运行过程中会浪费大量的计算资源。

相比之下,作为PCNN模型的改进模型,LSCN在输入信号采集机制上不断简化,待定参数的总量也大大减少。传统的PCNN模型中有三个漏电积分器,需要进行两次卷积运算。而在LSCN模型中,也有三个漏电积分器,但只需进行一次卷积运算。这—点决定了LSCN模型的时间复杂度低于传统模型,同时可以看出内部活动项与外部激励的关系更直接。不仅如此,与传统PCNN不同,LSCN模型的迭代过程是自动停止而不是手动设置的,在多次迭代中,操作更加方便。

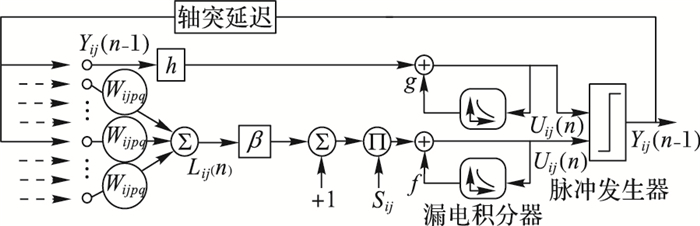

LSCN的基本神经元结构如图 1所示。

|

图 1 LSCN基本神经元结构 Figure 1 Basic neuronal structure in LSCN |

LSCN模型的数学表达式如下:

| $ {F_{ij}}{\rm{(}}n{\rm{)}} = {S_{ij}} $ | (1) |

| $ { L _{ij}}{\rm{(}}n{\rm{)}} = l{L_{ij}}{\rm{(}}n - {\rm{1)}} + \sum\limits_{pq} {{W_{{{ijpq}}}}{Y_{pq}}} {\rm{(}}n - {\rm{1)}} $ | (2) |

| $ {U_{ij}}{\rm{(}}n{\rm{)}} = f{U_{ij}}{\rm{(}}n - {\rm{1)}} + {S_{ij}}{\rm{(1}} + \beta {L_{ij}}{\rm{(}}n{\rm{))}} $ | (3) |

| $ {\Theta _{ij}}{\rm{(}}n{\rm{)}} = {\Theta _{ij}}{\rm{(}}n - {\rm{1)}} - \delta + h{Y_{ij}}{\rm{(}}n - {\rm{1)}} $ | (4) |

| $ {Y_{ij}}{\rm{(}}n{\rm{)}} = \left\{ \begin{array}{l} 1, \;\;\;\;\;\;\;\;\;{U_{ij}}{\rm{(}}n{\rm{)}} > {\Theta _{ij}}{\rm{(}}n{\rm{)}}\\ {\rm{0, }}\;\;\;\;\;\;\;\;\;{\rm{其他}} \end{array} \right. $ | (5) |

式中:Fij(n)为神经元的反馈输入;(i, j)表示每个神经元的索引;Sij携带刺激信息;Lij(n)为连接输入;(p, q)表示其相邻神经元;l为连接常数;Wijpq为应用于连接突触的权重;Yij(n-1)是突触后动作电位。在本文中,膜电位由漏电积分器表示,Uij(n)为内部活动项,其中f是膜电位衰减常数,β是连接强度;神经元的阈值由漏电积分器表示,Θij(n)是点火阈值;δ是一个小的正常数;h是幅度调整;Yij(n)为脉冲输出。

2 本文算法 2.1 算法原理在LSCN网络中,图像里每个像素点相当于一个神经元。当某个神经元的Uij(n)>Θij(n)时,该神经元点火,发出一个脉冲。此时阈值Θij(n)通过反馈输入迅速提高,致使该神经元停止发射脉冲。阈值随着时间开始衰减,当其再次小于内部活动项时,神经元再次点火,如此反复。神经元点火频率越大说明对应像素点的亮度越大。

在图像融合中融合指标的好坏直接影响到融合结果。以往的基于PCNN及其改进模型的融合算法中均是根据若干次迭代后神经元的点火频率来决定融合后图像的像素。选择点火频数较大的那幅图像所对应的像素值作为融合后图像的像素值。点火频率如式(6):

| $ {M_{ij}}{\rm{(}}n{\rm{)}} = {M_{ij}}{\rm{(}}n - {\rm{1)}} + {Y_{ij}}{\rm{(}}n - {\rm{1)}} $ | (6) |

但在本文中,使用L项代替传统的点火频率作为输出。由式(2)与(6)可知,当l取1时,L项和点火频率相似。但L项在每次迭代中均对Y作了卷积处理,实验证明L项代替点火频率输出能够取得更好的效果。

2.2 算法流程假定CT图像为A,MRI为B,并且已经过几何配准处理。融合过程如下:

1) 分别将待融合图像A和B作为LSCN模型的反馈输入;

2) 初始值设置为Lij(0)=0,Uij(0)=0,Yij(0)=0,YYij(0)=0,Θij(0)=1;

3) 分别按照式(1)~(5),计算Lij(n)、Uij(n)、Θij(n)、Yij(n);

4) 使用L项代替传统的点火频率作为输出;

5) 迭代使用式(1)~(5),使用多通工作方式作为迭代终止条件;

6) 利用比较选择算子得到融合后图像的像素,如式(7)所示:

| $ \mathit{F}{\rm{(}}i, j{\rm{) }} = \left\{ {\begin{array}{*{20}{c}} {A{\rm{(}}i, j{\rm{) }}, }\\ {B{\rm{(}}i, j{\rm{) }}, } \end{array}} \right.\begin{array}{*{20}{c}} {{\rm{ }}\;\;{L_A}{\rm{(}}i, j{\rm{)}} \ge {L_B}{\rm{(}}i, j{\rm{) }}}\\ {\;\;{L_A}{\rm{(}}i, j{\rm{) < }}{L_B}{\rm{(}}i, j{\rm{) }}} \end{array} $ | (7) |

式(7)中LSCN的L项数值越大,表示该像素点的亮度越大,所以选择该点为融合后图像中的像素点。

在使用LSCN模型处理图像时,迭代次数一直是一个棘手的问题,传统的算法中迭代次数总是通过大量的实验或者个人经验来设置。但迭代效果的好坏与迭代次数有很大的关系,如果迭代次数过大,将会浪费计算资源,迭代次数过少,将会导致算法运行不充分。LSCN模型中使用多通工作方式作为迭代终止条件,即当所有神经元都点火迭代终止。设N是神经元的总数,在每一次迭代中神经元点火的次数被统计,YY矩阵的初始值是0,其大小与Y相同,YY和Y之间是或运算关系,当YY矩阵中所有元素均为1时迭代终止,也就是YY中1的个数总和为N。

本文算法中LSCN的其他参数为:神经元的连接范围为3×3,f=0.2,β=3,δ=1/255,l=1,h=3,

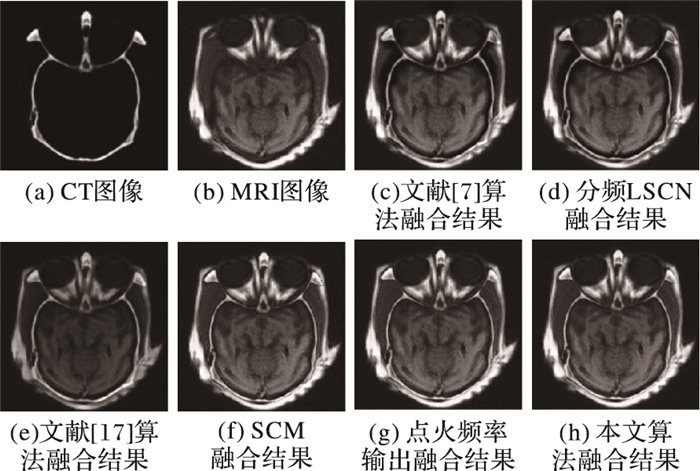

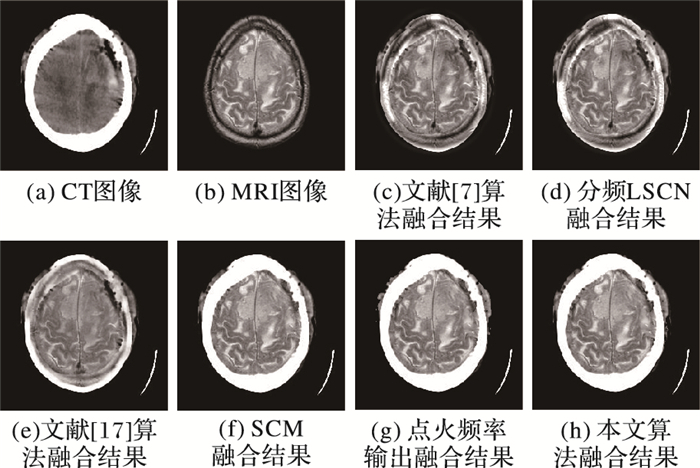

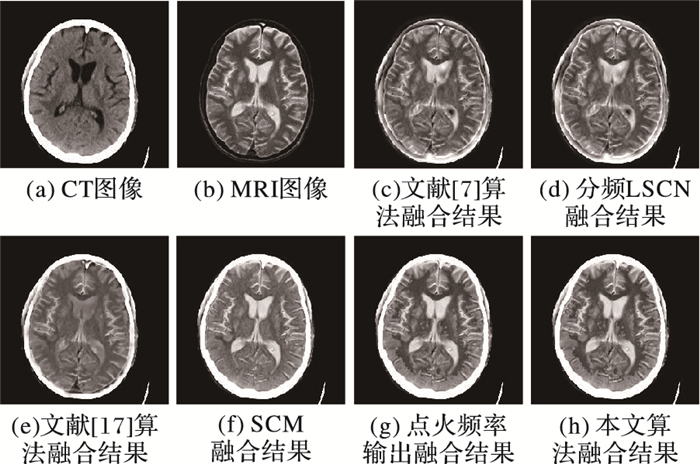

本文分别使用正常脑部、脑膜瘤、脑弓形虫病的CT和MRI图像进行融合仿真实验。实验环境为:64位Windows 7操作系统,Matlab R2015b,Intel Core i5-2430,2.4 GHz处理器,8 GB运行内存。实验图片来自哈佛大学医学院。实验结果如图 2~4所示。

|

图 2 正常脑部的CT与MRI图像及融合结果 Figure 2 CT and MRI images and fusion results of normal brain |

|

图 3 脑膜瘤患者的CT与MRI图像及融合结果 Figure 3 CT and MRI images and fusion results of meningioma |

|

图 4 脑弓形虫病患者的CT与MRI图像及融合结果 Figure 4 CT and MRI images and fusion results of brain toxoplasmosis |

从图 2~4的子图(a)和(b)中可以看出:CT图像中骨骼成像突出,但软组织对比度较低;MRI图像则不同,骨结构显示较差,但软组织分辨力高,更有利于对病灶位置的定位。将文献[7]算法、在NSCT下LSCN模型的融合算法、文献[17]算法、基于SCM的融合算法、使用点火频率作为输出的LSCN融合方法和本文算法进行比较。其中文献[7]算法为在NSCT下基于PCNN模型的融合算法,该模型的输出为点火频率;NSCT下LSCN模型的融合算法与文献[7]的融合框架相同,其输出为L项;文献[17]为没有分频的PCNN融合算法,该模型的输出为点火频率;基于SCM的融合算法中,SCM模型是在PCNN上改进而来的,其输出仍为点火频率;使用点火频率作为输出的LSCN算法和本文中使用L项作输出的算法的区别仅在于输出项,目的是为了比较LSCN模型分别以点火频率和L项来指导融合的结果。传统的算法均是通过点火频率的大小来选取融合后图像的像素值。本文算法和分频的LSCN算法是用L项的大小来决定融合后图像的像素值。将本文算法与四种传统算法进行对比,目的是比较分别使用L项和点火频率进行图像融合的结果。

分频的LSCN算法、点火频率输出的LSCN算法中参数和本文算法相同。参考文献[18],SCM的参数为:f=0.2,g=0.9,h=20,

由图 2~4可见:6种算法都成功地融合了两幅图像,既突出了脑部的骨骼部分又包含了软组织的信息,取得了不错的效果。

仔细观察可以发现:图 2(c)和2(d)中视觉效果差不多,但是均丢失了源MRI中的部分信息。图 2(e)中软组织和骨骼信息较暗,图像质量较差;图 2(f)~(h)的融合结果较好,但图 2(h)的视觉效果最好,可以很好地保留图像的空间细节信息,骨骼信息突出,软组织对比度高,成像质量最好。

图 3(c)、(d)中在对MRI源图像信息的提取和表达上表现不佳,存在一些伪影,图 3(e)视觉效果相对好一些,但是存在同样的问题。相比之下,图 3(f)、(g)、(h)的清晰度、对比度较高,但本文算法中软组织部分与源图像较接近,融合效果最好。

由图 4中脑弓形虫病患者MRI图像可知,图 4(c)、(d)中细节信息丰富,但是图像灰暗难以观察;图 4(e)中源MRI中的很多细节被弱化;图 4(f)、(g)、(h)在视觉效果上优于其他对比算法,但本文算法中信息丰富成像质量最好。

以上是从人眼角度的主观评价,为了更加全面地对融合结果进行评估,本文选取了客观评价指标互信息(Mutual Information, MI)、边缘信息评价因子(Edge Information Evaluation Factor, QAB/F)、信息熵(Information Entropy, IE)、标准差(Standard Deviation, SD)、空间频率(Space Frequency, SF)、平均梯度(Average Grads, AG)(AG可衡量图像的清晰度)对融合图像进行评价。以上6个指标的值越大融合效果越好, 评价结果如表 1~3所示。

| 表 1 正常脑部的客观指标 Table 1 Objective indicators of normal brain |

| 表 2 脑膜瘤的客观指标 Table 2 Objective indicators of meningioma |

| 表 3 脑弓形虫病的客观指标 Table 3 Objective indicator of brain toxoplasmosis |

由表 1可以看出,本文算法中选用L项作为输出在QAB/F、IE、SD、SF、AG均高于点火频率作为输出时的值。本文算法有4项指标高于SCM算法,有5项指标高于文献[17]算法; 本文算法有4项指标高于分频后的LSCN,其中IE、AG低于该算法; 本文算法有4项指标高于文献[7]算法,IE、AG低于该算法。

由表 2可得本文算法在MI、QAB/F、IE、SD、SF、AG上均高于点火频率作为输出的值。本文算法有4项指标高于SCM,1项与其相同,有5项指标的值高于文献[17]算法;本文算法有4项指标高于分频后的LSCN,其中IE和AG均低于该算法;本文算法有4项指标高于文献[7]算法,其中在IE和AG上低于该算法。

由表 3可得本文算法在QAB/F、IE、SD、SF、AG均高于点火频率作为输出的值。本文算法中5项指标均高于SCM,有6项指标均高于文献[17]算法;本文算法有4项指标高于分频后的LSCN,其中IE和AG均低于该算法;本文算法有4项高于文献[7]算法,其中文献[7]算法中IE和AG高于本文算法。

由表 1~3可知,本文算法和文献[7]算法、文献[17]算法、SCM算法、以点火频率输出的LSCN算法这些均是以点火频率作为指标来融合图像的算法相比,6项客观评价指标中均有大于等于4项优于对比算法。本文算法和分频LSCN算法均是使用L项作为指标来融合图像,但本文算法也有4项指标明显高于对比算法。综上所述,本文算法取得了不错的结果,不仅能够较好地融合图像信息而且保留了细节部分,客观评价与直观观察结果保持一致。

通过观察文献[7]算法、分频LSCN算法实验结果可知,这两种算法在IE、AG上均明显高于其他算法。分频的LSCN算法在IE、AG上均高于本文算法,这两种算法的区别仅在于分频与否,因此可得到一个结论:在利用LSCN模型进行图像融合时,如果首先对图像进行NSCT分频处理,分频后的LSCN算法在IE和AG指标上较高;如果不分频,则该算法在MI、QAB/F、SD、SF上较高。因此在使用该模型进行图像融合时可以针对融合图像的需求选择合适的算法。如果注重融合图像的IE和AG则可对图像进行分频处理;如果更注重MI、QAB/F、SD、SF则不需分频。

4 结语本文首次使用LSCN模型进行图像融合实验,并使用多通工作方式作为迭代终止条件,使用该模型中L项代替点火频率作为输出,解决了传统PCNN模型参数过多、参数和迭代次数难设置及融合效果差等问题,同时得出使用LSCN模型进行图像融合时是否需要分频处理的结论。通过与五种算法进行对比得出,本文算法不论是从人眼还是客观评价指标均优于对比算法。

目前基于PCNN模型进行图像融合的文献较多,而基于两种经典的简化模型ICM和SCM的融合算法研究较少,特别是,截止目前尚未发现基于LSCN模型进行图像融合的文献和相关研究成果。因此,接下来的工作就是对该模型进一步地深入研究,比如对激励和连接强度的改进等。

| [1] | WANG Z B, WANG S, ZHU Y, et al. Review of image fusion based on pulse-coupled neural network[J]. Archives of Computational Methods in Engineering, 2016, 23(4): 659-671. DOI:10.1007/s11831-015-9154-z |

| [2] | LIU Y, LIU S P, WANG Z F. A general framework for image fusion based on multi-scale transform and sparse representation[J]. Information Fusion, 2015, 24: 147-164. DOI:10.1016/j.inffus.2014.09.004 |

| [3] | 佘二永, 王润生, 徐学文. 基于统计模型的遥感图像多分辨融合方法[J]. 电子学报, 2008, 36(3): 490-493. (SHE E Y, WANG R S, XU X W. Multi-Resolution fusion of remote sensing image based on statistical model[J]. Acta Electronica Sinica, 2008, 36(3): 490-493.) |

| [4] | ZHAN K, SHI J H, WANG H B, et al. Computational mechanisms of pulse-coupled neural networks:a comprehensive review[J]. Archives of Computational Methods in Engineering, 2017, 24(3): 573-588. DOI:10.1007/s11831-016-9182-3 |

| [5] | 薛寺中, 周爱平, 梁久祯. 基于小波变换的自适应脉冲耦合神经网络图像融合[J]. 计算机应用, 2010, 30(12): 3225-3228. (XUE S Z, ZHOU A P, LIANG J Z. Image fusion based on wavelet transform and adaptive PCNN[J]. Journal of Computer Applications, 2010, 30(12): 3225-3228.) |

| [6] | 邓翔宇, 马义德. PCNN参数自适应设定及其模型的改进[J]. 电子学报, 2012, 40(5): 955-964. (DENG X Y, MA Y D. PCNN model automatic parameters determination and its modified model[J]. Acta Electronica Sinica, 2012, 40(5): 955-964.) |

| [7] | QU X B, YAN J W, XIAO H Z, et al. Image fusion algorithm based on spatial frequency-motivated pulse coupled neural networks in nonsubsampled contourlet transform domain[J]. Acta Automatica Sinica, 2008, 34(12): 1508-1514. DOI:10.1016/S1874-1029(08)60174-3 |

| [8] | 王佺, 聂仁灿, 周冬明, 等. 多目标粒子群优化PCNN参数的图像融合算法[J]. 中国图象图形学报, 2016, 21(10): 1298-1306. (WANG Q, NIE R C, ZHOU D M, et al. Image fusion algorithm using PCNN model parameters of multi-objective particle swarm optimization[J]. Journal of Image and Graphics, 2016, 21(10): 1298-1306. DOI:10.11834/jig.20161004) |

| [9] | 薛寺中, 周爱平, 梁久祯. 基于小波变换的PCNN多传感器图像融合[J]. 计算机工程与应用, 2011, 47(35): 210-213. (XUE S Z, ZHOU A P, LIANG J Z. Fusion of multi-sensor images based on wavelet transform and PCNN[J]. Computer Engineering and Applications, 2011, 47(35): 210-213. DOI:10.3778/j.issn.1002-8331.2011.35.059) |

| [10] | EKBLAD U, KINSER J M, ATMER J, et al. The intersecting cortical model in image processing[J]. Nuclear Instruments & Methods in Physics Research, 2004, 525(1/2): 392-396. |

| [11] | ZHAN K, ZHANG H J, MA Y D. New spiking cortical model for invariant texture retrieval and image processing[J]. IEEE Transactions on Neural Networks, 2009, 20(12): 1980-1986. DOI:10.1109/TNN.2009.2030585 |

| [12] | KONG W W. Multi-sensor image fusion based on NSST domain I2CM[J]. Electronics Letters, 2013, 49(13): 802-803. DOI:10.1049/el.2013.1192 |

| [13] | WANG N Y, MA Y D, ZHAN K. Spiking cortical model for multifocus image fusion[J]. Neurocomputing, 2014, 130(3): 44-51. |

| [14] | WANG R, WU Y, DING M Y, et al. Medical image fusion based on spiking cortical model[C]//Proceedings of the SPIE 8676, Medical Imaging 2013:Digital Pathology. Bellingham:SPIE, 2013:867610. |

| [15] | ZHAN K, SHI J H, TENG J C, et al. Linking synaptic computation for image enhancement[J]. Neurocomputing, 2017, 238: 1-12. DOI:10.1016/j.neucom.2017.01.031 |

| [16] | ECKHORN R, REITBOECK H J, ARNDT M, et al. A neural network for feature linking via synchronous activity[J]. Canadian Journal of Microbiology, 1989, 46(8): 759-763. |

| [17] | WANG Z B, MA Y D, GU J. Multi-focus image fusion using PCNN[J]. Pattern Recognition, 2010, 43(6): 2003-2016. DOI:10.1016/j.patcog.2010.01.011 |

| [18] | 王念一. 脉冲发放皮层模型图像融合技术研究[D]. 兰州: 兰州大学, 2014: 28-47. (WANG N Y. Spiking cortical model for image fusion[D]. Lanzhou:Lanzhou University, 2014:28-47.) http://cdmd.cnki.com.cn/article/cdmd-10730-1015514365.htm |