图像去色(Color-to-Gray, C2G)算法, 即彩色图像转灰度图像的算法, 是图像处理和机器视觉的基础, 在科技飞速发展的今天, 虽然彩色打印机在逐步推广应用, 但是黑白打印的廉价高效依然使其在印刷行业占据主要地位。同时, 单通道的灰度图使得常用的图像处理以及计算机视觉算法更加高效, 因此目标识别、目标检测和图像检索等算法都需要基于去色图像进行后续处理。近年来, 大量的新颖的去色算法被提出, 如Lu等[1]在2014年提出了对比度保持去色算法, Du等[2]提出了显著性特征保持的去色算法。由于各类去色算法效果千差万别, 提出一种客观准确的去色图像质量评价算法显得十分迫切。更为重要的是, 客观的去色图像质量评价指标也能够指导图像去色算法的发展。因此准确评估去色图像的质量意义重大。

然而, 有以下两个问题制约了图像去色质量评估的发展:1) 图像去色算法实际上是一个将一个3通道彩色图像转换成一个单通道灰度图像的过程, 所以不可避免地带来图像信息的损失。而现有的典型的客观的图像质量评价(Image Quality Assessment, IQA)方法仅能适用于彩色图像与彩色图像的对比或者去色灰度图像与去色灰度图像的对比情况, 并不适用于图像去色算法这种特殊的情况。2) 图像去色算法质量评价的标准难以选取, 现有的去色算法评估指标与人的主观判定存在着较大差异。早期, Bala等[3]召集了6个观察者去主观评价其提出的去色算法产生的图。虽然评价结果可靠, 但效率十分低下, 不适用于现今大数据时代下海量图片评估的场景。Kuhn等[4]提出了加权均方根值(Root Weighted Mean Square, RWMS)来评判灰度图对彩色图中颜色差异的保留情况, 而文献 [1]提出用E-Score来评估图像质量。但Ma等[5]认为这两个指标常常与人的主观判断不一致, 其不足以作为可信的评价标准,为此提出了一种基于彩色图和灰度图的结构相似性(C2G Structure Similarity Index Measurement, C2G-SSIM)的评价方法。该方法综合考虑了图像的亮度、对比度、结构信息,通过计算区域的相似性, 引入权重, 得到了灰度图和彩色图像的全局相似性。该指标非常接近于人类视觉感知机理, 但是经实验发现, 该方法对边缘细节的敏感度不高, 并且对颜色对比度不一致的情况惩罚力度过大, 从而忽略掉了图像中的连续颜色信息, 导致其评价结果不完全准确。由于人眼对图像的边缘结构信息极其敏感[6], 而边缘结构信息表现在图像的梯度幅值,因此彩色的参考图和灰度测试图应当有一致的梯度幅值特征(Gradient Magnitude, GM)。而人类视觉感知系统(Human Visual System, HVS)对颜色对比度的敏感性决定了应减轻对颜色对比度相似度计算的束缚。客观的图像质量评价方法主要有全参考质量评价、无参考质量评价、半参考质量评价三种。考虑到图像的去色处理中, 灰度图对应的彩色图像是能够获知的, 所以, 采用无参考或者半参考在去色质量评估中都不太合适。

本文对去色图像的梯度幅值、对比度等指标与图像质量的关系进行了深入的研究, 提出了一种全参考的去色图像质量评估算法——基于去色图像视觉相似度的去色图像质量评估(Color to Gray Visual Similarity Index Measurement, C2G-VSIM)算法。实验结果表明, 本文方法符合人眼视觉系统感知图像质量的过程, 相对于C2G-SSIM[5]、RWMS[4]和E-score[1]等算法, 得到的结果与主观评价具有更好的一致性。

1 C2G-SSIM算法 1.1 C2G-SSIM算法指标计算C2G-SSIM是Ma等[5]提出的一个客观的去色图像质量评价模型, 可用来快速地对去色图像进行质量评估。该算法将彩色图像作为参考图, 由不同去色算法产生的与该图像相关的去色灰度图像作为测试图, 其评价结果能够和主观质量评价达到较高的一致性。其通过计算亮度相似度、对比度相似度和结构相似度三个指标, 最后获取去色图像和参考彩色图像的全局相似度。亮度相似度的定义如下:

| $L({x_c}) = \frac{{2{u_f}({x_c}){u_g}({x_c}) + {C_1}}}{{{u_f}{{({x_c})}^2} + {u_g}{{({x_c})}^2} + {C_1}}}$ | (1) |

其中:uf(xc)和ug(xc)代表彩色图像和去色图像的平均亮度。

对比度相似度的计算方法如下所示:

| $C({x_c}) = \frac{{2{d_f}({x_c}){d_g}({x_c}) + {C_2}}}{{{d_f}{{({x_c})}^2} + {d_g}{{({x_c})}^2} + {C_2}}}$ | (2) |

其中:df(xc)和dg(xc)分别代表彩色参考图像和去色图像的颜色对比度的均值。

而结构相似度的定义如下:

| $S({x_c}) = \frac{{{\sigma _{fg}}({x_c}) + {C_3}}}{{{\sigma _f}({x_c}){\sigma _g}({x_c}) + {C_3}}}$ | (3) |

其中:σf(xc)和σg(xc)分别代表彩色图像和去色图像的颜色对比度的标准差;σfg(xc)代表着彩色图像和去色图像的颜色对比度的互相关函数。

在式(1) ~(3) 中, C1、C2和C3是分子和分母中的一个值很小的正数, 用来防止出现分母为0的情况。实验中, C1、C2和C3分别设定为10、0.1、0.01。

1.2 C2G-SSIM的局限性C2G-SSIM算法虽然比较全面地利用了图像的亮度信息、对比度信息和结构信息,但是C2G-SSIM并不能完全接近人类主观评价结果, 同样有可能出现与主观评价结果相悖的情况。主要局限为:

1) C2G-SSIM中的对比度相似度的求解方法过于强调数值上的一致性, 导致算法容易忽略掉图像的连续的彩色信息。例如, 图 1是仅用C2G-SSIM中的对比度相似度对两张去色图像进行评价, 主观评价结果表明图 1(b)的质量优于图 1(c), 而C2G-SSIM的对比度相似度的评价结果却相反。这是由于该方法的对比度相似度的简单求解会导致无法捕捉到图像的连续性特征的失真情况。

|

图 1 C2G-SSIM中对比度相似度对去色图像的质量评价 Figure 1 Image quality assessment performing on color-to-gray images by the contrast similarity in C2G-SSIM |

2) C2G-SSIM算法容易忽略掉图像的局部对比度信息。并且人类视觉不仅仅受某点光照的影响, 还与该点周围的光照值有关。

因此, 应该考虑更多能够反映图像对比度和连续性信息的因素, 从而能够准确地对图像进行评价。

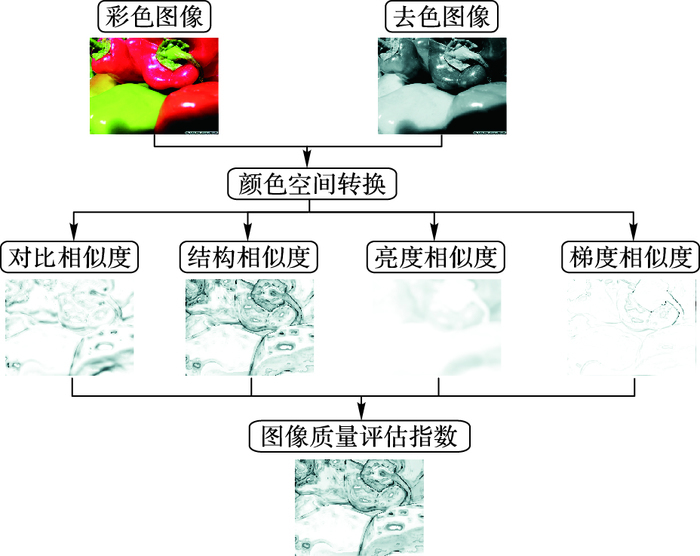

2 基于视觉相似度的去色图像质量评价 2.1 C2G-VSIM算法流程本文提出的基于视觉相似性的去色图像质量评价框架如图 2所示, 包括了颜色空间转换、视觉引导对比度相似度提取、结构相似度提取、亮度相似度提取、梯度相似度提取、合并处理共六个步骤。

|

图 2 C2G-VSIM流程 Figure 2 Flow diagram of C2G-VSIM |

本文主要提出视觉引导对比度相似度来捕捉图像全局性特征, 引入梯度幅值相似度来捕捉图像局部对比度信息, 然后联合亮度和结构相似度, 最终得到C2G-VSIM。

2.2 视觉引导对比度相似度文献 [5]对对比度相似度C (xc)的定义如式(2) 所示, C (xc)可以看作是去色图像对比度df(xc)和彩色图像对比度dg(xc)的组合函数。当 df(xc)的值和dg(xc)的值趋于一致时, 即 dg(xc)=df(xc), 对比度相似度C (xc)的值将达到它的最大值1。从此可以推论发现:C (xc)的值并不在意df(xc)和dg(xc)相比谁大谁小。即, 若df(xc)=1, dg(xc)=-1得到的C (xc)的值与df(xc)=-1、dg(xc)=1得到的C (xc)值是一样的。因此, 可以进一步推论, C (xc)的计算方式只关心df(xc)和dg(xc)的绝对距离|df(xc)-dg(xc)|。当绝对距离越小时, C (xc)的值会越大。很显然, 文献 [5]对对比度相似度的定义并未考虑分开处理以下两种情况:1) df(xc)比dg(xc)大;2) df(xc)比dg(xc)小。而文献 [7]研究表明:对同样的一幅场景, 人眼系统偏爱对比度较大的图像。更重要的是, 文献 [5]在计算去色图像质量评估指标时, 对原彩色图和去色图像的颜色对比度完全一致的要求会导致指标不关注图像的全局性特征, 从而忽略了图像的颜色一致性特征以及图像的局部细节, 导致算法指标与人类视觉主观评估有较大出入。

针对原算法对对比度相似度的简单计算导致算法指标不足以对去色图像进行正确评估的缺陷, 本文对对比度相似度的计算方式进行了改进, 提出了视觉引导对比度相似度算法, 算法流程如下:

Step1 颜色空间转换。将去色图像g (x)和彩色图像f (x)进行颜色空间转换至CIELab空间。

Step2 图像高斯平滑。本文对图像是基于块操作计算对比度相似度, 因而需要考虑块效应的影响, 用高斯径向函数p (x, xc)对图像进行高斯滤波, 可以有效防止图像块的边界尖锐化。

| $p(x,{x_c}) = \exp ( - \frac{{{{\left\| {x - {x_c}} \right\|}^2}}}{{2\sigma _p^2}})$ | (4) |

式(5) 中σp取决于高斯滤波器的宽度w;本文中w取值为15,

| ${\sigma _p} = {\rm{floor}}(w/6)$ | (5) |

因此σp取值为2。

Step3 对比度求解。逐像素的计算图像每一点对其周围宽度为w的图像块的对比度df(xc)和dg(xc)。

| $d({x_c}) = \frac{1}{{\int {p(x,{x_c}){\rm{d}}x} }}\int {\varphi ( {{\delta _x}} } )p(x,{x_c}){\rm{d}}x$ | (6) |

点xc至点y欧氏距离在CIELab空间定义为:

| $|{\delta _x}| = \sqrt {{{({L_x} - {L_y})}^2} + {{({a_x} - {a_y})}^2} + {{({b_x} - {b_y})}^2}} $ | (7) |

Step4 视觉引导对比度修正。

如果df(xc) <dg(xc), 则减小df(xc)以减小C (xc); 如果df(xc)>dg(xc), 则减小df(xc)的值以加大C (xc)的值。定义如式(8) 所示:

| ${{d}_{f}}({{x}_{c}})=\left\{ \begin{align} & \frac{{{d}_{f}}({{x}_{c}})+{{d}_{g}}({{x}_{c}})}{2},\quad {{d}_{f}}({{x}_{c}})>{{d}_{g}}({{x}_{c}}) \\ & \frac{{{d}_{f}}({{x}_{c}})}{2},\quad \quad \quad \quad {{d}_{f}}({{x}_{c}})+C<{{d}_{g}}({{x}_{c}}) \\ \end{align} \right.$ | (8) |

在实验中, 设定视觉引导因子C=0.1。

Step5 C (xc)的计算。最后根据式(2) 即计算得出视觉引导对比度相似度。

视觉引导对比度相似度其充分考虑到了HVS对图像对比度的敏感性和对不同对比度的感知不同, 因此能使最终的C2G-VSIM高度接近于主观质量评价。

2.3 梯度幅值相似度HVS感知一幅图像的信息主要根据其低层次的特征[8-9], 即不需要关于形状和空间的先验知识就能从图像中提出的基本特征。因此, 去色图像质量评估方法的效果能够通过添加低层次特征得到提升。文献 [6]提出了FSIM来提升典型的全参考质量评估的效果。FSIM采用了2个特征来计算图像质量图, 即相位一致性和边缘梯度特征。然而, 相位一致性特征是对图像的对比度不敏感的, 而边缘梯度特征会影响到HVS对图像质量的感知[10]。彩色图像和去色图像应当具有一致的梯度特征, 该梯度特征能够很好地反映出图像的局部对比度特征。因此, 本文在C2G-SSIM的基础上, 仅选择增加了梯度幅值特征, 选取了在典型图像质量评估算法中常用的Scharr算子[6, 9]。求解流程如下:

Step1 高斯滤波。

Step2 梯度求解。选取CIELab空间的亮度通道, 求解其横向和竖向的梯度。其横向和纵向的边缘检测因子定义如下:

| ${{\mathit{\boldsymbol{G}}}_{x}}(x)=\frac{1}{16}\left[ \begin{matrix} 3 & 0 & -3 \\ 10 & 0 & -10 \\ 3 & 0 & -3 \\ \end{matrix} \right]*L(x)$ | (9) |

| ${{\mathit{\boldsymbol{G}}}_{y}}(x)=\frac{1}{16}\left[ \begin{matrix} 3 & 10 & 3 \\ 0 & 0 & 0 \\ -3 & 10 & -3 \\ \end{matrix} \right]*L(x)$ | (10) |

其中L (x)代表了图像颜色空间转换后的亮度通道。

Step3 梯度幅值相似度求解。去色图像和彩色参考图像的梯度幅值相似度定义为:

| $GM(x)=\sqrt{\mathit{\boldsymbol{G}}{}_{x}^{2}(x)+\mathit{\boldsymbol{G}}_{y}^{2}(x)}$ | (11) |

添加梯度幅值相似度能够很好地解决文献 [5]方法对局部对比度特征的并未重视的问题, 使最终结果更好地满足人类的视觉特性。

2.4 C2G-VSIM本文对亮度相似度、结构相似度进行简介, 详细描述了视觉引导性对比度相似度以及梯度幅值相似度。其中, 亮度相似度能表现去色图像和原参考彩色图像的亮度一致性, 其他3个相似度更加关注图像去色后的结构特征和对比度特征与原参考彩色图像的一致性。C2G-VSIM的总体质量评估定义如下:

| $q({{x}_{c}})=L{{({{x}_{c}})}^{\alpha }}\cdot C({{x}_{c}})\cdot S({{x}_{c}})\cdot GM({{x}_{c}})$ | (12) |

其中:根据图像类型确定α=1或者α=0。在得到总体的去色图像质量评估的质量图之后, 本文采用该质量图的均值Q来表示相似度得分。得分越高, 代表去色图像和彩色参考图像的相似度越高;反之则越低。Q的计算方式如下:

| $Q(f,g)=\frac{1}{M}\sum\limits_{i=1}^{M}{q({{x}_{i}})}$ | (13) |

其中:M代表整个图像的空间大小。

3 实验结果分析 3.1 实验数据集本文采用了Cadík的图像数据集[11], 该数据集包含了24张不同类型的彩色图, 每张彩色图又附带7张由不同的去色方法产生的灰度图。该数据库包含与同一张彩色图相关的7张去色图像的主观评价排名, 其排名分两个标准:准确度和喜爱度。准确度是指已知原图对7张图进行比较, 主要评估与原图的相似性。喜爱度是未知原图对7张图进行比较, 主要评估人类主观对去色图的喜爱程度。更为重要的是:该数据库是在去色图像领域中唯一一个含有7种不同去色方法的主观质量评价排名的数据库, 包含了20328次主观评价结果。因此, 本文选择该数据集的主观评价结果作为实验对象。本文根据Ma等[5]提出的熵区分方法将24张彩色图像自动分为两类:自然图像(Photographic Images, PI)和人工图像(Synthetic Images, SI)。表 1展现了图像分类的具体情况, 在实验中, 计算自然图像或者人工图像时, 分别设置式(12) 中的α=1或者α=0。

| 表 1 彩色参考图像的分类 Table 1 Categories of reference color images |

本文在文献 [11]的图像数据集上, 对本文提出的C2G-VSIM和3个其他的传统的C2G-SSIM[5], E-score[1]和RWMS[4]去色图像质量评估指标进行了性能比较。本文实验是在Windows 7, Core i5处理器下用Matlab R2014b进行实验。

将斯皮尔曼秩相关系数(Spearman Rank Order Correlation Coefficient, SROCC)和肯德尔秩相关系数(Kendall Rank Order Correlation Coefficient, KROCC)作为衡量去色图像质量评估方法的预测结果的指标[12]。SROCC和KROCC的值越大, 则说明该评估方法的结果与主观评价结果的相关性越高, 与主观评价结果越接近, 该方法越好。

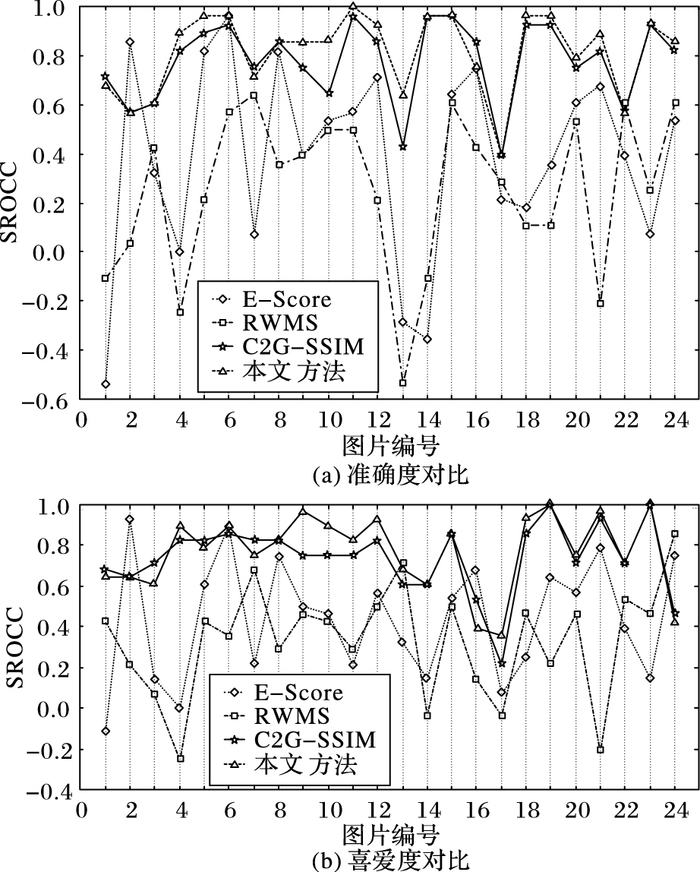

从图 3可以发现, RWMS和E-score在数据库中的SROCC得分波动较大, 例如, RWMS的SROCC得分在数据库第4张图上是-0.25, 而在第15张图上是0.6071。C2G-SSIM和本文方法都能够在数据库24张图上得到一致性的较好的结果, 而本文方法除此之外, 能够在大量的图上获得比C2G-SSIM[5]更高的SROCC得分, 意味着更好的与主观评价结果的一致性。

为了更直观地说明该实验的结果, 表 2根据4种方法在24张图上的SROCC和KROCC对4种方法进行总体评价。其中:“均值”是指图像数据库中24图的SROCC或KROCC的平均值,以衡量4种方法在24张图上的平均表现;PI和SI的SROCC和KROCC分别展现了自然图像和人工图像的平均表现。表 2直观地表现了本文方法无论在准确度实验上还是喜爱度实验上的评价性能都远远优于RWMS[4]、E-score[1]和C2G-SSIM[5]。即使在本文方法表现较差的PI的喜爱度实验中, C2G-VSIM的在准确度和喜爱度的实验中, 所有样本的平均SROCC比C2G-SSIM提高了0.03和0.02,本文方法的SROCC得分也比C2G-SSIM提高0.02。

| 表 2 4种去色图像质量评价方法的实验结果 Table 2 Experiment results of 4 methods |

因每一组图用4种不同的去色图像评估方法进行评判, 最终和主观评价能得到不同方法的SROCC得分。因此可以根据该组图在某种方法中能获得最好的SROCC得分进行分类。因一组图可在两种方法下都获得最好的结果, 用加粗注明可获得相同结果的图标号,并计算出分类占比。表 3展示了本文方法在大部分图组上除了第1、2、7和16图外都能获得最优结果。然而, 在这4组图上, 本文方法C2G-VSIM仅仅以微弱的劣势低于最优结果。E-Score和RWMS在几乎所有的图上都不能获得最优的表现, C2G-SSIM虽然能在大部分的图上获得一致性好的结果, 但本文方法却更加准确。

| 表 3 准确度实验的最优结果分类 Table 3 Image classification according to the best performance in accuracy test |

为了从数据上说明视觉引导对比度相似度比C2G-SSIM的相似度对比度更优,本文进行了对比度相似度的对比实验,如表 4所示。

| 表 4 不同对比度相似度实验结果对比 Table 4 Comparison of experimental results with different contrast similarity methods |

表 4的实验中仅利用C2G-SSIM的对比度相似度[5]和视觉引导对比度相似度对adík的图像数据集上进行去色图像质量评估, 得到两个评价方法与主观评价结果的SROCC得分。表 4结果表明视觉引导对比度相似度优于C2G-SSIM的对比度相似度, 准确度和喜爱度实验的SROCC得分比C2G-SSIM的对比度相似度提高了约0.05和0.06。

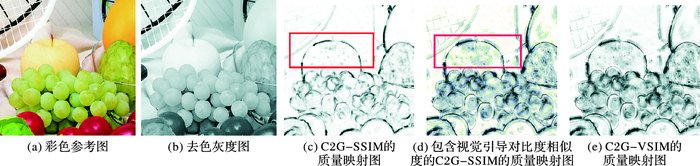

为了说明本文提出的改进后的对比度相似度和梯度幅值相似度是如何使得C2G-VSIM比C2G-SSIM更具竞争力, 图 4和图 5展现了去色图像和其彩色参考图像由不同质量评估方法产生质量映射图, 包括:1) C2G-SSIM;2) 包含视觉引导对比度相似度的C2G-SSIM;3) C2G-VSIM。其中, C2G-VSIM比视觉引导对比度相似度仅增加了梯度幅值相似度。质量映射图每个像素点的值代表着该点的相似度得分(取值范围为0~1) 。即若该像素点的值为1, 意味着该点的相似度得分为1, 达到最大值。质量映射图越干净, 参考彩色图与去色图像越接近。

|

图 4 梯度幅值特征的优势 Figure 4 Advantages of gradient magnitude similarity |

|

图 5 视觉引导对比度相似度特征的优势 Figure 5 Advantages of contrast similarity based on HVS |

对比图 4(e)和(d)可以发现:梯度幅值相似度特征可以反映原图和去色图的局部对比度的一致性(图 4(a)和(b)的文本和图中下方划线区域的局部对比度)。对比图 5(d)和(c)可以发现:图(d)更加能保持图像的细节信息(方框中的苹果的纹理), 说明视觉引导对比度相似度能够更好地保持图像的细节, 如颜色一致性、纹理特征。

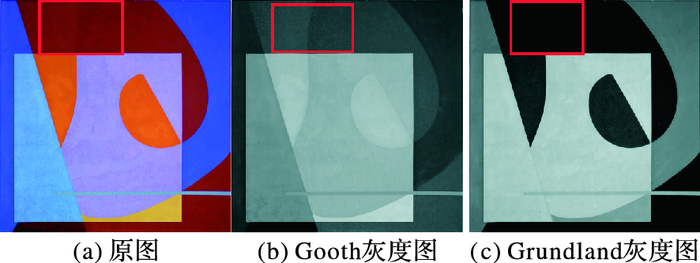

表 5展示了一个关于图 6的对比度相似度评估的具体的示例, 对比度相似度的均值作为图 6中的原图与两种不同算法产生的去色图像的质量评分。事实上, Grundland方法[13]产生的去色图像(图 6(c))的质量优于Gooth方法[14]产生的去色图像(图 6(b))的质量, 而原对比度相似度的结果与之相反。图 6用方框标记出Grundland方法的去色图像中明显丢失了相邻色块间的边界信息, 而该边界信息在Gooth方法中保留良好。视觉引导对比度相似度通过抓住颜色对比度的信息, 达到和主观评价方法一致的结果[15]。

|

图 6 彩色参考图与灰度图 Figure 6 Color reference image and gray images |

| 表 5 不同对比度相似度对比 Table 5 Comparison of different contrast similarity |

表 6从数值上表现了视觉引导对比度相似度和梯度幅值特征共同作用使C2G-VSIM远远优于其他的去色图像评估方法。

| 表 6 视觉引导对比度相似度与其他特征结合的结果 Table 6 Results of visual contrast similarity combined with other features |

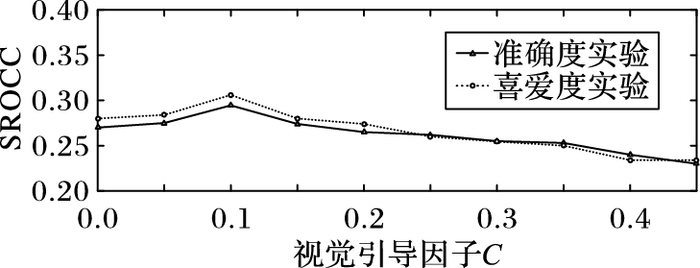

第2章对视觉引导对比度相似度算法引入了视觉引导因子C, 该参数由大量反复的实验确定。依然以adík的图像数据集为实验对象, 图 7为视觉引导对比度相似度在数据集上的准确度实验和喜爱度实验的SROCC得分随着视觉引导因子C变化的曲线。由图 7可知, 随着视觉引导因子C从0到0.5逐步增大, 本文视觉引导对比度相似度的SROCC值经历了先增大后变小的过程。在0.05~0.15间达到最大, 最终确定视觉引导因子C为0.1。

|

图 7 SROCC随视觉引导因子C的变化曲线 Figure 7 Change curve of SROCC with C |

本文算法通过提出一个全新的视觉引导对比度相似度和引入梯度幅值相似度提升了去色图像质量评估算法的性能。较C2G-SSIM而言, 本文算法时间复杂度有所增加。主要原因在于引入视觉引导因子, 逐像素地计算视觉引导对比度相似度使得每次循环计算时都会增加比较赋值的计算。而滤波以及梯度幅值相似度的计算并不涉及循环, 因此所引起的复杂度的增加可忽略。

假定原对比度相似度算法对一张M*N大小的图的时间为T, 其中需逐像素地进行对比度相似度的计算为M*N次, 每次都会基于块地计算对比度相似度, 单次增加的时间代价为t1, 而滤波以及梯度幅值相似度的计算所增加的时间为t2, 则本文算法相对于C2G-SSIM的耗时增加量为:

| $\Delta t=M\times N\times {{t}_{1}}+{{t}_{2}}$ | (14) |

经实验测定, t1≈9×10-6 s;t2≈0.05 s。因此, 对一张293*390大小的图像所增加的时间约为1.07 s。

本文通过实验测试了adík的图像数据集的耗时。经统计, C2G-SSIM对一张293*390大小的图像的耗时约为24.48 s, 本文算法为25.52 s,平均增加耗时为1.04 s, 与理论分析相吻合。

4 结语本文引入视觉引导对比度相似度和梯度幅值特征, 提出了全新的基于视觉相似性的去色图像质量评估算法。与C2G-SSIM、RWMS、E-score的对比实验结果表明, 本文方法能与主观评价获得较高的一致性。对视觉引导对比度相似度和梯度幅值相似度的作用探究实验结果表明, 视觉引导对比度算法能够较好地捕捉到图像连续色彩信息失真的情况, 梯度幅值相似度能够抓住图像局部对比度失真的情况[16]。本文算法相对于C2G-SSIM有了一定的提升, 能够较为准确对去色图像进行客观评价, 但是却增加了算法的计算量。因此, 去色图像质量评估算法仍有较大的发展空间, 如何进一步优化本文算法, 降低耗时是下一步研究的目标。

| [1] | LU C, XU L, JIA J. Contrast preserving decolorization[C]//Proceedings of the 2012 IEEE International Conference on Computational Photography. Piscataway, NJ: IEEE, 2012: 1-7. |

| [2] | DU H, HE S, SHENG B, et al. Saliency-guided color-to-gray conversion using region-based optimization[J]. IEEE Transactions on Image Processing, 2014, 24(1): 434-43. |

| [3] | BALA R, ESCHBACH R. Spatial color-to-grayscale transform preserving chrominance edge information[C]//CIC 2004: Proceedings of the Twelfth Color Imaging Conference: Color Science and Engineering Systems, Technologies, Applications. Scottsdale, Arizona, USA: [s.n.], 2004: 82-86. |

| [4] | KUHN G R, OLIVEIRA M M, FERNANDES L A F. An improved contrast enhancing approach for color-to-grayscale mappings[J]. The Visual Computer, 2008, 24(7): 505-514. |

| [5] | MA K, ZHAO T, ZENG K, et al. Objective quality assessment for color-to-gray image conversion[J]. IEEE Transactions on Image Processing, 2015, 24(12): 4673-85. DOI:10.1109/TIP.2015.2460015 |

| [6] | ZHANG L, ZHANG L, MOU X, et al. FSIM: a feature similarity index for image quality assessment[J]. IEEE Transactions on Image Processing, 2011, 20(8): 2378-86. DOI:10.1109/TIP.2011.2109730 |

| [7] | WU J, SHEN X, LIU L. Interactive two-scale color-to-gray[J]. The Visual Computer, 2012, 28(6): 723-731. |

| [8] | 崔力, 陈玉坤, 韩宇. 视觉相似性图像质量评价方法[J]. 西安电子科技大学学报(自然科学版), 2012, 39(4): 155-160. (CUI L, CHEN Y K, HAN Y. Visual similarity index for image quality assessment[J]. Journal of Xidian University (Natural Science), 2012, 39(4): 155-160.) |

| [9] | ZHANG L, SHEN Y, LI H. VSI: a visual saliency-induced index for perceptual image quality assessment[J]. IEEE Transactions on Image Processing, 2014, 23(10): 4270-4281. DOI:10.1109/TIP.2014.2346028 |

| [10] | ZHANG H, ZHU Q, FAN C, et al. Image quality assessment based on Prewitt magnitude[J]. AEU-International Journal of Electronics and Communications, 2013, 67(9): 799-803. DOI:10.1016/j.aeue.2013.04.001 |

| [11] | CADÍK M. Perceptual evaluation of color-to-grayscale image conversions[J]. Computer Graphics Forum, 2009, 27(7): 1745-1754. |

| [12] | ANTKOWIAK J, BAINA T J, GROUP T V Q E. Final report from the video quality experts group on the validation of objective models of video quality assessment, phase Ⅱ (FR_TV2) [EB/OL]. [2017-01-10]. https://www.itu.int/md/T01-SG09-C-0060. |

| [13] | GRUNDLAND M, DODGSON N A. Decolorize: fast, contrast enhancing, color to grayscale conversion[J]. Pattern Recognition, 2007, 40(11): 2891-2896. DOI:10.1016/j.patcog.2006.11.003 |

| [14] | GOOCH A A, OLSEN S C, TUMBLIN J, et al. Color2Gray: salience-preserving color removal[J]. ACM Transactions on Graphics, 2005, 24(3): 634-639. DOI:10.1145/1073204 |

| [15] | 刁扬桀, 张红英, 吴亚东, 等. 颜色保持的实时图像/视频去雾算法[J]. 计算机应用, 2014, 34(9): 2702-2707. (DIAO Y J, ZHANG H Y, WU Y D, et al. Real-time image/video haze removal algorithm with color restoration[J]. Journal of Computer Applications, 2014, 34(9): 2702-2707. DOI:10.11772/j.issn.1001-9081.2014.09.2702) |

| [16] | 袁艳春, 刘云鹏, 高宏伟. 基于边缘结构相似性的图像质量评价方法[J]. 计算机应用研究, 2015, 32(9): 2870-2873. (YUAN Y C, LIU Y P, GAO H W. Image quality assessment based on edge structure similarity[J]. Application Research of Computers, 2015, 32(9): 2870-2873.) |