CHEN Xiaoqing, born in 1990, M. S. candidate. Her research interests include machine learning, data mining.

LU Huijuan, born in 1962, Ph. D., professor. Her research interests include machine learning, pattern recognition, bioinformatics.

ZHENG Wenbin, born in 1973, Ph. D., associate professor. His research interests include machine learning, pattern recognition.

YAN Ke, born in 1983, Ph. D., lecturer. His research interests include machine learning, image processing.

前馈神经网络能够通过输入样本逼近复杂的非线性映射,因此在很多领域都有应用,但是存在学习速度慢、容易陷入局部收敛和在不同场合其参数难以调解等复杂问题,以致其发展受限。为解决这些问题,2006年Huang[1]提出一种新型单隐层前馈神经网络--极限学习机(Extreme Learning Machine, ELM),通过核函数将数据从低维空间映射到高维空间中,处理非线性数据,但是参数随机产生使结果存在一定的随机性,因此容易产生较差的分类效果。1995年James Kennedy和Russel Eberhart提出粒子群(Particle Swarm Optimization, PSO)算法[2-3],该方法是基于群体演化的随机全局优化的一种智能优化算法,其中心思想是对鸟群或鱼群合作捕食行为的研究。在优化复杂函数时,PSO算法的搜索精度不能达到要求,且易陷入局部最优的状况,到搜索后期经常会出现震荡情况。2009年,Lei等[4]提出了基于混沌序列的粒子群优化算法,通过引入混沌序列增强了算法的全局搜索能力。2012年,Han等[5]提出了用PSO算法对ELM进行优化,通过优化ELM的输入层权值及隐藏层偏差,得到一个最优的网络。2015年,Yang等[6]提出基于Tent混沌序列的PSO算法,在增强全局搜索能力的基础上有效地避免了算法的盲目性,提高了算法收敛速度。

本文通过分析ELM的缺点,提出一种新的自适应混沌粒子群-极限学习机(Adaptive Chaotic Particle Swarm Optimization-Extreme Learning Machine, ACPSO-ELM)分类器。在该算法中,首先通过ELM对给定的数据进行初始化,产生一组输入权值和隐藏层偏置,再通过ACPSO算法寻找最优输入权值和隐藏层偏置,最后将得到的结果代入ELM中训练。

1 极限学习机ELM是Huang在摩尔-彭罗斯广义逆矩阵理论的基础上提出的一种单隐层前馈神经网络的监督型学习算法,该算法由单隐层反馈神经网络发展而来,通过最小二乘法计算输出权值完成训练,同时算法的学习速度和泛化性能得到明显提高。

假设含有一个N个不同样本的矩阵(xi, ti),其中

| $ {\mathit{\boldsymbol{t}}_i} = \sum\limits_{i = 1}^L {{\beta _i}} {g_i}({\mathit{\boldsymbol{x}}_i}) = \sum\limits_{i = 1}^L {{\beta _i}} g({\mathit{\boldsymbol{w}}_i}{\mathit{\boldsymbol{x}}_j} + {\mathit{\boldsymbol{b}}_i}) $ | (1) |

其中:j=1, 2, …, N;wi=[w1, w2, …, wN]表示输入层与第i个隐层神经元的权值向量;βi=[β1, β2, …, βm]T表示第i个隐层节点到输出层的链接权值;bi=[b1, b2, …, bm]T表示第i个隐层节点的偏置,可用矩阵表示如下:

| $ \mathit{\boldsymbol{H\beta = T}} $ | (2) |

其中

| $ \left\{ \begin{array}{l} \mathit{\boldsymbol{H}} = \\ {\left[ {\begin{array}{*{20}{c}} {g({w_1} \cdot {x_1} + {b_1})}&{g({w_2} \cdot {x_1} + {b_2})}& \cdots &{g\left( {{w_L} \cdot {x_1} + {b_L}} \right)}\\ {g({w_1} \cdot {x_2} + {b_1})}&{g({w_2} \cdot {x_2} + {b_2})}& \cdots &{g\left( {{w_L} \cdot {x_2} + {b_L}} \right)}\\ \vdots & \vdots &{}& \vdots \\ {g\left( {{w_1} \cdot {x_N} + {b_1}} \right)}&{g\left( {{w_2} \cdot {x_N} + {b_2}} \right)}& \cdots &{g\left( {{w_L} \cdot {x_N} + {b_L}} \right)} \end{array}} \right]_{N \times L}}\\ \mathit{\boldsymbol{\beta }} = \left[ {\mathit{\boldsymbol{\beta }}_1^{\rm{T}}\mathit{\boldsymbol{\beta }}_2^{\rm{T}} \cdots \mathit{\boldsymbol{\beta }}_L^{\rm{T}}} \right]_{L \times m}^{\rm{T}}\\ \mathit{\boldsymbol{T}} = \left[ {\mathit{\boldsymbol{t}}_1^{\rm{T}}\mathit{\boldsymbol{t}}_2^{\rm{T}} \cdots \mathit{\boldsymbol{t}}_L^{\rm{T}}} \right]_{N \times m}^{\rm{T}} \end{array} \right. $ | (3) |

H表示神经网络的隐层输出矩阵,训练单隐层前馈神经网络可以转化为求解一个线性系统Hβ=T,并且输出权重β被确定方法如下:

| $ \mathit{\boldsymbol{\beta }} = \mathit{\boldsymbol{H}}*\mathit{\boldsymbol{T}} $ | (4) |

H*是矩阵H由Moore-Penrose的广义逆。由此可知,ELM算法不需要选取输入权值和隐层偏置也不会出现局部最优解的问题。

2 基于混沌系列的自适应粒子群算法 2.1 基本粒子群算法粒子群(PSO)算法是基于群体演化的随机全局优化的一种智能优化算法,在PSO算法中每个个体称为一个“粒子”,每个粒子代表一个问题的潜在解。假设在一个存有N个粒子的D维空间中,在第k次迭代时粒子的属性分别由位置向量

| $ \begin{array}{l} \mathit{\boldsymbol{v}}_{id}^{k + 1} = \mathit{\boldsymbol{v}}_{id}^k + {c_1}{r_1}(\mathit{\boldsymbol{pbest}}_{id}^k - \mathit{\boldsymbol{x}}_{id}^k)\\ + {c_2}{r_2}(\mathit{\boldsymbol{gbest}}_{id}^k - \mathit{\boldsymbol{x}}_{id}^k) \end{array} $ | (5) |

| $ \mathit{\boldsymbol{x}}_{id}^{k + 1} = \mathit{\boldsymbol{x}}_{id}^k + \mathit{\boldsymbol{v}}_{id}^{k + 1} $ | (6) |

其中:pbestid(i=1, 2, …, n, d=1, 2, …, D)表示粒子的个体最优位置;gbestid(i=1, 2, …, n, d=1, 2, …, D)表示搜索到的总群体最优位置;c1、c2表示粒子自我总结和向群体中优秀个体学习的能力,称为学习因子(又称加速系数);r1、r2是区间[0, 1]内均匀分布的随机数。

2.2 基于混沌序列的自适应全局最优粒子选择 2.2.1 自适应惯性权重与适应度方差虽然粒子群算法可以很快地收敛到较好的解,但是在处理多峰函数问题时容易出现早熟收敛的问题。为增强粒子跳出局部极值的能力,本文在速度更新时加入惯性系数ω,变化后的公式如下:

| $ \begin{array}{l} \mathit{\boldsymbol{v}}_{id}^{k + 1} = \mathit{\boldsymbol{\omega v}}_{id}^k + {c_1}{r_1}(\mathit{\boldsymbol{pbest}}_{id}^k - \mathit{\boldsymbol{x}}_{id}^k)\\ + {c_2}{r_2}(\mathit{\boldsymbol{gbest}}_{id}^k - \mathit{\boldsymbol{x}}_{id}^k) \end{array} $ | (7) |

| $ \mathit{\boldsymbol{\omega }} = ({\mathit{\boldsymbol{\omega }}_{\max }} - {\mathit{\boldsymbol{\omega }}_{\min }}) \times \exp ( - {(\mathit{\boldsymbol{\tau }} \times k/{K_{\max }})^2}) + {\mathit{\boldsymbol{\omega }}_{\min }} $ | (8) |

其中:ωmax、ωmin分别为最大、最小惯性系数;Kmax为最大迭代次数;τ为经验值,一般在[20, 55]内取值。惯性系数一般在初期较大,随着算法迭代次数的增加逐渐减小。通过改变惯性系数的大小,达到不同的搜索效果,随着惯性系数由大到小的变化,算法的性能也在发生改变,由初期的搜索能力较强到后期局部发掘能力的提高。

设fi为粒子群中第i个粒子的当前适应度值,favg为粒子群当前状态下的平均适应度值,σ2为粒子群的群体适应度方差,适应度方差的公式定义如下:

| $ \left\{ \begin{array}{l} {\sigma ^2} = \frac{1}{N}\sum\limits_{i = 1}^N {{{\left( {\left( {{f_i} - {f_{avg}}} \right)/f} \right)}^2}} \\ f = \max \left[ {1,\max \left| {{f_i} - {f_{{\rm{avg}}}}} \right|} \right] \end{array} \right. $ | (9) |

其中σ2反映了粒子群的聚集程度,σ2越小,说明群体越趋于收敛。

2.2.2 混沌序列混沌是一种无规则的运动状态,遵循确定性规则,其潜在规则是非线性,并且表现出持续的不规则性。它能够使非线性系统在不添加任何随机因子的状态下产生随机性的混沌运动, 可以在一定区域内遍历粒子的每一个状态,并且每个状态只访问一次。混沌序列的这些性质使得基于混沌序列的PSO算法能够有效地避免陷入局部最优解的状态,获得全局最优解,本文使用的混沌方程是Logistic方程,表达式为:

| $ {Z_{i + 1}} = \mu {Z_i}\left( {1 - {Z_i}} \right);\mu \in \left( {2,\left. 4 \right]} \right. $ | (10) |

式中:i=1, 2, …, N;Zi∈(0, 1)为实数序列;μ为控制参量,当μ=4时,系统处于完全混沌状态。

在PSO算法中,当算法运行到后期时,一些粒子的pbest接近群体的gbest,此时,粒子的运行速度受限,逐渐变慢。随着算法的运行,其他的一些粒子慢慢聚集到这些速度接近零的粒子周围,导致算法过早地收敛到局部最优点。因此,为使粒子跳出局部最优点,通过使用混沌序列帮助这些粒子逃出局部最优点并快速地获得全局最优解。

当算法出现早熟收敛的状况时,位置按如下公式更新:

| $ x\left( {t + 1} \right) = x\left( t \right) + {Z_{i + 1}} \times \left( {{x_{\max }} - x\left( t \right)} \right) $ | (11) |

其中xmax为最大位置变量。

改进后的自适应粒子群优化算法步骤如下:

步骤1 给定训练与测试数据集,在训练前,对数据进行归一化处理。

步骤2 建立基于ACPSO的极限学习机神经网络拓扑结构,设置隐层神经元数目,选中激活函数。

步骤3 产生种群,设置粒子数N,每个粒子设置为[-1, 1]范围内的随机数向量,设置神经元个数及隐层节点数。

步骤4 初始化ACPSO的速度与位置变量,设置种群的个体最优位置pbest、群体最优位置gbest。

步骤5 计算每个粒子的适应度值,先计算网络实际输出,再求期望输出值与实际输出值的均方误差,即得到粒子的适应度值。

步骤6 根据式(6)、(7)更新自适应粒子群的位置和速度。

步骤7 计算种群适应度方差,根据方差值判断算法是否收敛,若收敛则转步骤9;否则转步骤8。

步骤8 根据式(10)、(11)进行混沌搜索,用搜索到的点随机取代粒子群中的一个粒子,然后转步骤5。

步骤9 判断是否达到最大迭代次数:若达到,则停止迭代; 否则转步骤5,继续迭代。

3 算法描述与实验结果本文为得到分类精度高、泛化性能好和鲁棒性高的分类模型,提出了ACPSO-ELM算法,该算法结合ACPSO算法的高稳定与ELM算法分类速度快、精度高的特点,通过实验对算法性能进行验证。本文从UCI标准分类数据集中选择Breast、Heart、Colon三种基因数据集进行实验,实验由Matlab编程仿真实现。每个数据集如表 1所示:

| 表 1 数据集信息表 |

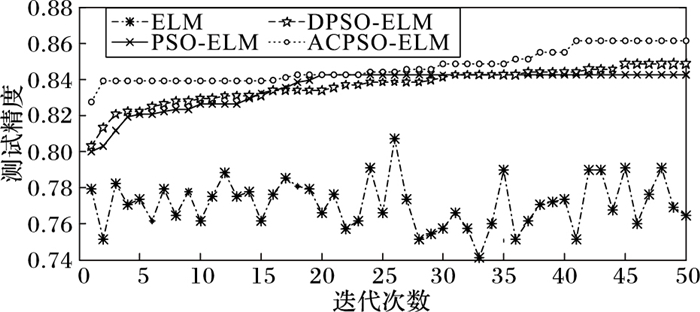

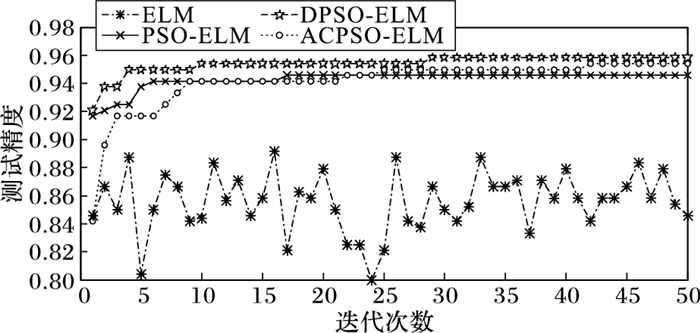

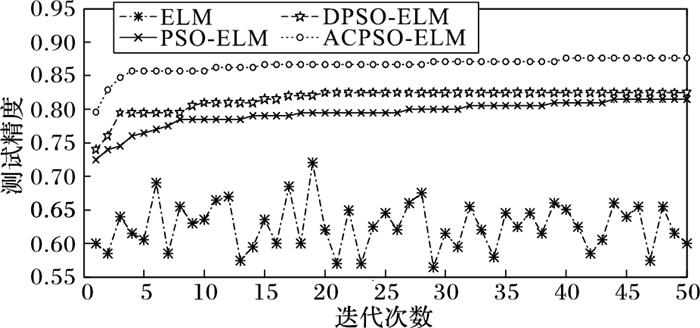

为验证ACPSO-ELM算法的高效性,本文分别用ELM、PSO-ELM、ACPSO-ELM、DPSO-ELM在Breast、Heart、Colon三种基因数据集采用10次五折交叉验证,即将每个基因数据集分成5份,选取其中4份作为训练数据集,1份作为测试数据集,进行实验,取10次结果精度的平均值作为算法的精度。本文所用实验粒子群的参数设置为N=20,Kmax=50,ωmax=0.95,ωmin=0.4,在ACPSO算法中,c1=c2=1.5。为进一步比较算法的性能,图 1~3给出了该算法在3种基因数据集上的测试精度对比。

|

图 1 Breast数据集上几种算法的测试精度对比 |

|

图 2 Colon数据集上几种算法的测试精度对比 |

|

图 3 Heart数据集上几种算法的测试精度对比 |

由图 1~3可以看出ELM的分类结果随着迭代次数的增加存在较大的震荡性,实验结果不稳定,加入PSO算法对ELM的参数优化后,从图 1~3可以看出,实验结果不再随迭代次数的增加而大幅度地震荡,说明PSO算法能够有效提高ELM算法的稳定性;同时由图 1~3可知,ELM的分类精度也得到了显著的提高,突出了参数优化的重要性。比较PSO-ELM和DPSO-ELM以及ACPSO-ELM三种算法的分类结果表明,ACPSO-ELM算法相比其他两种算法具有更好的分类精度以及稳定性。

本实验中最大迭代次数设置为50,由表 2可知,基于自适应混沌序列的粒子群优化算法在运行时间上高于其他算法,比较PSO、ACPSO算法可知,由于PSO算法每次迭代过程中粒子群的数量不变,假设第i次迭代时粒子群的数量为Ni,迭代次数为Kmax,则每次迭代粒子群数量为N1=N2=…=NKmax,设每个粒子一次迭代运行时间为Tp,则PSO算法运行总时间为Tp×Kmax×Ni,对于ACPSO算法,由于每次迭代过程中,粒子群通过适应度值不断更新,粒子数随着迭代的增加而逐渐减少,所以N1≥N2≥…≥NKmax, 设每个粒子每次迭代运行时间为Ta,则总运行时间为

| 表 2 4种算法的运行时间比较 |

综上所述,ACPSO-ELM无论在分类精度还是在稳定性、收敛性上都优于ELM,同时对比于PSO-ELM和DPSO-ELM算法,ACPSO-ELM是一种十分可靠、高效的分类算法。

4 结语针对ELM算法分类精度低、分类不稳定等情况,本文提出了ACPSO-ELM算法,通过ACPSO算法对ELM算法内权参数进行优化,在不同数据集上,与已有算法PSO-ELM, DPSO-ELM比较可知,本文提出的分类算法具有更高的分类精度以及更好的稳定性,由于本实验迭代次数设置较小,因此算法的分类速度相比其他算法较慢。

| [1] | HUANG G B, ZHU Q Y, SIEW C K. Extreme learning machine:theory and applications[J]. Neurocomputing, 2006, 70 (1) : 489-501. |

| [2] | SHI Y H, EBERHART R. A modified particle swarm optimizer[C]//Proceedings of the 1998 IEEE International Conference of Evolutionary Computation. Piscataway, NJ:IEEE, 1998:69-73. http://www.oalib.com/references/17622162 |

| [3] | KENNEDY J, EBERHART R. Particle swarm optimization[C]//Proceedings of the 1995 IEEE International Conference on Neural Networks. Piscataway, NJ:IEEE, 1995:1942-1948. http://www.scirp.org/reference/ReferencesPapers.aspx?ReferenceID=1482494 |

| [4] | LEI X J, SUN J J, MAQ Z. Multiple sequence alignment based on chaotic PSO[J]. Computational Intelligence and Intelligent Systems, 2009, 117 (2/3) : 351-360. |

| [5] | HAN F, YAO H F, LING Q H.An improved extreme learning machine based on particle swarm optimization[C]//Proceedings of the 7th International Conference on Intelligent Computing:Bio-Inspired Computing an Applications. Berlin:Springer-Verlag, 2012:699-704.g |

| [6] | YANG J M, MA M M, CHE H J, et al. Multi-objective adaptive chaotic particle swarm optimization algorithm[J]. Control and Decision, 2015, 30 (12) : 2168-2174. |

| [7] | HE Z B, WEN X H, HU LIU, et al. A comparative study of artificial neural network, adaptive neuro fuzzy inference system and support vector machine for forecasting river flow in the semiarid mountain region[J]. Journal of Hydrology, 2014, 509 : 379-386. doi: 10.1016/j.jhydrol.2013.11.054 |

| [8] | 陆慧娟, 安春霖, 马小平, 等. 基于输出不一致测度的极限学习机集成的基因表达数据分类[J]. 计算机学报, 2013, 36 (2) : 341-348. ( LU H J, AN C L, MA X P, et al. Disagreement measure based ensemble of extreme learning machine for gene expression data classification[J]. Chinese Journal of Computers, 2013, 36 (2) : 341-348. ) |

| [9] | HUANG G B, CHEN L, SIEW C K. Enhanced random search based incremental extreme learning machine[J]. Neurocomputing, 2008, 71 (18) : 3460-3468. |

| [10] | HUANG G B, ZHOU H M, DING X J, et al. Extreme learning machine for regression and multiclass classification[J]. IEEE Transactions on Systems, Man, and Cybernetics-Part B:Cybernetics, 2012, 42 (2) : 513-529. doi: 10.1109/TSMCB.2011.2168604 |

| [11] | ZHANG Y N, TENG H F. Detecting particle swarm optimization[J]. Concurrency & Computation Practice & Experience, 2009, 21 (4) : 449-473. |

| [12] | 卢新国, 林亚平, 骆嘉伟, 等. 癌症识别中一种基于组合GCM和CCM的分类算法[J]. 软件学报, 2010, 21 (11) : 2838-2851. ( LU X G, LIN Y P, LUO J W, et al. Classification algorithm combined GCM with CCM in cancer recognition[J]. Journal of Software, 2010, 21 (11) : 2838-2851. ) |

| [13] | EBERHART R, KENNEDY J. A new optimizer using particle swarm theory[C]//Proceedings of the 6th International Symposium on Micro Machine and Human Science. Piscataway, NJ:IEEE, 1995:39-43. |

| [14] | 田东平. 基于Tent混沌序列的粒子群优化算法[J]. 计算机工程, 2010, 36 (4) : 180-182. ( TIAN D P. Particle swarm optimization algorithm based on tent chaotic sequence[J]. Computer Engineering, 2010, 36 (4) : 180-182. ) |

| [15] | 刘斌.微粒群优化算法的改进研究与应用[D].西安:西安交通大学, 2009. ( LIU B. Improvement research and application of particle swarm optimization algorithm[D]. Xi'an:Xi'an Jiaotong University, 2009. ) http://cdmd.cnki.com.cn/Article/CDMD-10613-2009218543.htm |

| [16] | 施美珍.基于粒子群优化算法的模糊聚类分析及其应用[D].广州:华南理工大学, 2012. ( SHI M Z. Fuzzy clustering analysis and application based on particle swarm optimization[D].Guangzhou:South China University of Technology, 2012. ) http://cdmd.cnki.com.cn/Article/CDMD-10561-1012452529.htm |

| [17] | 刘丽霞.基于小波理论与LSSVM的模拟集成电路故障诊断方法[D].西安:西安电子科技大学, 2011. ( LIU L X.Fault diagnosis method for analog integrated circuits based on wavelet theory and LSSVM[D].Xi'an:Xidian University, 2011. ) http://cdmd.cnki.com.cn/Article/CDMD-10701-1013114383.htm |

| [18] | 张志华.基于混合递阶差分进化算法的RBF神经网络优化及应用[D].广州:华南理工大学, 2013. ( ZHANG Z H. The RBF neural network optimization and application based on hybrid hierarchical DE algorithm[D].Guangzhou:South China University of Technology, 2013. ) http://cdmd.cnki.com.cn/Article/CDMD-10561-1013319062.htm |

| [19] | 张云明. 基于新变异算子的改进粒子群优化算法[J]. 计算机工程与科学, 2011, 33 (9) : 95-99. ( ZHANG Y M. An improved particle swarm optimization algorithm based on new mutation operators[J]. Computer Engineering & Science, 2011, 33 (9) : 95-99. ) |